4 月 20 日,知名科技博主 Mrwhosetheboss 发文称”Claude > Gemini > ChatGPT,现在差距很大”。仅仅五天后,OpenAI 发布 GPT-5.5,Terminal-Bench 从 69.4%(Claude)跃升至 82.7%,多个基准测试的领跑者易主。

“最佳模型”这个标签在 2026 年的实际保质期是五天。

Q1 模型发布节奏

2026 年第一季度,主要前沿模型的发布密度前所未有:

- 1 月:Google Gemini 2.5 Pro

- 2 月:Claude Opus 4.6

- 4 月 16 日:Claude Opus 4.7

- 4 月 23 日:GPT-5.5

此外,DeepSeek V4、Moonshot Kimi K2.5、Mistral Medium 3、Qwen 3.1 等开源和半开源模型也在同期发布或更新。平均下来,几乎每 7 天就有一个主要模型更新或发布。

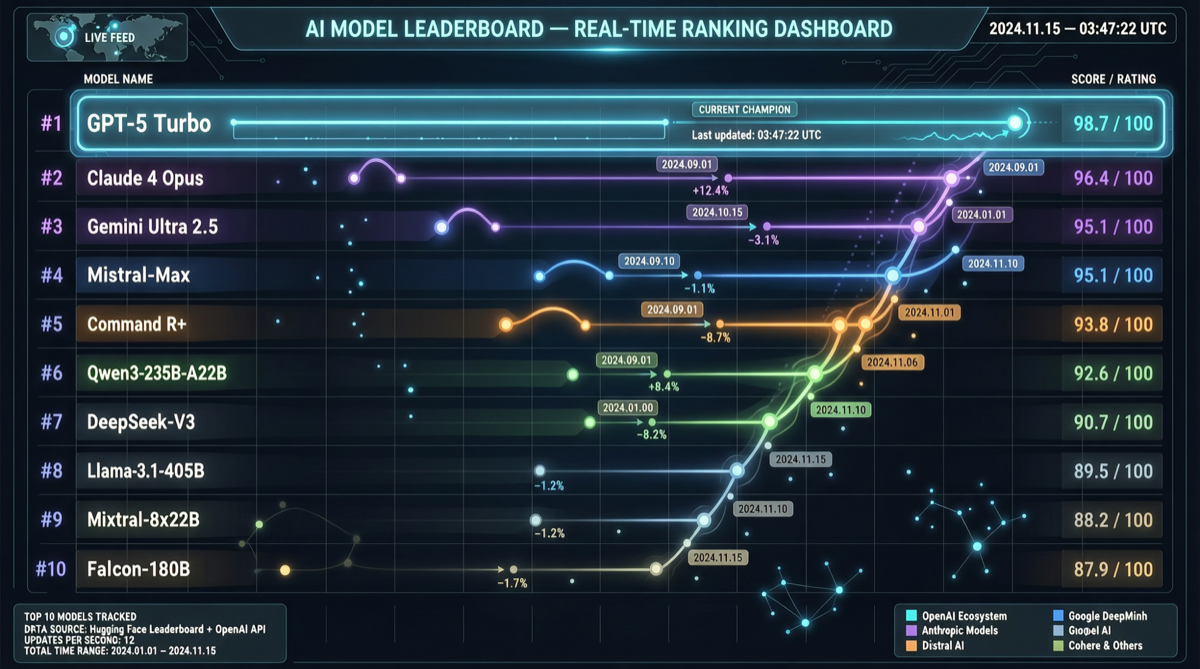

排行榜的”轮换效应”

对比过去三个月的主要评测结果,可以看到一个清晰的模式:

| 时间节点 | Terminal-Bench 领跑者 | SWE-bench Pro 领跑者 | HLE 领跑者 |

|---|---|---|---|

| 3 月 | Claude Opus 4.6 | Claude Opus 4.6 | Claude Opus 4.6 |

| 4 月中旬 | Claude Opus 4.7 | Claude Opus 4.7 | Claude Opus 4.7 |

| 4 月下旬 | GPT-5.5 | Claude Opus 4.7 | Claude Opus 4.7 |

GPT-5.5 在 Terminal-Bench 上大幅超越 Opus 4.7,但在 SWE-bench Pro 和 HLE 上未能反超。这说明不同模型已经在不同维度建立了自己的”护城河”——没有哪个模型能在所有评测中都保持第一。

为什么”最佳”标签失效了

根本原因有两个。

一是模型能力正在收敛。随着训练数据、架构和优化方法的趋同,旗舰模型之间的绝对差距在缩小。GPT-5.5 和 Opus 4.7 的差距更多体现在”擅长的领域不同”,而非”全面碾压”。

二是评测基准本身在快速迭代。Terminal-Bench 已经到 2.0 版本,新的评测不断涌现。一个模型可能在这个月的基准中领先,下个月的新基准发布后排名就会变化。

对用户的实际意义

如果你在选择 AI 模型,与其追问”哪个是最佳”,不如问”哪个最适合我的工作”:

- 终端操作/DevOps:GPT-5.5(Terminal-Bench 82.7%)

- 软件工程/代码重构:Claude Opus 4.7(SWE-bench Pro 领先)

- 高难度推理:Claude Opus 4.7(HLE 46.9%)

- 性价比/日常使用:Claude Sonnet 或 Gemini 免费层

在模型迭代以周为单位的时代,“最佳模型”的声明有效期越来越短。但模型的差异化优势正在形成——理解这一点比追逐排行榜更有价值。