20 апреля технологический блогер Mrwhosetheboss написал: «Claude > Gemini > ChatGPT. Сейчас差距很大». Всего пять дней спустя OpenAI выпустила GPT-5.5, прыгнув с 69,4% (Claude) до 82,7% на Terminal-Bench, и лидер на нескольких бенчмарках сменился.

Фактический срок годности ярлыка «лучшая модель» в 2026 году — пять дней.

Темп выпуска моделей в Q1

В первом квартале 2026 года плотность выпуска основных передовых моделей была беспрецедентной:

- Январь: Google Gemini 2.5 Pro

- Февраль: Claude Opus 4.6

- 16 апреля: Claude Opus 4.7

- 23 апреля: GPT-5.5

Кроме того, DeepSeek V4, Moonshot Kimi K2.5, Mistral Medium 3, Qwen 3.1 и другие модели с открытым и полуоткрытым исходным кодом были выпущены или обновлены за тот же период. В среднем крупное обновление или выпуск модели происходило почти каждые 7 дней.

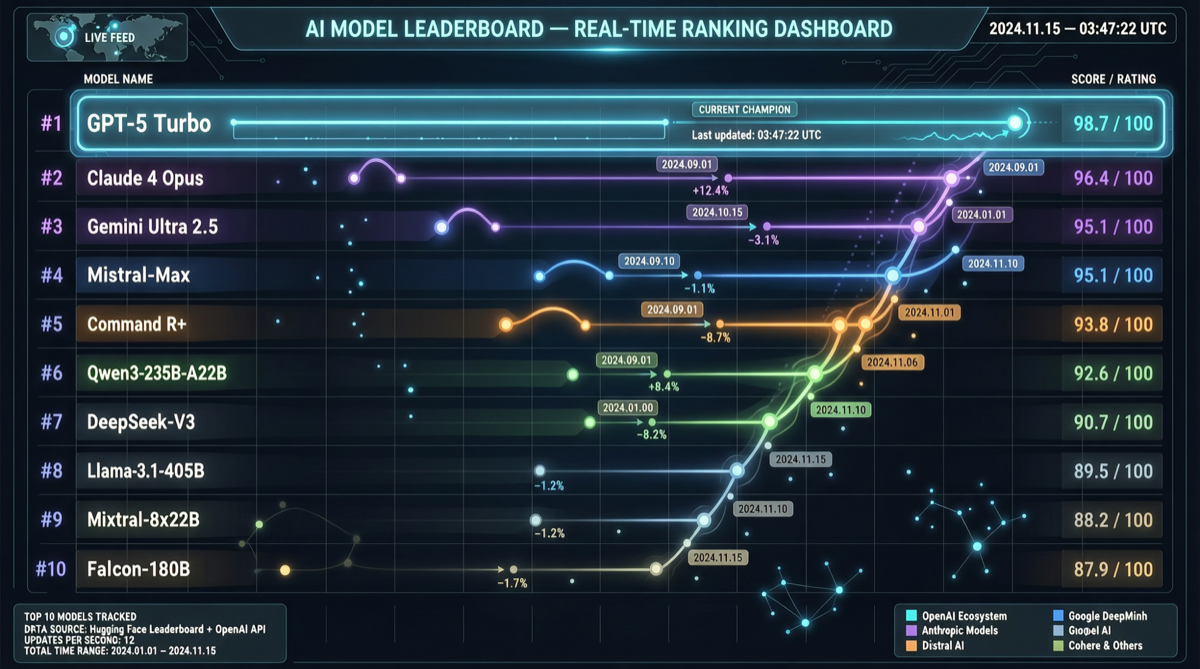

Эффект «ротации» в рейтингах

Сравнение результатов основных оценок за последние три месяца выявляет чёткую закономерность:

| Временная точка | Лидер Terminal-Bench | Лидер SWE-bench Pro | Лидер HLE |

|---|---|---|---|

| Март | Claude Opus 4.6 | Claude Opus 4.6 | Claude Opus 4.6 |

| Середина апреля | Claude Opus 4.7 | Claude Opus 4.7 | Claude Opus 4.7 |

| Конец апреля | GPT-5.5 | Claude Opus 4.7 | Claude Opus 4.7 |

GPT-5.5 значительно превзошёл Opus 4.7 на Terminal-Bench, но не смог обогнать его на SWE-bench Pro и HLE. Это показывает, что разные модели уже построили свои собственные «крепости» в разных измерениях — ни одна модель не может удерживать первое место во всех оценках.

Почему ярлык «лучший» теряет силу

Есть две основные причины.

Во-первых, способности моделей сходятся. По мере схождения тренировочных данных, архитектур и методов оптимизации абсолютный разрыв между флагманскими моделями сокращается. Разница между GPT-5.5 и Opus 4.7 больше заключается в «разных областях силы», а не в «полном доминировании».

Во-вторых, сами бенчмарки быстро итерируются. Terminal-Bench уже достиг версии 2.0, и появляются новые оценки. Модель может лидировать в бенчмарках этого месяца, а затем изменить рейтинг при выпуске новых бенчмарков в следующем месяце.

Практическое значение для пользователей

Если вы выбираете модель ИИ, вместо вопроса «какая лучшая» задайте «какая лучше всего подходит для моей работы»:

- Терминальные операции/DevOps: GPT-5.5 (Terminal-Bench 82,7%)

- Программная инженерия/рефакторинг кода: Claude Opus 4.7 (лидер на SWE-bench Pro)

- Сложное рассуждение: Claude Opus 4.7 (HLE 46,9%)

- Экономическая эффективность/ежедневное использование: Claude Sonnet или бесплатный уровень Gemini

В эпоху, когда итерация моделей происходит еженедельно, срок действия заявлений о «лучшей модели» сокращается. Но дифференцированные преимущества моделей формируются — понимание этого важнее, чем погоня за рейтингами.