结论

Qwen 3.6 Max Preview 在 BridgeBench BS Benchmark(反幻觉/胡说八道检测测试)中取得 94.5 分,排名全球第二。该基准专门测试模型在面对诱导性问题时,是否能识别并拒绝生成虚假信息。

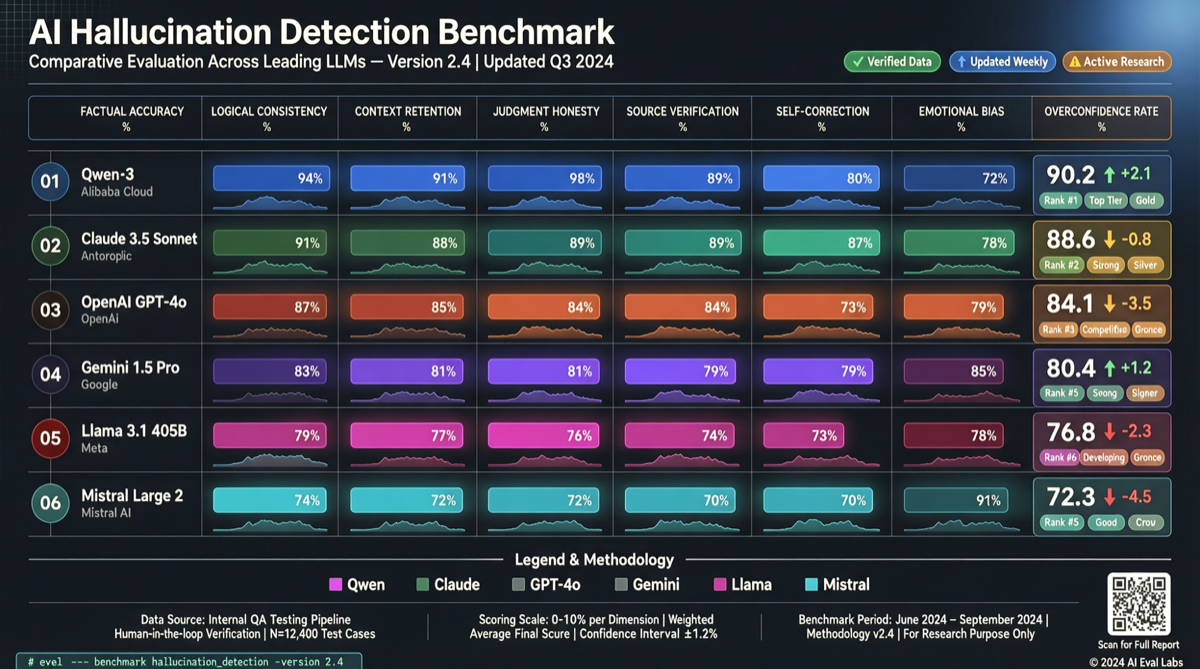

排名结果:

- Claude Opus 4.6:95.0

- Qwen 3.6 Max:94.5

- Claude Sonnet 4.6:91.5

- GPT-5.4:91.5

Qwen 3.6 Max 是排名最高的开源模型,也是唯一一个反幻觉能力超过所有 OpenAI 模型的非闭源方案。

测试维度

BS Benchmark 是什么

BS Benchmark(Bullshit Benchmark)测试模型的核心能力是:当用户提出包含错误前提、虚假信息或逻辑陷阱的问题时,模型能否识别问题本身的问题,而非盲目生成看似合理但实际错误的答案。

这与传统的知识测试不同——传统测试问”你知道什么”,BS Benchmark 问”你知道你不知道什么”。

Qwen 3.6 Max 的表现

Qwen 3.6 Max 的 94.5 分意味着在绝大多数测试场景中,它能:

- 识别问题中的错误前提并指出

- 在不确定时表达合理的怀疑而非编造答案

- 区分”有根据的推测”和”无根据的猜测”

值得注意的是,Qwen 3.6 Max 得分超过了 GPT-5.4(91.5)和 Claude Sonnet 4.6(91.5),仅以 0.5 分之差落后于 Claude Opus 4.6。

对开源生态的意义

长期以来,反幻觉能力被认为是闭源模型的”护城河”。Qwen 3.6 Max 的表现证明,开源模型在这一关键指标上已经追平甚至在某些方面超越了闭源方案。

对于需要高可靠性输出的场景(医疗、法律、金融),Qwen 3.6 Max 提供了一个开源替代方案,无需担心供应商锁定。

选择建议

- 高可靠性场景:Qwen 3.6 Max 的反幻觉能力接近顶级闭源模型,适合对输出准确性要求严格的应用

- 开源优先策略:如果团队需要自托管或避免供应商锁定,Qwen 3.6 Max 是目前反幻觉能力最强的开源选择

- 成本考量:开源部署可避免按 token 计费的 API 成本,尤其适合高调用量场景

- 多模型协作:可将 Qwen 3.6 Max 用作事实核查层,配合其他模型生成内容