结论

百万 token 上下文不等于”能用一百万 token”。GPT-5.5 是目前长上下文检索能力最强的模型(MRCR @ 1M 达 74%),DeepSeek V4 和 Gemini 2.5 Pro 居中(约 50-60%),Claude Opus 4.7 在大窗口下表现偏弱(32.2%)。

如果你的核心需求是让模型理解整本文档或大型代码库,GPT-5.5 是当前最可靠的选择。如果只需要”大概知道文档里有什么”来辅助决策,任何旗舰模型都够用。

测试维度

检索精度

MRCR(Multi-Reference Context Retrieval)是衡量模型在超长上下文中定位关键信息能力的基准。在 100 万 token 的测试条件下:

| 模型 | MRCR @ 1M | 说明 |

|---|---|---|

| GPT-5.5 | 74% | 检索精度领先,针在大海中找针的能力最强 |

| Gemini 2.5 Pro | ~60% | 表现稳健,但细节检索有遗漏 |

| DeepSeek V4 | ~50% | 够用,但复杂查询容易丢失 |

| Claude Opus 4.7 | 32.2% | 大窗口下注意力分散明显 |

GPT-5.5 的 74% 意味着在百万 token 中给出 10 个关键信息点,它能准确找到其中 7-8 个。Claude Opus 4.7 的 32.2% 则意味着大部分信息会被遗漏。

上下文衰减

所有模型在长上下文中的表现都存在”衰减效应”——文档开头和末尾的信息更容易被记住,中间部分容易被忽略。不同模型的衰减曲线不同:

- GPT-5.5:衰减最平缓,中间段信息的保留率显著高于其他模型

- Gemini 2.5 Pro:开头和末尾表现优秀,中段有中等程度衰减

- DeepSeek V4:衰减相对均匀,整体精度随上下文长度线性下降

- Claude Opus 4.7:对超长上下文的支持似乎不是训练重点,衰减剧烈

实际场景表现

技术文档问答:给模型一份 500 页的 API 文档,询问特定端点的参数。GPT-5.5 准确率最高;Claude 需要你把文档拆成多个分段分别提问。

代码库审查:将整个代码仓库作为上下文输入,要求找出潜在 bug。GPT-5.5 和 Gemini 2.5 Pro 能给出有价值的反馈;Claude 和 DeepSeek V4 容易遗漏跨文件依赖中的问题。

长文档摘要:对 200 页报告生成摘要。所有模型都能胜任——这是长上下文中最简单的任务,因为不需要精确定位信息,只需要整体理解。

新技术动态

AMD 最近发布了 HyLo(Hybrid Long-context)架构论文,证明可以在预训练之后以更低的成本添加长上下文能力,内存占用大幅降低,短上下文质量仅有轻微下降。HyLo 可将可用上下文扩展至 200 万 token。这项技术如果被主流模型采纳,可能重新洗牌长上下文能力的竞争格局。

选择建议

需要精确定位长文档中的信息:GPT-5.5。74% 的 MRCR 分数目前无可替代。

只需要整体理解(摘要、情感分析、主题识别):任何旗舰模型都可以,选择最便宜的那个。

需要本地部署的长上下文方案:关注 AMD HyLo 架构的开源实现,预计未来几个月会有基于此架构的开源模型出现。

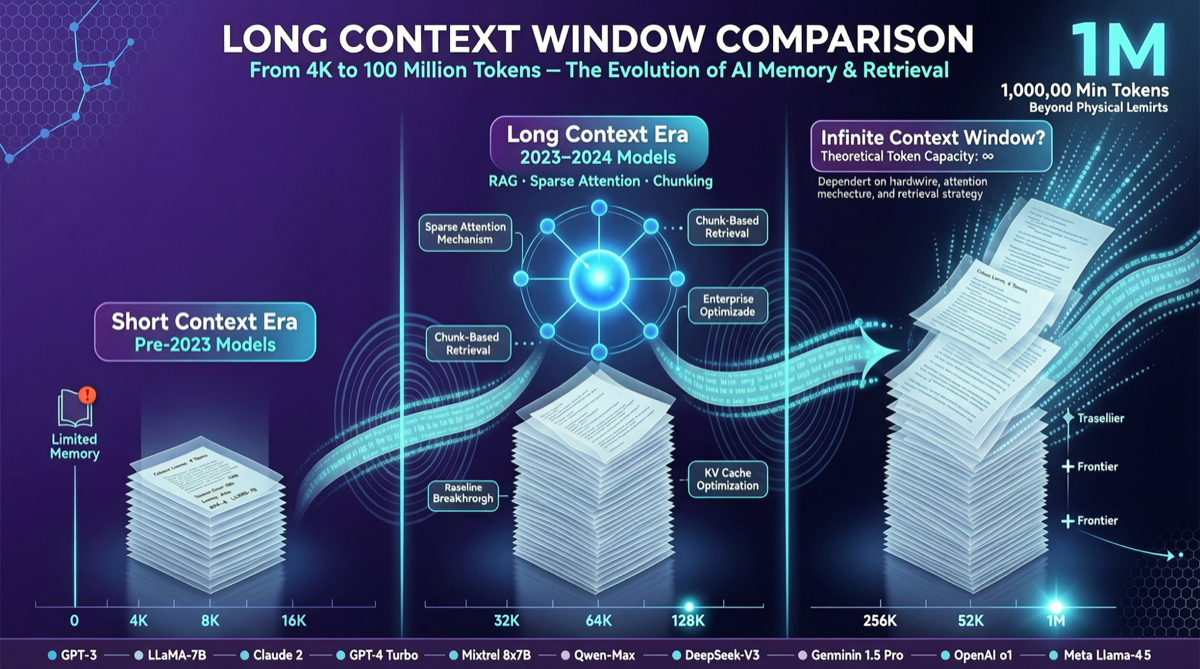

RAG vs 长上下文:如果你的场景是”在大量文档中搜索特定信息”,传统 RAG(检索增强生成)仍然比纯长上下文更可靠——因为 RAG 的分段检索不会受到注意力衰减的影响。长上下文更适合”理解单个大型文档”的场景。