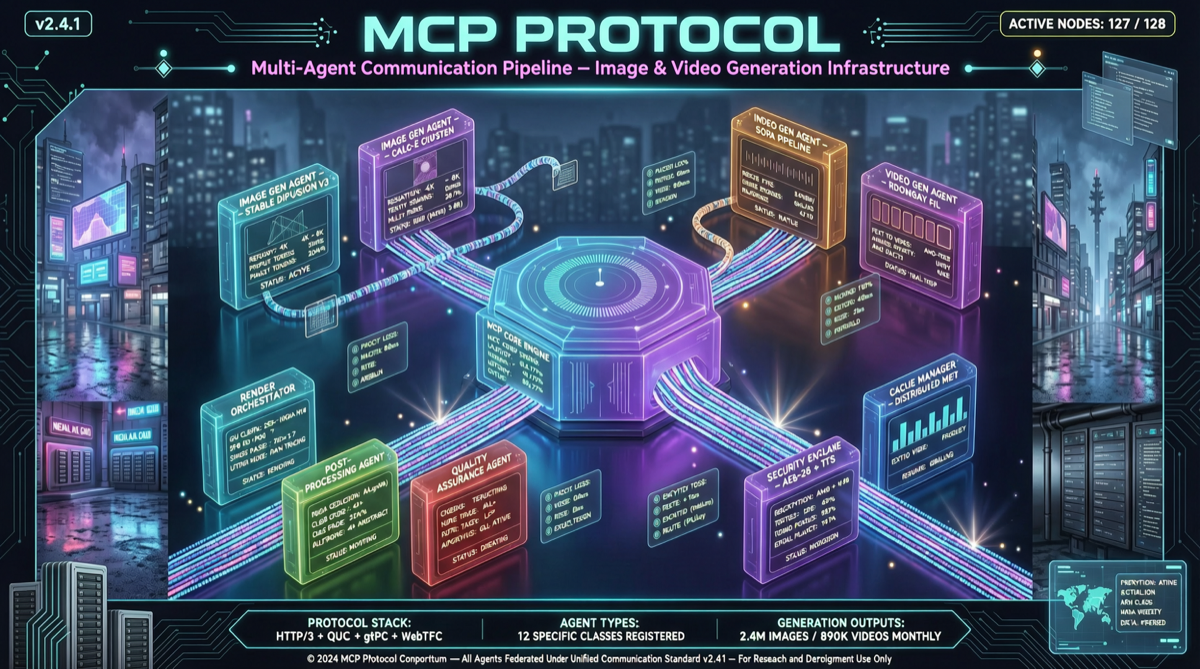

4 月 28 日,Higgsfield 正式发布了其 MCP(Model Context Protocol)服务器。这一发布的意义在于:它让 AI Agent 第一次能够直接调用业界顶级的图像和视频生成模型,而不再需要人类在中间手动切换工具。

痛点:多模态内容生成与 Agent 工作流的断层

当前 AI Agent 生态面临一个结构性问题:编码 Agent(Claude Code、Codex)擅长文本和代码,但在生成视觉内容时需要中断工作流、切换到专门工具。Higgsfield MCP 试图打通这条链路。

核心能力

Higgsfield MCP 提供以下多模态模型的 Agent 端访问:

- Seedance 2.0:视频生成

- GPT Image 2.0:图像生成

- 其他顶级图像和视频模型

接入后,Agent 可以在编码、写作、研究的过程中,自主调用图像和视频生成能力,无需人工介入。

兼容性

目前已支持的 Agent 框架:

- OpenClaw

- Hermes Agent

- NemoClaw

- 任何遵循 MCP 协议的客户端

这意味着 Claude Desktop、Cursor、OpenClaw 等工具的 Agent 都能通过同一套接口调用多模态生成能力。

使用场景

内容管道自动化:Agent 完成文案撰写后,自动生成配图和视频,发布到 CMS。

产品原型:从需求文档到视觉原型的全流程,Agent 可以自主完成文字 + 图像 + 视频的产出。

创意实验:在编码过程中快速生成 UI mockup 或概念图,加速设计迭代。

快速接入

# 安装 Higgsfield MCP Server

# 参考 Higgsfield 官方安装文档

# 在 Claude Desktop 中配置 MCP

# 添加 Higgsfield MCP 端点

# 在 OpenClaw/Hermes Agent 中启用多模态工具社区反馈显示,从安装到生成第一个视觉内容大约需要几分钟。生成速度快、无需排队是目前的主要优势之一。

行业意义

MCP 协议正在成为 AI 工具互连的事实标准。Anthropic 官方数据显示,MCP SDK 月下载量已达 9,700 万次,18 个月增长 970 倍,超过 17,000 个活跃服务器。Higgsfield 的入局将 MCP 的覆盖范围从文本/代码工具扩展到了多模态生成领域。

对于内容创作者和 Agent 开发者来说,这是一个值得关注的基础设施变化。它意味着 Agent 工作流的”最后一公里”——视觉内容生成——正在被标准化。

观察点

- 图像/视频生成的成本结构尚未完全公开

- 生成内容的版权和归属问题需要关注

- 与 ComfyUI、Stability API 等现有方案的对比评测尚未出现