英伟达的”参考答案”

AI 大模型竞争的焦点正在从”谁的参数多”转向”谁的 Agent 跑得好”。

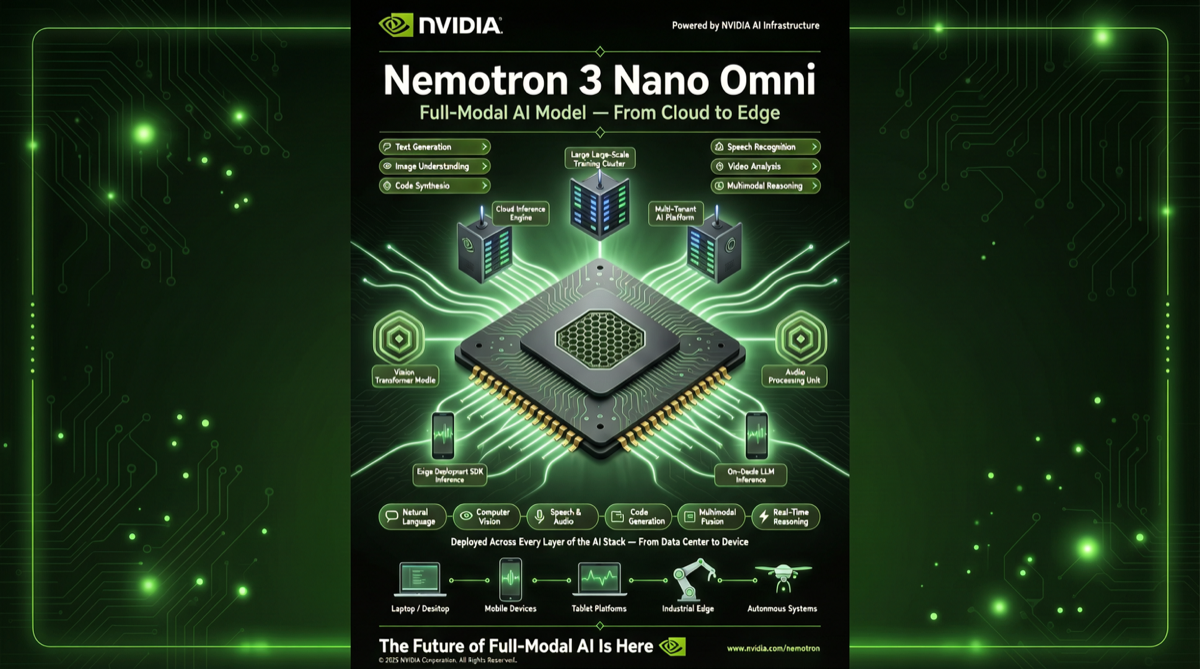

4 月 29 日,英伟达发布了 Nemotron 3 系列开放模型,其中最引人注目的是 Nano Omni 版本——一个面向 AI Agent 应用的全模态(文本、图像、音频、视频)开源模型。

这不是英伟达第一次发布模型,但 Nemotron 3 的发布时机和定位非常值得分析。

为什么是现在?

2026 年 Q2 的大模型市场格局有几个关键变化:

-

Agent 成为主战场:OpenAI、Google、中国厂商都在加速布局 AI Agent。模型能力的”天花板”已经足够高,竞争焦点转向”如何在实际应用中高效运行”。

-

边缘部署需求爆发:越来越多的场景需要在本地或边缘设备上运行 AI Agent——工业控制、机器人、智能家居、自动驾驶。这些场景对延迟、隐私、成本有严格要求。

-

推理成本压力:随着 Agent 交互轮次的增加,单次推理的成本累积成了巨大的运营开销。市场对”小而强”的模型需求急剧增长。

Nemotron 3 Nano Omni 正是针对这三个趋势的回应。

核心规格与技术亮点

| 特性 | 说明 |

|---|---|

| 模型规模 | Nano 级别(参数规模未公开,定位为”轻量高效”) |

| 全模态 | 文本、图像、音频、视频的统一理解与生成 |

| FP8 推理优化 | 深度优化 Hopper (H100/H200) 和 Blackwell (B100/B200) 架构的 FP8 推理 |

| 消费级兼容 | 支持 RTX 5090 等消费级显卡部署 |

| 边缘平台 | 兼容 Jetson Thor 机器人平台 |

| 开源 | 开放权重,支持商用 |

FP8 推理:效率提升 9 倍

Nemotron 3 最核心的技术突破在于 FP8(8-bit 浮点)推理优化。相比传统的 FP16/BF16 推理:

- 吞吐量提升约 9 倍:FP8 的精度压缩大幅减少了计算量和显存占用

- 精度损失可控:通过英伟达专有的量化校准技术,FP8 下的模型精度损失在大多数任务中低于 2%

- 功耗显著降低:对于边缘部署场景(如 Jetson Thor),FP8 意味着更长的电池续航和更低的散热要求

全模态能力

Nano Omni 的”全模态”特性使其成为 Agent 应用的理想选择:

- 文本理解与生成:作为 Agent 的核心决策引擎

- 图像理解:支持视觉 grounding,Agent 可以”看懂”屏幕截图、照片、图表

- 音频理解:支持语音指令输入,适合语音交互场景

- 视频理解:支持短视频帧序列分析,适合监控、质检等场景

硬件兼容性矩阵

| 平台 | 支持情况 | 典型场景 |

|---|---|---|

| H100/H200 (FP8) | 深度优化 | 云端大规模 Agent 服务 |

| B100/B200 (FP8) | 深度优化 | 下一代云端推理 |

| RTX 5090 | 兼容 | 个人工作站/边缘推理 |

| Jetson Thor | 兼容 | 机器人/边缘设备 |

这个兼容性矩阵的设计意图非常清晰:从云端到边缘,从数据中心到消费级显卡,Nemotron 3 都能运行。

战略意图分析

英伟达发布 Nemotron 3 系列,本质上是在做一件事:定义 AI Agent 应用的”参考架构”。

这类似于英伟达在自动驾驶领域的 Drive 平台——通过提供参考模型,推动整个生态围绕自己的硬件和软件栈来构建。

具体来说:

-

FP8 推广:通过开源模型展示 FP8 的实际效果,推动开发者和企业接受 FP8 作为推理标准格式,从而带动新一代 GPU 的销售。

-

生态锁定:当开发者基于 Nemotron 3 构建 Agent 应用后,自然会倾向选择英伟达的硬件(从 H100 到 RTX 5090 到 Jetson Thor)进行部署。

-

开源 vs 闭源的平衡:开源模型降低了采用门槛,但训练和微调的最佳性能仍然需要英伟达的硬件加速——这是一个精明的商业策略。

与竞品的对比

| 模型 | 特点 | 定位 |

|---|---|---|

| Nemotron 3 Nano Omni | FP8 优化 + 全模态 + 边缘兼容 | 全模态 Agent 参考实现 |

| DeepSeek V4 | 1.6T 参数 + 百万 Token 上下文 | 通用能力旗舰 |

| Kimi K2.6 | 万亿参数编程模型 + Agent 集群 | 编程/Coding Agent |

| MiMo-V2.5 | 310B 多模态 Agent + 1M context | 多模态 Agent |

Nemotron 3 的独特优势在于硬件-软件的深度协同优化。其他模型可能在纯软件指标上更强,但 Nemotron 3 在”实际部署效率”这个维度上有显著优势。

对行业的意义

对开发者:如果你需要在本地或边缘部署全模态 AI Agent,Nemotron 3 Nano Omni + RTX 5090 是目前最可行的方案之一。不需要云端 API,数据不出本地,延迟可控制在毫秒级。

对企业:FP8 推理带来的 9 倍效率提升意味着同样的 GPU 预算可以支撑 9 倍的 Agent 交互量。对于需要大规模部署 AI Agent 的企业(如客服、数据分析、工业质检),这是一个值得认真评估的方案。

对开源社区:英伟达持续开源 Nemotron 系列模型,为研究者和创业者提供了高质量的基座。结合微软 Agent Lightning 等训练框架,开源 Agent 生态的基础设施正在快速完善。

主要来源:

- NVIDIA Developer Blog - NVIDIA

- Nemotron 3 系列发布 - NVIDIA

- Nemotron 3 效率分析 - 今日头条