结论

DeepSeek V4 是目前最接近前沿水平的开源模型,在编码和推理基准上以 0.2 分以内的差距逼近 GPT-5.4 / Opus 4.5+ 级别,但 API 价格只有前者的 1/7 到 1/9。它的定位很清晰:用极低成本提供”够用”的前沿能力,而非争夺 SOTA。

适合预算有限的团队做原型验证和批量推理任务;不适合对极限性能有要求的场景——它距离 GPT-5.5 和 Opus 4.7 仍有约 4-5 个月的技术代差。

测试维度

模型架构与规模

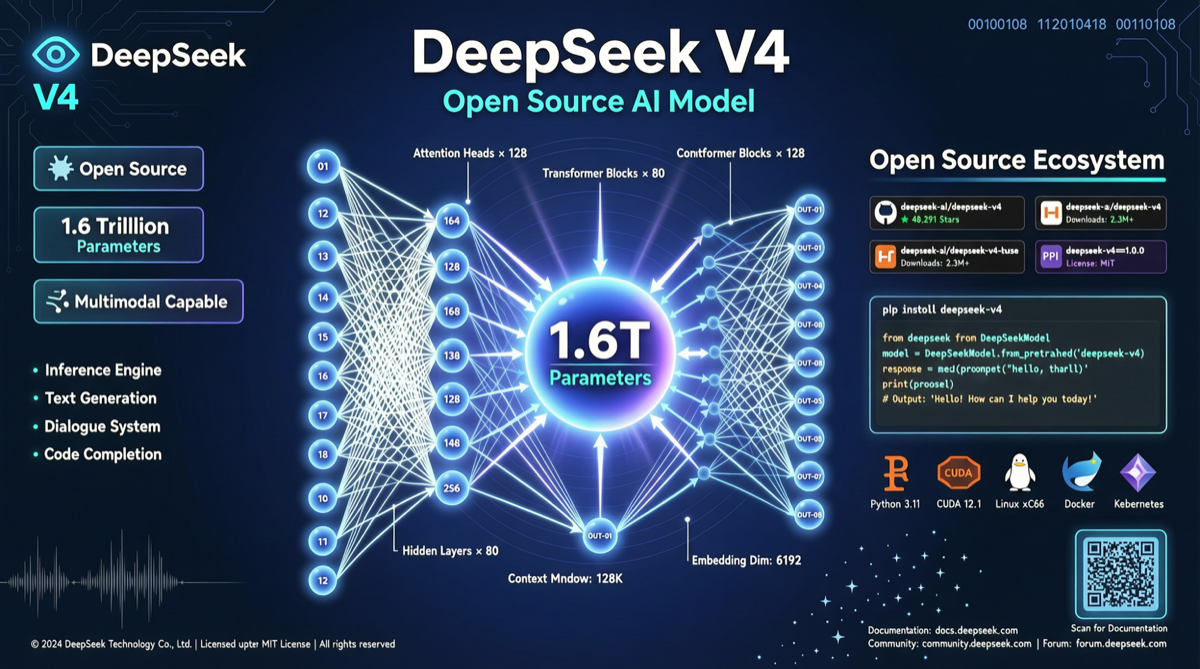

DeepSeek V4 采用混合专家架构(MoE),总参数量 1.6 万亿,上下文窗口 100 万 token,支持 50 多种语言。它是首个大规模使用华为昇腾芯片训练的模型,这意味着在中美芯片竞争背景下,中国在算力受限条件下依然产出了有竞争力的前沿模型。

DeepSeek V4 Pro 版本进一步强化了智能体编码能力,在中国本土评测中综合得分 70.98,超过所有其他国产开源模型。

基准成绩

| 基准 | DeepSeek V4 | GPT-5.5 | Claude Opus 4.7 | Gemini 2.5 Pro |

|---|---|---|---|---|

| SWE-bench Pro | ~58% | 58.6% | 64.3% | ~55% |

| Terminal-Bench 2.0 | ~75% | 82.7% | ~70% | ~72% |

| AIME 2025 | ~90% | ~95% | ~93% | ~92% |

| MRCR @ 1M | ~50% | 74% | 32.2% | ~60% |

在编码任务上,V4 与 GPT-5.4/Opus 4.5+ 处于同一梯队,但距离 GPT-5.5 和 Opus 4.7 仍有可见差距。在数学推理方面表现稳健,接近第一梯队。长上下文检索能力中等——能用,但不如 GPT-5.5 可靠。

实际使用体验

社区反馈集中在几个方面:

- 中文能力突出:作为国产模型,中文理解和生成质量明显优于多数国际竞品

- 幻觉率偏高:有评测指出 V4 在事实性问答中的幻觉率达到 86%,需要在生产环境中配合验证层

- 推理速度:由于 MoE 架构,激活参数远小于总参数,推理延迟表现优于同规模稠密模型

- 部署门槛:开源权重可本地部署,但 1.6T 参数的完整模型需要多卡集群;蒸馏后的较小版本更适合单机

价格

DeepSeek V4 的 API 定价为 $3.48/MTok 输出,相比之下 Opus 4.7 为 $25/MTok,GPT-5.5 为 $30/MTok。7-9 倍的价格差距是其最大的差异化优势。DeepSeek V4 Pro 的完整 Artificial Analysis Index 运行成本仅 $1,071,是 Opus 4.7 的五分之一。

选择建议

中国本土团队:优先考虑。中文能力强、部署灵活、价格极低,且不受美国出口管制影响。

成本敏感的批量任务:DeepSeek V4 是最优解。文档处理、批量摘要、简单代码生成等任务,其能力完全足够。

需要极限性能的场景:暂不建议。在复杂智能体编排、大规模代码重构、高精度推理等场景,GPT-5.5 和 Opus 4.7 仍明显领先。

学术研究:Apache 2.0 协议下可自由使用和修改,是非常好的研究基座。