公司内部的"闲鱼",卖家和买家都是AI

Anthropic悄悄做完了一个有点魔幻的实验。

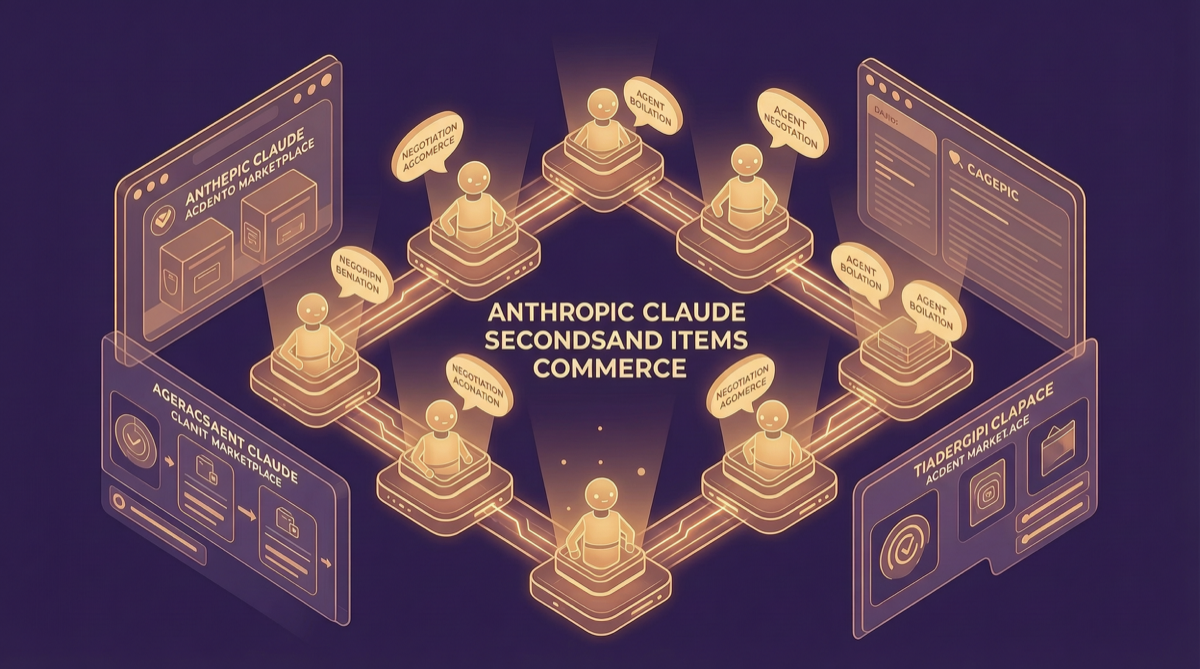

给69名员工每人分配一个Claude驱动的Agent,在一个Slack搭建的私密二手市场里,让Agent替员工买卖个人闲置物品——滑雪板、一袋乒乓球、各种杂物。整整一周,人类不干预。

结果:186笔成交,总额超过4000美元。

名字也很直白:Project Deal。

反直觉的发现

这个实验最有趣的部分不是"AI能做交易"——这在技术上不算难事。真正有意思的是实验中发现的模式:

Opus用户谈到了更好的deal,但Haiku用户完全没察觉自己吃亏了。

也就是说,当一方用更强的模型(Opus)、另一方用较弱的模型(Haiku)时,Opus的Agent能在谈判中拿到更有利的价格,而Haiku的Agent居然没意识到自己在被压价。

这不是bug,是一个信号。

Agent-to-Agent的经济交互中,模型能力差异会直接转化为"商业优势"。放在更大的场景里——如果未来你的Agent替你在电商平台上跟卖家的Agent砍价,你用的模型版本,可能就是你能省多少钱。

这不是产品发布,是研究

Anthropic把这个实验包装成了一个研究项目,而不是产品预告。他们关注的核心问题是:"我们距离AI Agent代表买卖双方的市场还有多远?"

答案可能比很多人想的要近。

这个实验的条件是受控的:Slack私密市场、真实物品但金额不大、Anthropic员工作为人类委托人。但它验证了一个关键假设——Agent可以独立完成完整的交易链路:发现商品、评估价值、发起对话、讨价还价、达成交易。

中间没有任何人工介入。

和Managed Agents的关系

同一天,Anthropic还上线了Managed Agents(托管Agent)功能。三件套:

- Dreaming:你的Agent会在夜间回放一天的工作,自我优化

- Outcomes:你只给目标,不管步骤

- Multi-Agent Orchestration:一个Claude指挥一群专家Claude

Project Deal和Managed Agents放在一起看,信号更清晰:Anthropic正在把Agent从"工具"推向"代理人"。前者是你让它做什么它做什么,后者是它代表你去跟世界打交道。

闲鱼实验只是把这种代理关系具象化了——你的Agent替你去谈判,而你甚至不在场。

一个现实的问题

如果Agent替你买东西,你该信任它的谈判策略到什么程度?

实验里Haiku用户吃了亏但没发现。这说明"Agent能力差异→实际利益损失"这条链路是真实存在的,而且用户可能根本意识不到。

在未来,你选哪个模型跑你的购物Agent,可能比你想象的重要。

下一步

Anthropic说还会继续做这类实验。下一个方向可能会是更复杂的多Agent场景——比如多个Agent协作完成一个项目,或者Agent之间形成更长期的交易关系。

186笔成交、4000美元,量级不大。但方向感很清晰。