Kimi K2.6 が Design Arena で首位獲得:月之暗面が 3D デザイン領域ですべての米国モデルを上回る

月之暗面 Kimi K2.6 が LMSYS Design Arena で総合首位を獲得、3D デザインと UI プロトタイピングで Claude と GPT を上回る。中国モデルがクリエイティブデザイン分野のベンチマークで初めて世界一に輝いた。

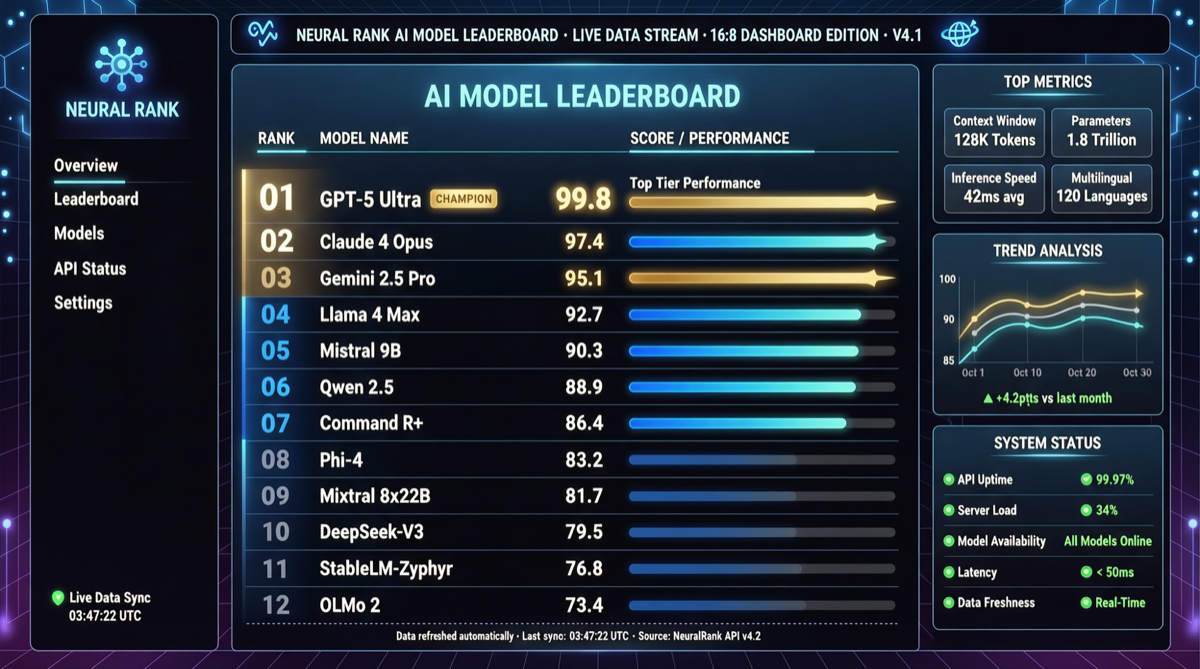

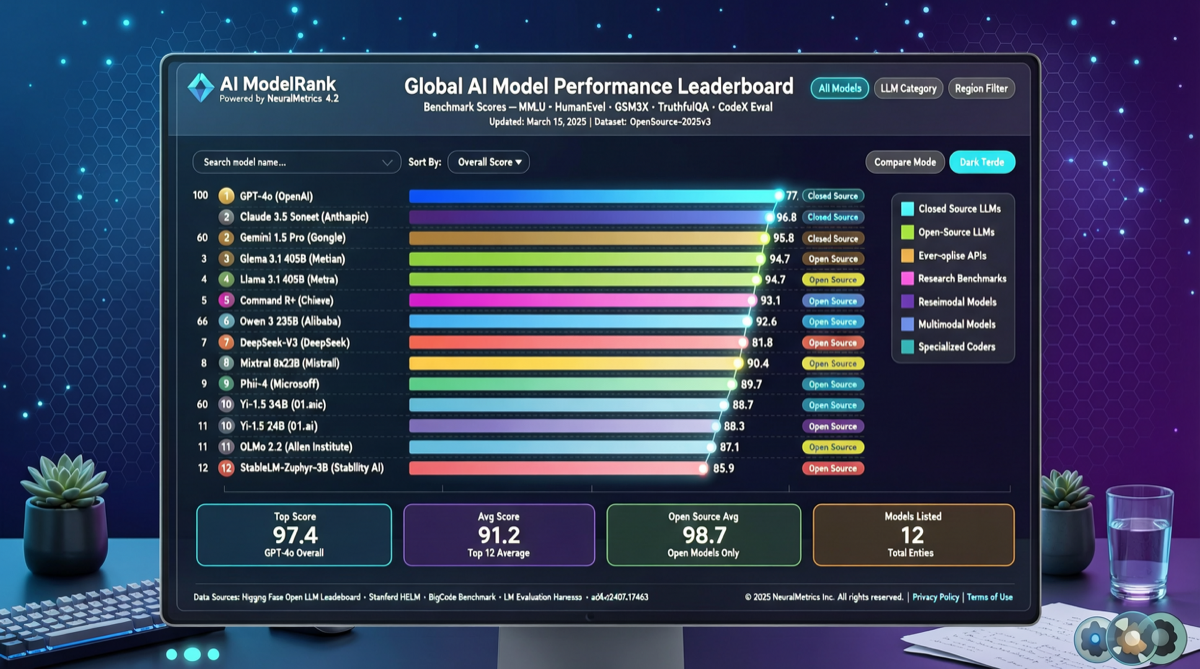

主要AIモデルを包括的にレビューし、最適なソリューションの選択をサポート

月之暗面 Kimi K2.6 が LMSYS Design Arena で総合首位を獲得、3D デザインと UI プロトタイピングで Claude と GPT を上回る。中国モデルがクリエイティブデザイン分野のベンチマークで初めて世界一に輝いた。

Qwen 3.6 Max PreviewがBridgeBench BS Benchmark(反ハルシネーションテスト)で94.5点を獲得し、世界ランク2位。Claude Opus 4.6の95.0点に次ぐ。虚偽情報の拒否において、Qwen 3.6 MaxはGPT-5.4および全OpenAIモデルを上回る。

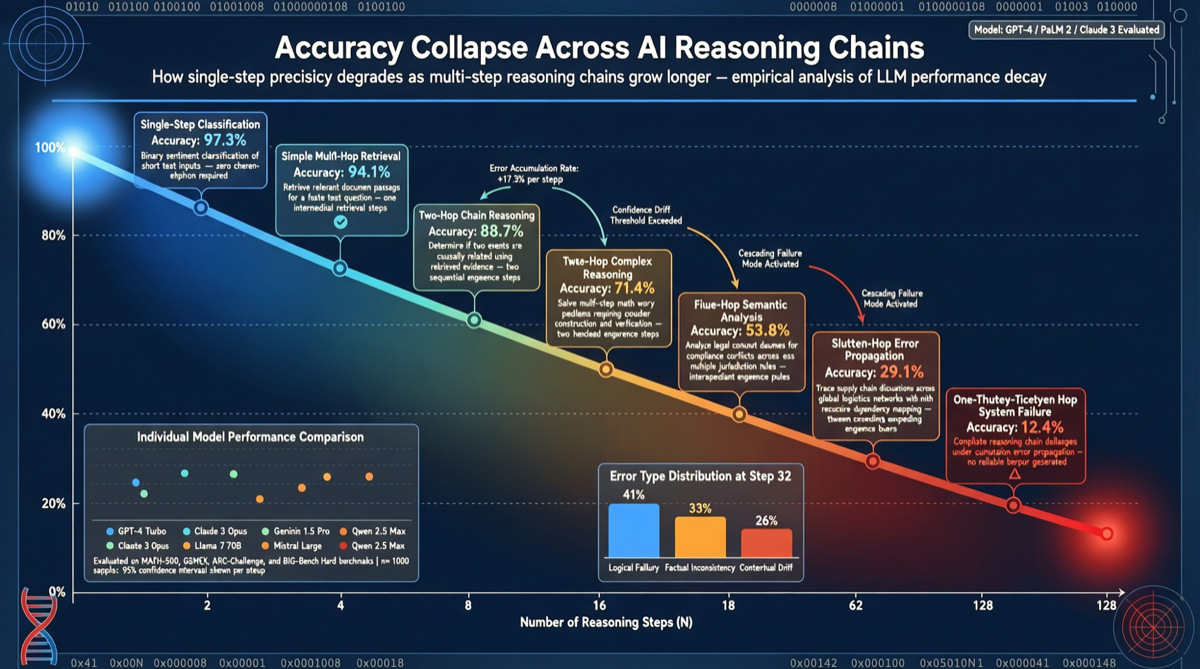

オックスフォード大学とローレンスリバモア国立研究所が長連鎖推論タスクにおけるAIモデルの性能をテストする新基準を発表。GPT 5.2は単体問題で95.7%の解決率だが、問題を連鎖させると正確率は9.83%に急落。本評価はこの発見がAI実用化に与える深远な影響を検証する。

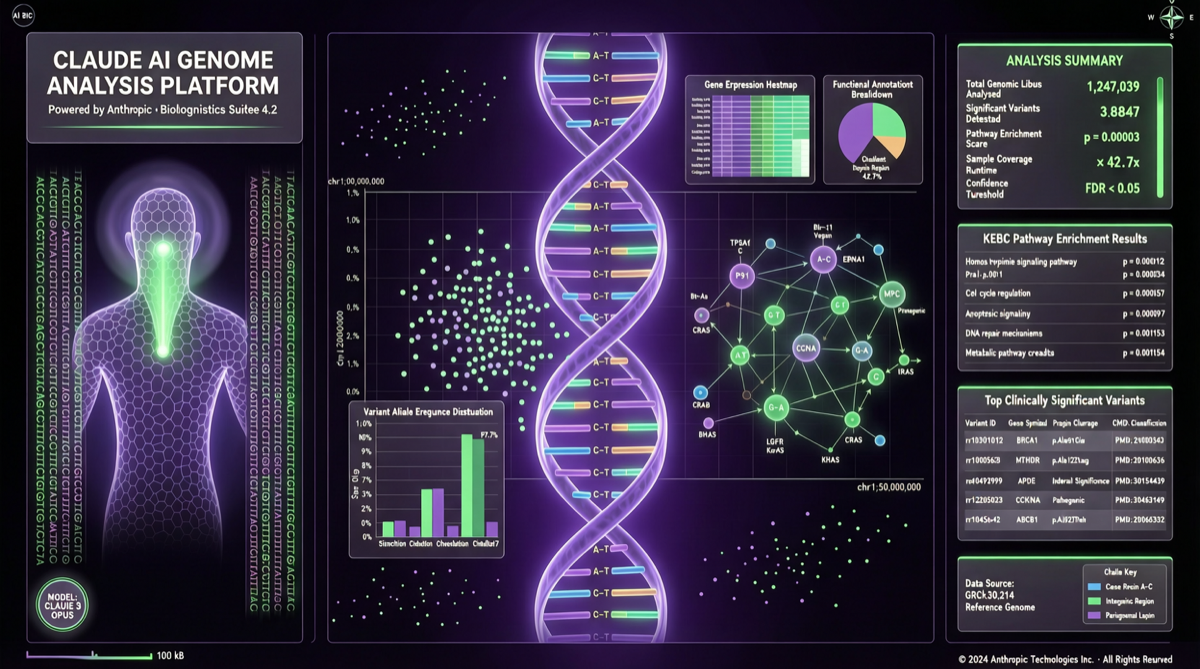

AnthropicがBioMysteryBenchベンチマークをリリース。99の実際の生物データ問題でClaudeを評価。うち23問は人類の専門家も歯が立たない問題であり、Claude最新モデルは約30%を解決した。本評価ではこの結果の意義と限界を検証する。

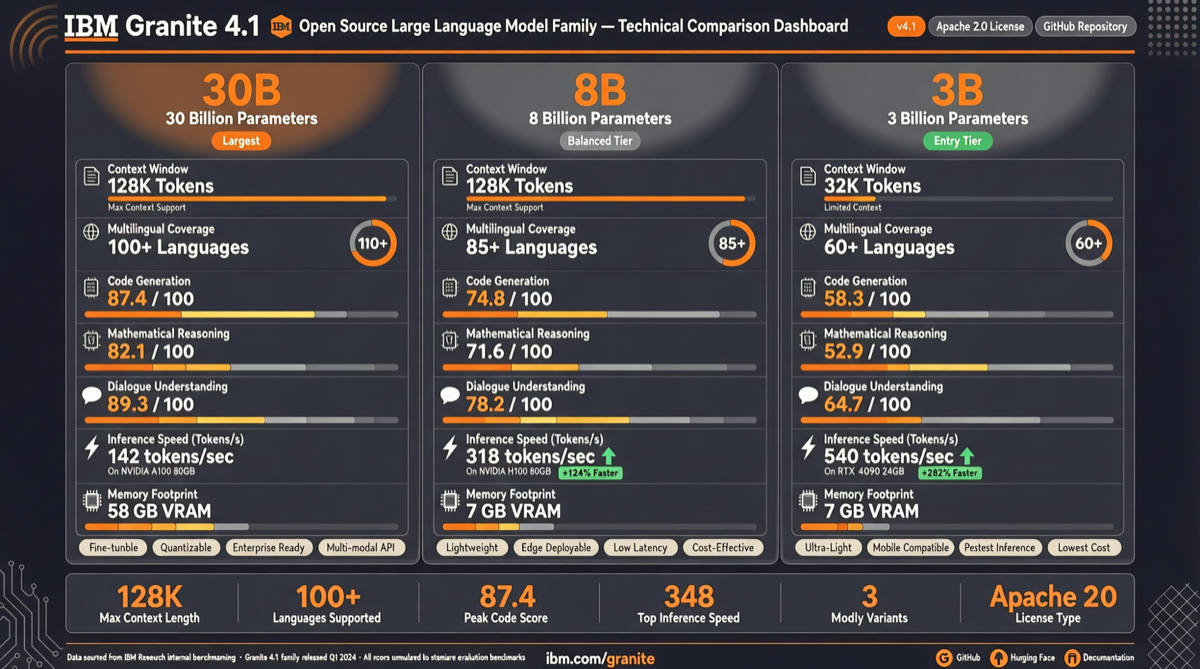

IBMがGranite 4.1シリーズ(30B/8B/3B)をApache 2.0ライセンスでリリース。Artificial Analysis知能指数でそれぞれ15/12/9点を獲得。本評価ではトークン効率、コーディング能力、商用適用性を検証する。

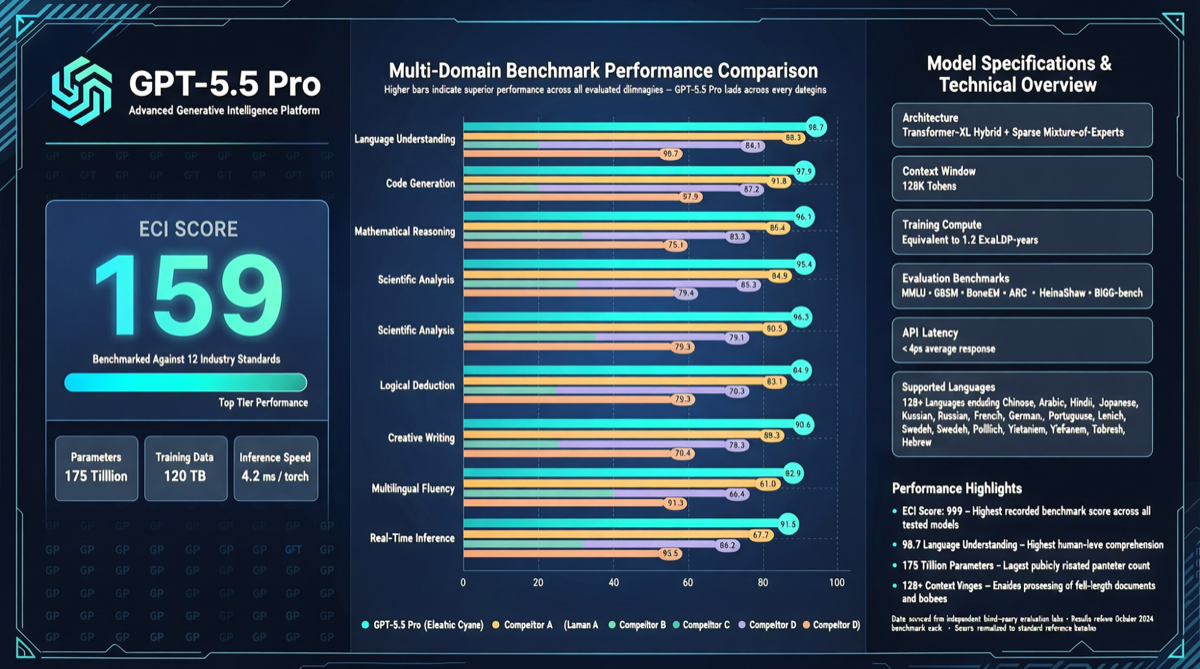

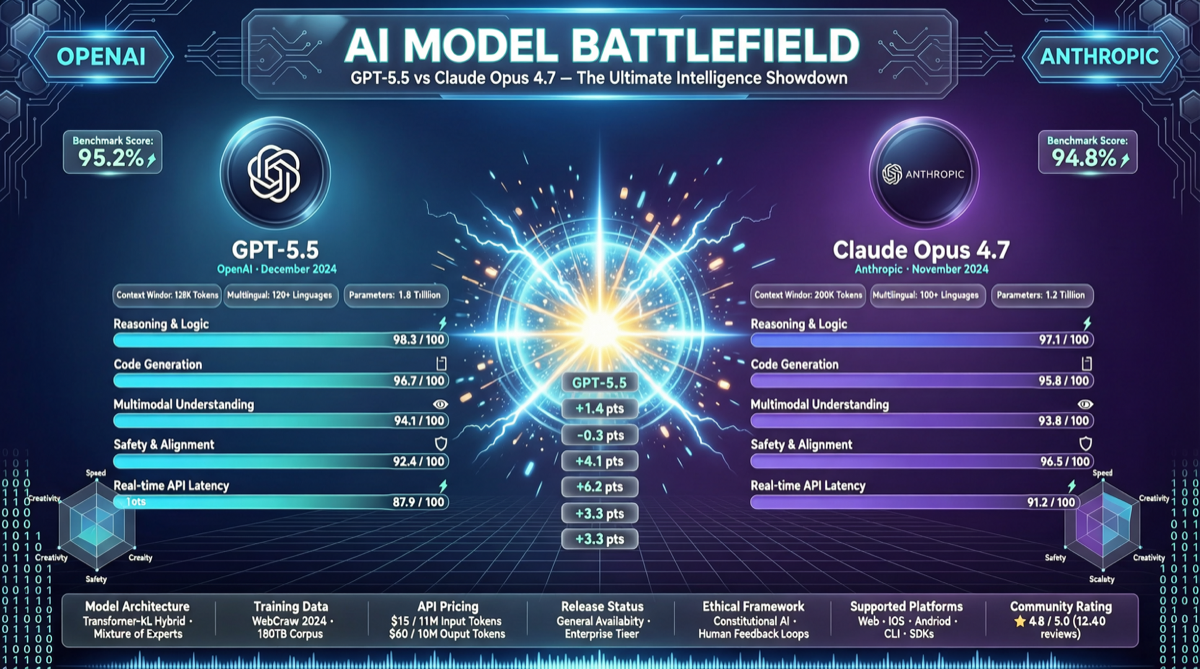

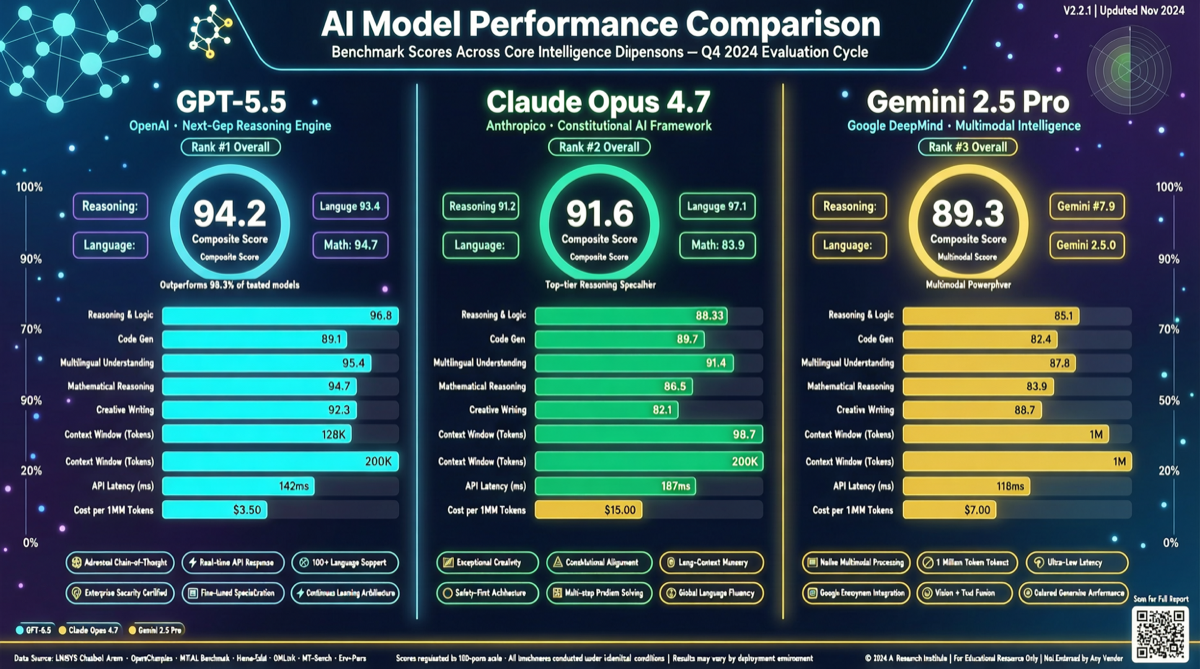

GPT-5.5 ProがECI(Epoch Capabilities Index)総合指標で159点を記録し、過去最高を更新。本記事ではこのスコアの意味を多次元で解き明かし、GPT-5.4およびClaude Opus 4.7と比較した上で、モデル選定の指針を示す。

AnthropicはClaude.aiユーザーにAI使用体験を共有するよう呼びかけ、約8.1万人が参加し、迄今最大規模の多言語定性研究となった。調査結果はユーザーの核心期待、使用習慣と懸念を明らかにし、製品選択と発展方向にデータ支援を提供した。

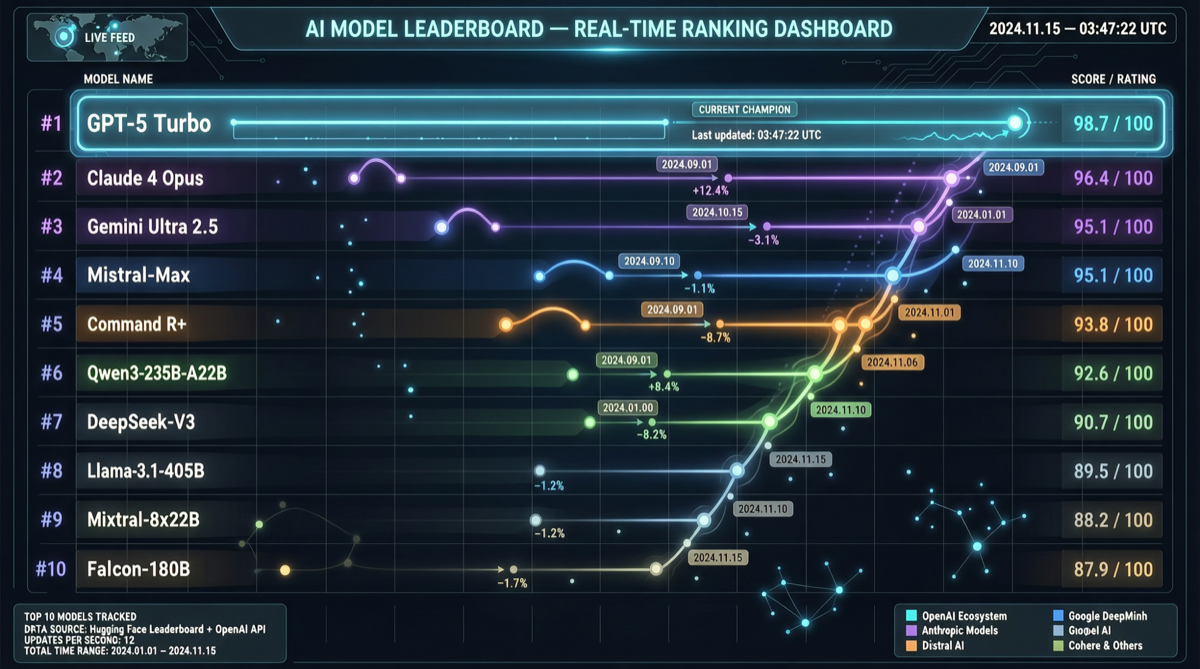

4月20日にClaudeが最佳AIと宣言されたが、5日後にGPT-5.5がリリースされ、排行榜が全面洗牌。2026年Q1には4つのフロンティアモデルがリリースされ、モデル間の優位格差は縮小し、「最佳」は安定したラベルではなく流動的な状態になっている。

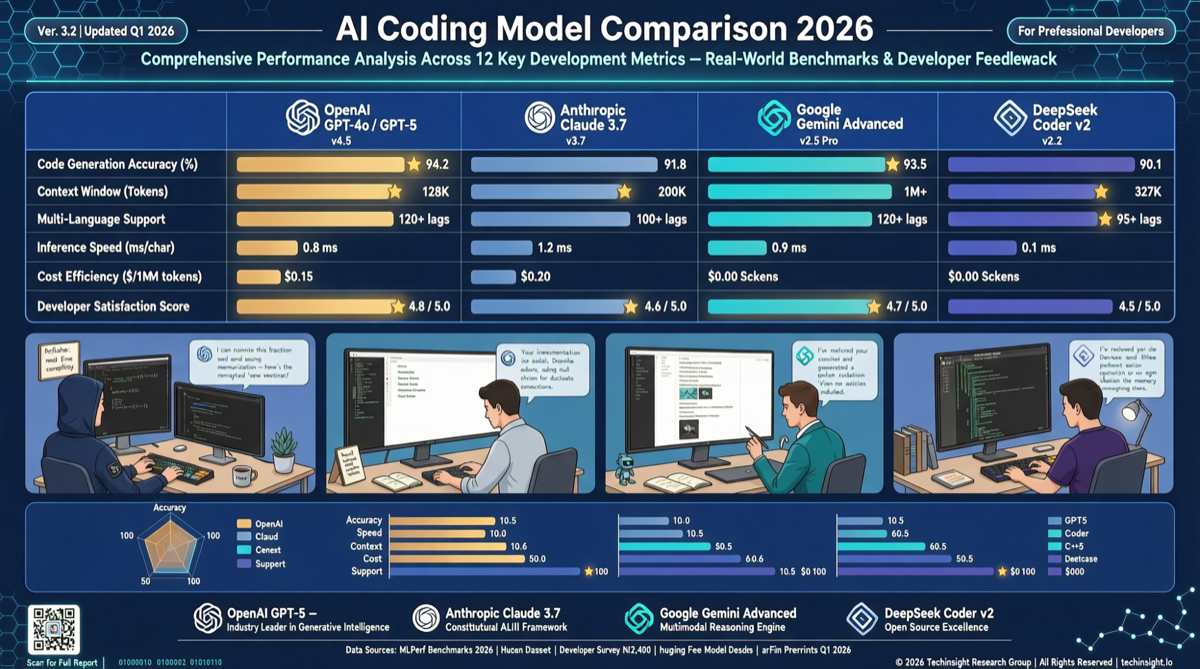

84%の開発者がAIプログラミングツールを使用または使用予定。SWE-bench Pro、Aiderリーダーボードとコミュニティ実測データに基づき、GPT-5.5、Claude Opus 4.7、Gemini 3.1 Pro、DeepSeek V4のプログラミング场景での実際の表現を比較する。

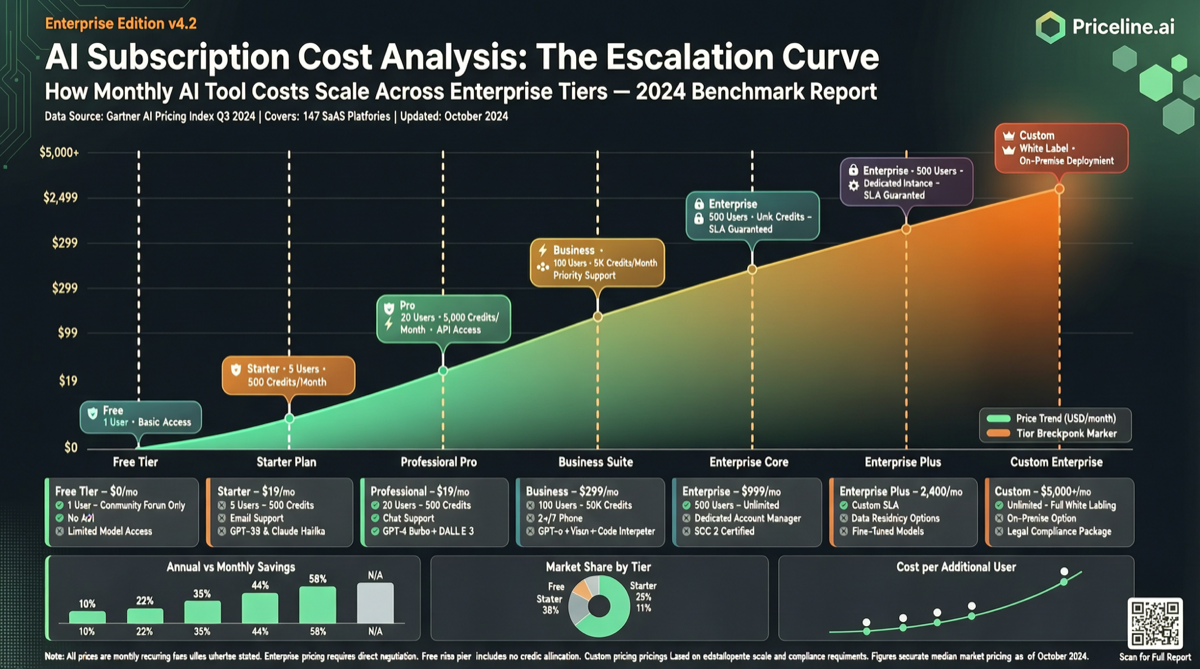

主流AIサブスクリプションの価格は$20から$200以上に広がり、モデル能力も急速に分化。コード生成、長文分析、マルチモーダル、APIクォータの4次元で異なる価格帯の実際の使用価値を評価し、最適な選択を提案する。

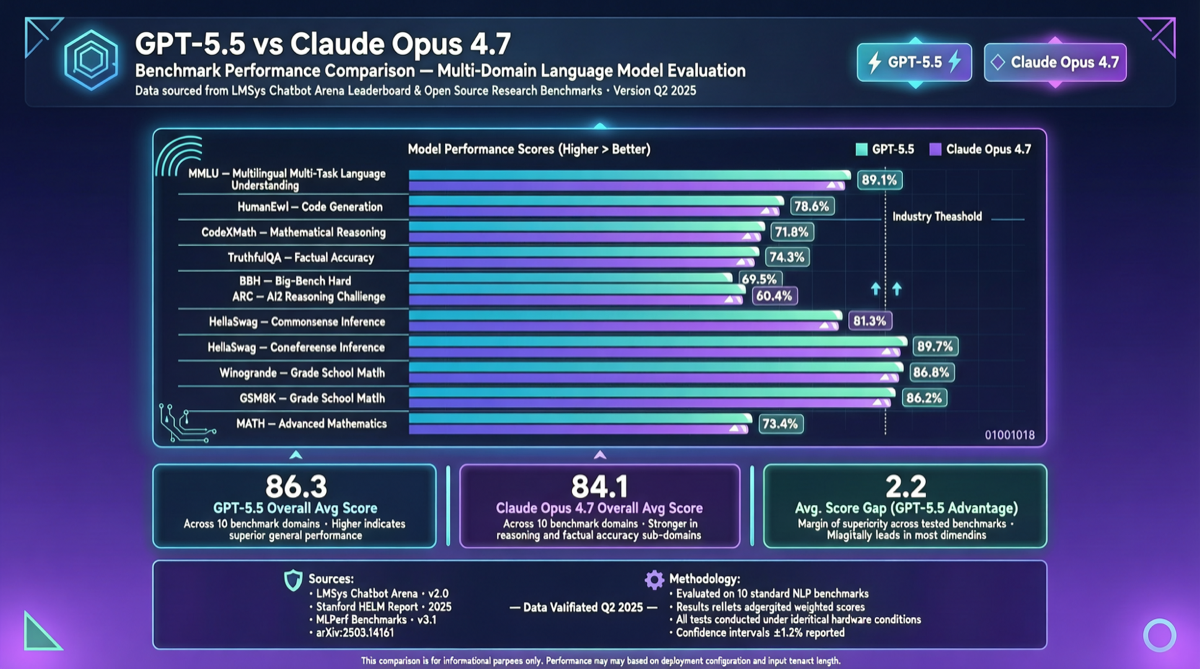

GPT-5.5は4月23日にリリースされ、Terminal-BenchやGDPvalなどのベンチマークでClaude Opus 4.7を上回ったが、SWE-bench ProのコーディングタスクではOpus 4.7が依然として優位。5つの次元で両フラッグシップモデルを比較する。

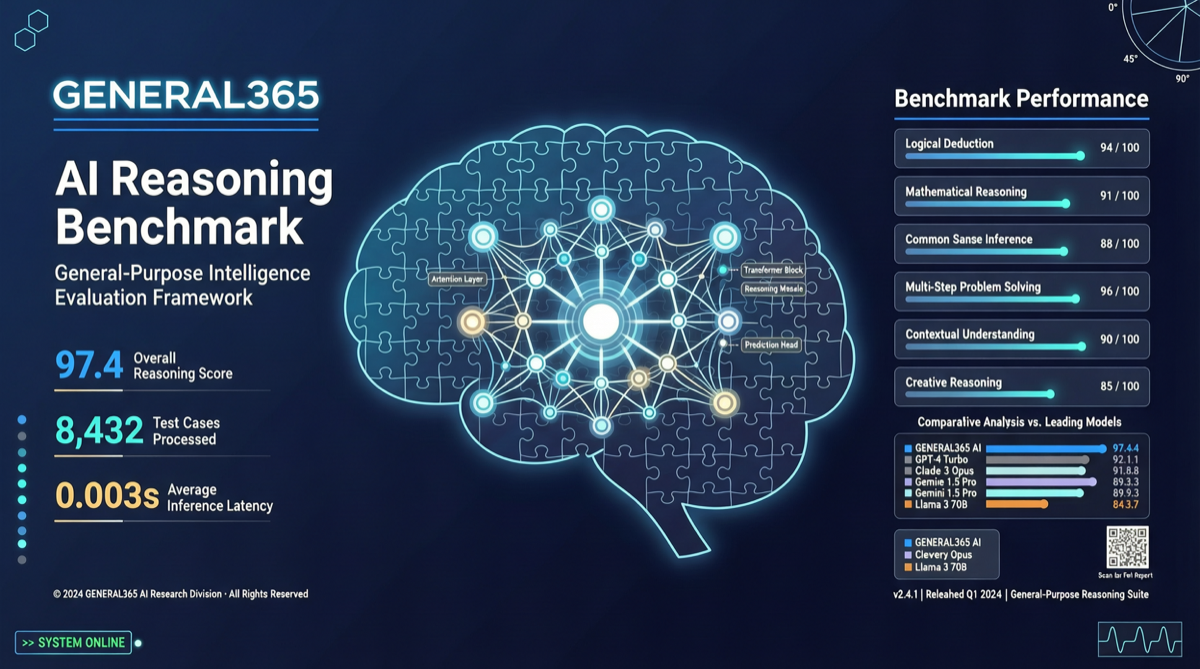

GENERAL365ベンチマークが4月27日リリース。365問の人力策划推理難題、複雑な制約、ネスト論理、意味的干渉をカバー。現最強モデルは10%未満、大モデルの汎用推論能力の真の短板を露呈。

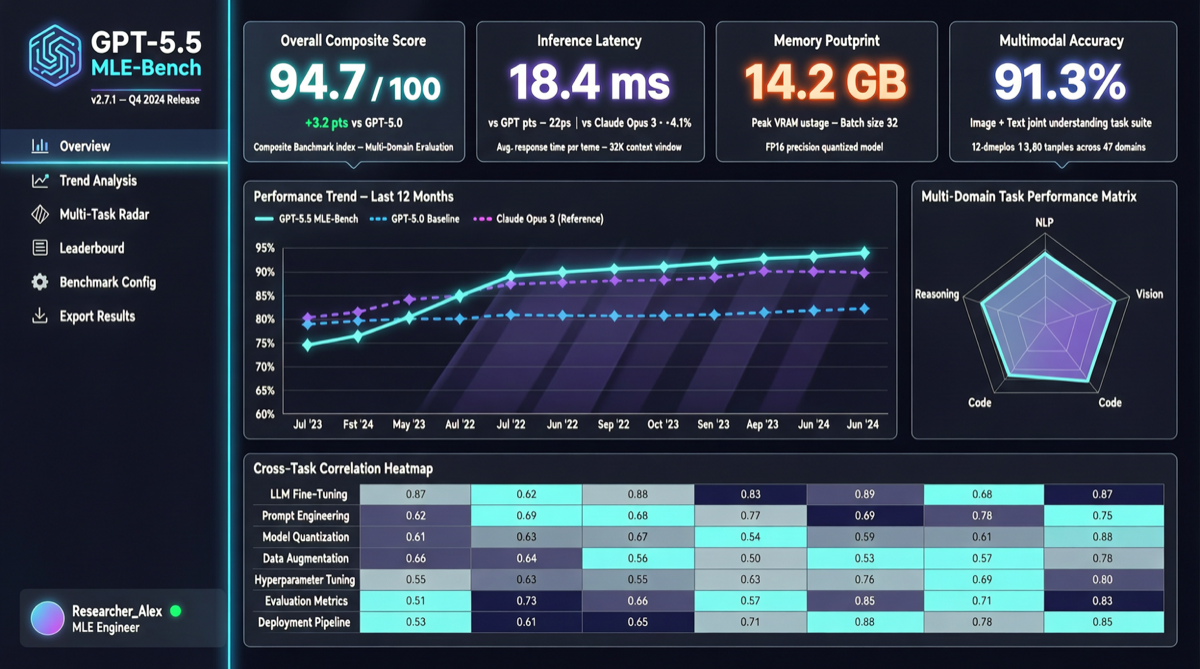

GPT-5.5がMLE-Benchで36%を達成、GPT-5.4の23%から13ポイント改善。このベンチマークはAIが実際のMLエンジニアリングタスクを自律完了する能力を測定する。

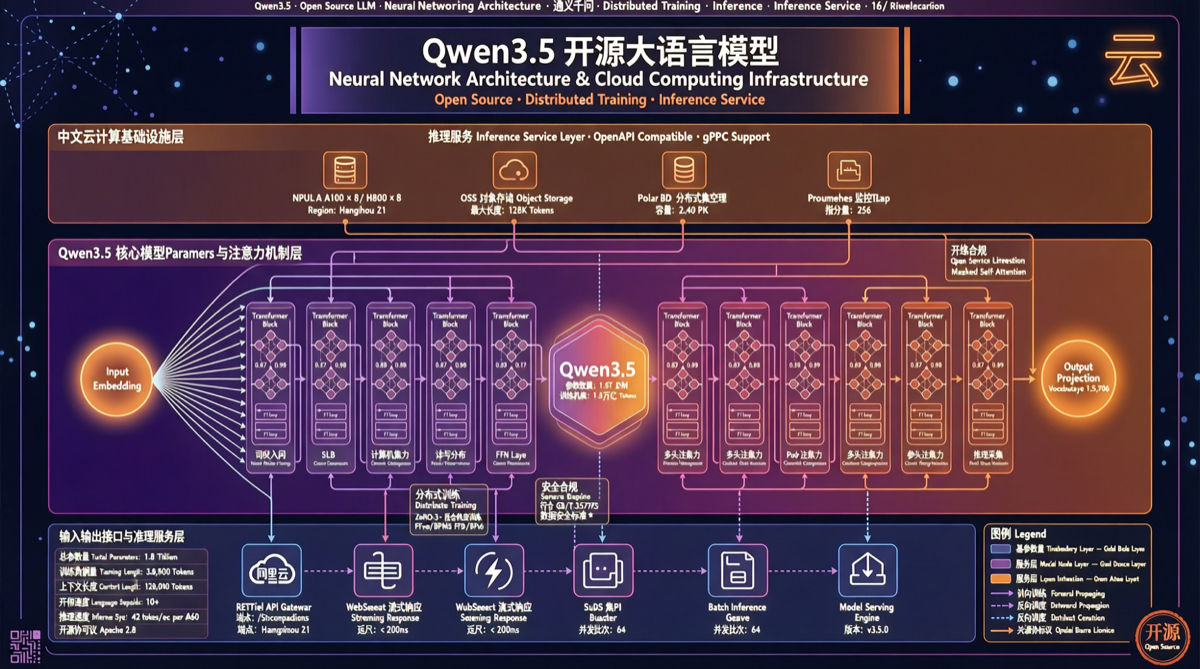

アリババQwen 3.5は0.8Bから397Bまでカバー。疎MoEアーキテクチャで中型モデルが上一世代大型モデルを超越。ネイティブマルチモーダルと256Kコンテキストで開発者のオープンソース首选。

LMArena EloランキングでAnthropic Opus 4.7が1503点で首位。AA総合指数でGPT-5.5シリーズが1・2位を独占。Meta Muse Sparkが初めてトップ10入り。

OpenAI GPT-5.5とAnthropic Claude Opus 4.7が相次いでリリース。SWE-bench ProでClaudeが5.7%リード、GPT-5.5はMRCR百万コンテキストで大幅领先。選択はコア场景次第。

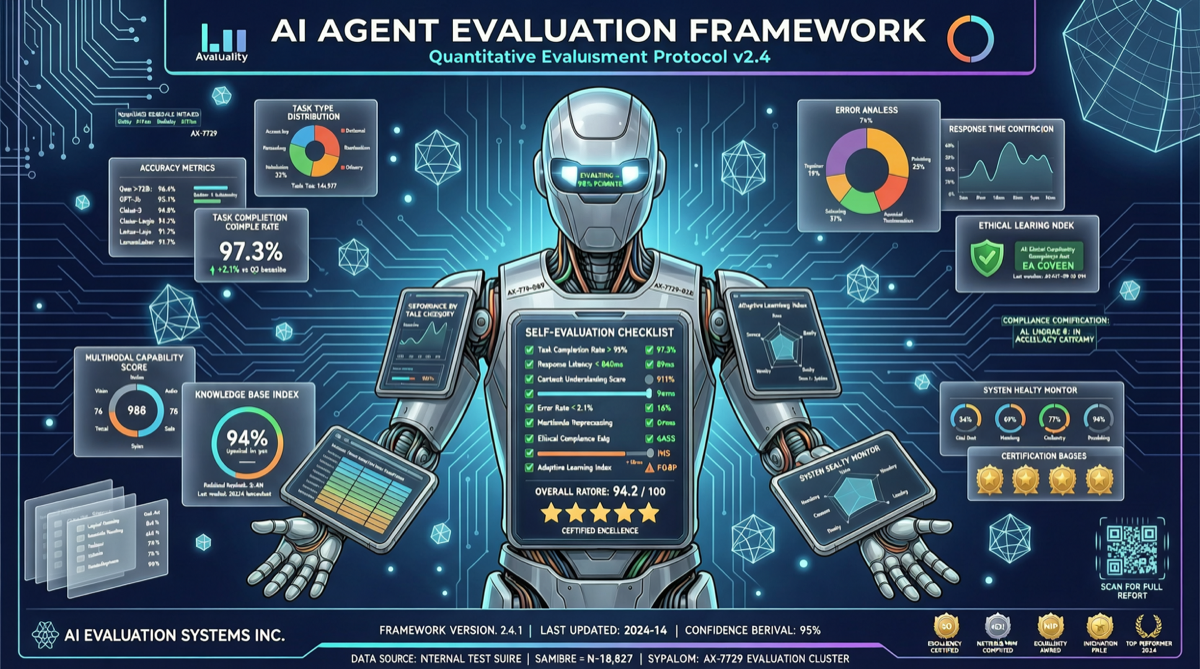

従来のベンチマークはAI Agent能力の説明力を失いつつある。2026年に登場したTerminal-BenchやAgenticSwarmBenchなどの新評価フレームワークが、次世代Agent能力評価基準を定義している。

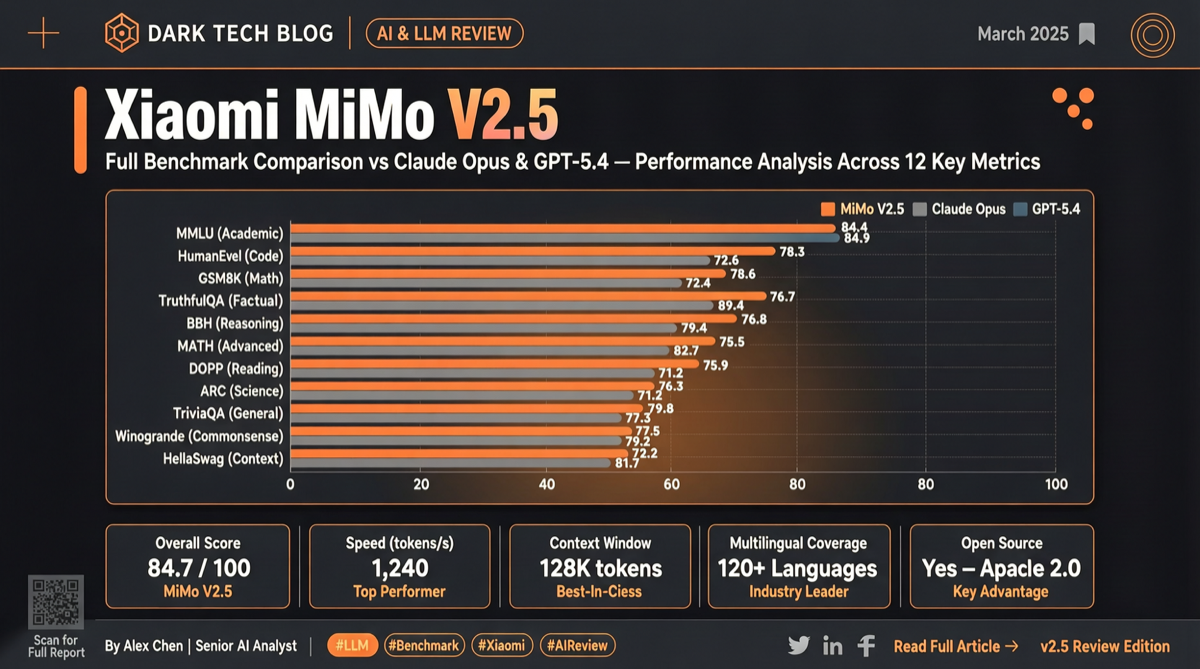

小米MiMo-V2.5-ProはChatbot Arenaテキスト榜で世界6位・オープンソース1位、Agent専門指数でオープンソース1位、百万レベル長文脈をサポートし、ほぼ全ての国産推論チップに対応。

アリババ千問Qwen3.6シリーズがオープンソース化。27B稠密モデルと35B-A3B MoEモデルを含み、コード能力はClaude 4.5 Opusに迫り、百万トークン長文脈をサポート。

SWE-bench Pro、HLE、MRCR、Arenaデータを総合すると、Claude Opus 4.7はコードと推論で優位、GPT-5.5は長文脈とターミナルワークフローで強く、Gemini 3.1 Proはコストパフォーマンスに優れる。

2026年4月のChatbot ArenaランキングでAnthropicがテキスト上位4枠を独占する一方、Meta muse-sparkや小米MiMo-V2.5-Proなどのオープンソースモデルが差を縮め、オープンソース1位がグローバル6位にランクイン。

Future AGI 開発の MuleRun は完全な AI Agent プラットフォーム。SDK やコミュニティ版ではなく、UI、バックエンド、シミュレーションエンジン、評価、最適化ループ、可観測性を含むフルスタックのオープンソースソリューション。Agent の自己改善、Creator Studio による商用デプロイ、Vibe Training などの革新的機能をサポート。

アリババ HappyHorse 1.0 のグレーテスト期間中に多角的テストを実施。人物接写で優れたパフォーマンスと信頼性の高いリップシンクを確認。一方、大規模シーン構図は最適化の余地あり。

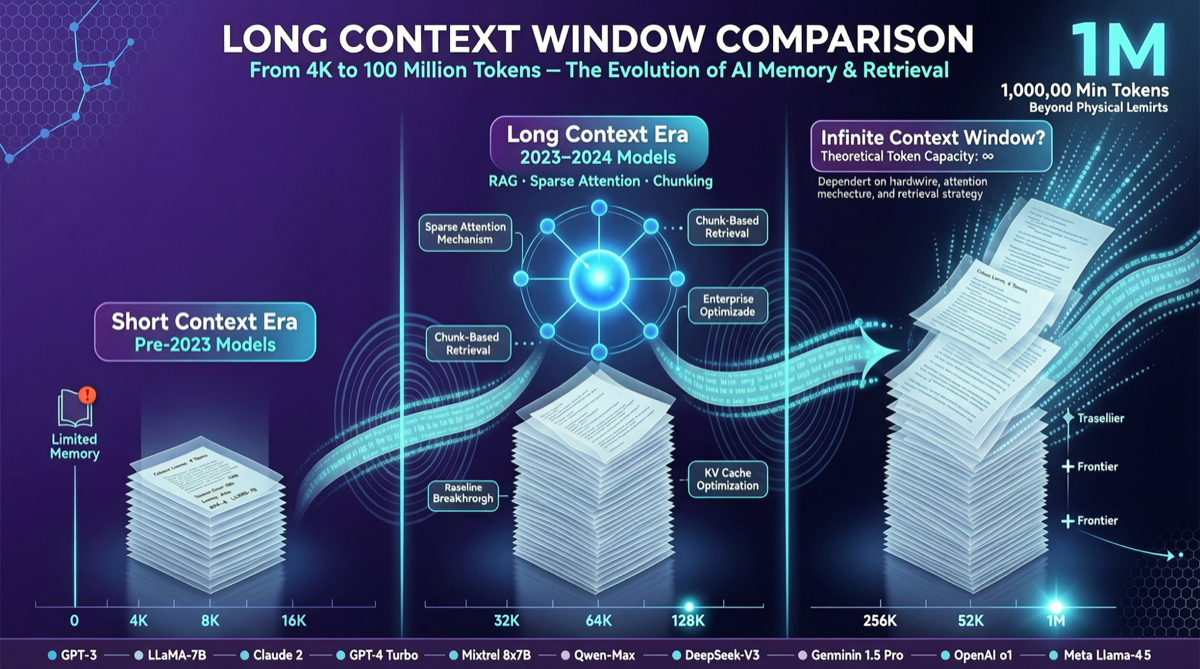

百万トークンコンテキストウィンドウはフラッグシップモデルの標準となったが、実際の可用性には大きな差がある。GPT-5.5は1M検索で74%を達成、Claude Opus 4.7は32.2%のみ。各モデルを正直に评测。

GPT-5.5は定価が最も高いがトークン効率が最高。Gemini 2.5 Proはトークン単価が最低だが同タスクにより多くのトークンが必要。Artificial Analysisの実測データで真のタスクコストを明らかにする。

アリババQwen 3.6-27Bは270億稠密パラメータでTerminal-BenchにおいてClaude 4.5 Opusに並び、18GBメモリで動作。「小型で強力」なモデルの実力を評価。

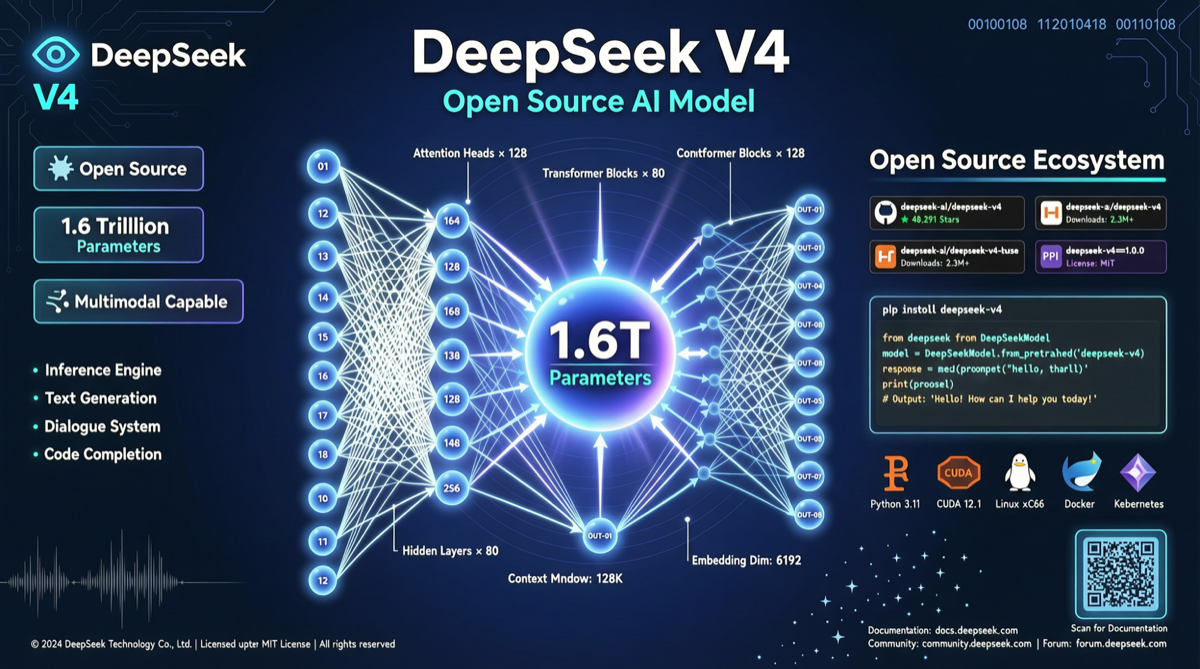

DeepSeek V4が1.6Tパラメータ、100万トークンコンテキスト、Apache 2.0ライセンスで登場。華為昇騰チップでほぼ完全に訓練された初のモデル。実際の能力を評価する。

OpenAI GPT-5.5、Anthropic Claude Opus 4.7、Google Gemini 2.5 Proが相次いで登場。コーディング、推論、長文コンテキスト、実コストの4次元で比較し、シーン別のおすすめを提示。

推論、コーディング、文章作成、マルチモーダル性能を横断比較する。

小米 MiMo-V2.5 実測レビュー:4 時間無中断で 54 アプリの macOS 複製版を生成、672 回のツール呼び出しでコンパイラを一から構築。Agent 能力は Claude Opus 4.6 に追平、Token 消費は 40%-60% 削減。