結論

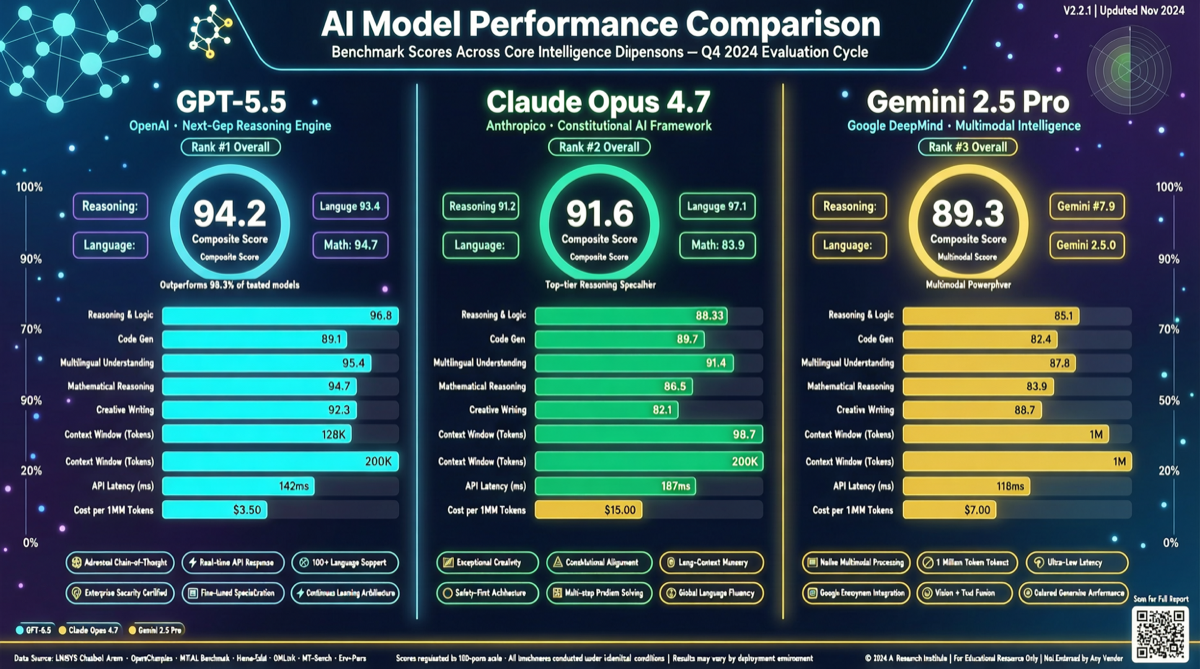

GPT-5.5はコーディングとエージェントワークフローでリードし、Claude Opus 4.7はソフトウェアエンジニアリングタスクで優位を維持、Gemini 2.5 Proは劇的に低いAPIコストでほぼ同等の総合能力を提供。「最高」はなく、「タスクに最適」があるだけ。

エンドツーエンドのエージェントオーケストレーションにはGPT-5.5、大規模コードベースのリファクタリングにはClaude Opus 4.7、コスト重視のバッチタスクにはGemini 2.5 Pro。

テスト次元

コーディング能力

SWE-bench Pro(実際のGitHub課題解決)では、Claude Opus 4.7が64.3%でトップ、GPT-5.5は58.6%。ただしOpenAIはAnthropicのレポートの一部に学習データの記憶の兆候があると指摘。Terminal-Bench 2.0(複雑なコマンドラインワークフロー)では、GPT-5.5が82.7%に達し、他を大きく引き離している。

実用上の重要な違いはトークン効率にある。Artificial Analysis Intelligence Indexの全10項を完遂するコストは、Claude Opus 4.7が$4,811、GPT-5.5が$3,357。GPT-5.5はより少ないトークンで同じタスクを完了し、実際の運用コストは30%低い。

推論と数学

HLE(Hard Latent Evaluation)ではClaude Opus 4.7が46.9%、GPT-5.5が41.4%。AIME 2025数学コンテストでは両者とも満点に近く、差は統計誤差の範囲内。日常的な推論タスクにおいて、両モデルのユーザー体感に大きな差はない。

長文コンテキスト

GPT-5.5が差をつける次元。MRCR @ 1M(100万トークン中の重要情報検索)でGPT-5.5は74%、Claude Opus 4.7は32.2%。技術文書全体や大規模コードを読み込ませて特定情報を定位させる場合、GPT-5.5の優位性は決定的。

速度とレイテンシ

OpenAIはGPT-5.5がGPT-5.4と同等のレイテンシを維持しつつ「より高いインテリジェンス」を提供すると主張。コミュニティのフィードバック:初回トークンまでの時間はGPT-5.4と同等だが、ストリーミング出力速度は向上。Claude Opus 4.7は「高速モード」がないため、反復ワークフローでは体感速度が劣る。

実際のコスト

| モデル | 入力 ($/MTok) | 出力 ($/MTok) | AA Index完遂コスト |

|---|---|---|---|

| GPT-5.5 | $5 | $30 | $3,357 |

| Claude Opus 4.7 | $5 | $25 | $4,811 |

| Gemini 2.5 Pro | $1.25 | $10 | $861 |

おすすめ

個人開発者・学生: Gemini 2.5 Pro。価格の割に能力が十分。

エンタープライズエージェントワークフロー: GPT-5.5。再試行が少なく、長文コンテキストが強く、スケールとともに優位性が増幅。

大規模コードベース保守: Claude Opus 4.7。SWE-bench Proでのリードは確実。ただしGitHub CopilotではOpus 4.7は3.6倍の乗数。

ハイブリッド戦略: 複雑な推論にはGPT-5.5、単純バッチにはGemini 2.5 Proでコスト50%以上削減可能。