結論

百万トークンコンテキストは「百万トークンで使える」ことを意味しない。GPT-5.5が現在最も信頼性の高い長文コンテキスト検索モデル(MRCR @ 1M 74%)、DeepSeek V4とGemini 2.5 Proは中間(約50-60%)、Claude Opus 4.7は大ウィンドウで弱い(32.2%)。

文書全体や大型コードベースを理解させることがコアニーズなら、GPT-5.5が現在最も信頼できる選択。

テスト次元

検索精度

MRCR(Multi-Reference Context Retrieval)——100万トークンでの重要情報定位能力:

| モデル | MRCR @ 1M | 説明 |

|---|---|---|

| GPT-5.5 | 74% | Haystackの中の針を見つける能力が最高 |

| Gemini 2.5 Pro | ~60% | 堅実だが詳細の取りこぼしあり |

| DeepSeek V4 | ~50% | 使えるが複雑なクエリで情報消失 |

| Claude Opus 4.7 | 32.2% | 大ウィンドウで注意力が分散 |

コンテキスト減衰

すべてのモデルで「減衰効果」が存在——文書の先頭と末尾の情報は保持されやすく、中間部分は見落とされがち:

- GPT-5.5: 減衰が最も緩やか、中間セクションの保持率が显著に高い

- Gemini 2.5 Pro: 先頭・末尾は優秀、中間は中等度の減衰

- Claude Opus 4.7: 長文コンテキストは訓練の優先事項ではない様子、減衰が激しい

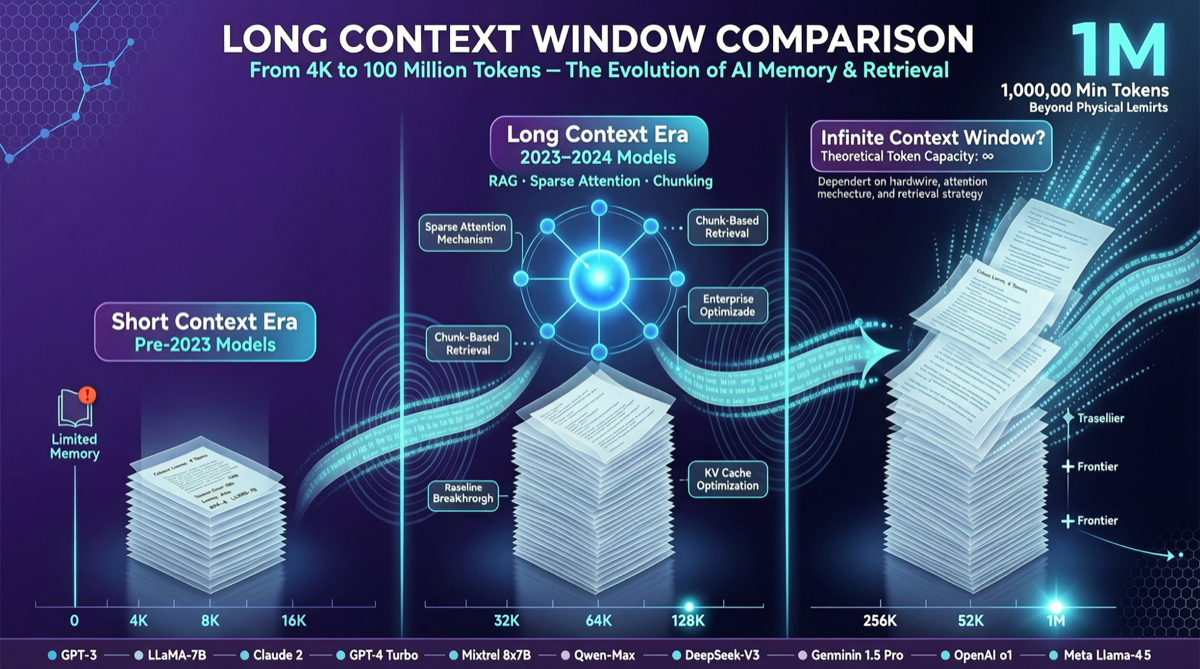

新技術動向

AMDがHyLo(Hybrid Long-context)アーキテクチャ論文を発表。事前学習後に低コストで長文コンテキスト能力を追加可能、ショートコンテキスト品質の低下は最小限。使用可能コンテキストを200万トークンに拡張。

おすすめ

長文ドキュメントからの精密情報検索: GPT-5.5。74%のMRCRは現在無敵。

概要理解のみ: どのフラッグシップモデルでも十分——一番安いものを選べばよい。

RAG vs 長文コンテキスト: 「多数の文書から特定情報を検索」なら、従来のRAGの方が純粋な長文コンテキストより信頼性が高い。