結論

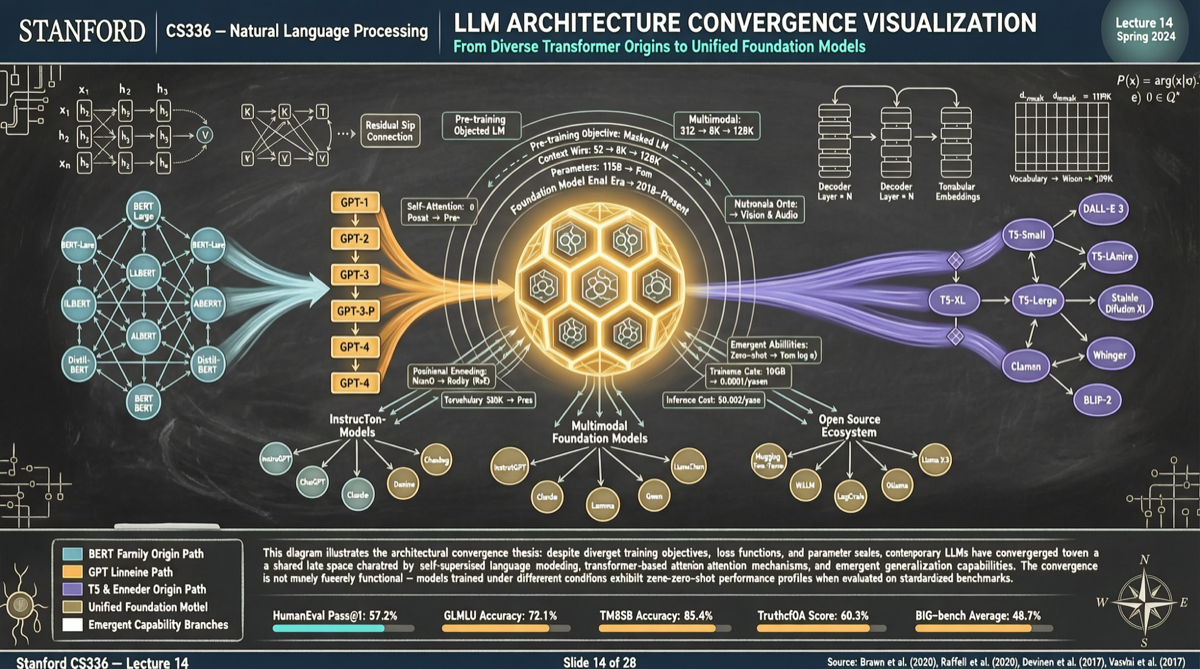

スタンフォードCS336(LLMトレーニングコース)の講師Tatsuが最近の講義で極めて情報密度の高いことを行った:過去3年間のすべての主流LLMを解体し、それらのアーキテクチャ選択を一つずつ比較したのだ。

結論はかなり「爆発的」だった:アーキテクチャ選択の90%がすでに収束している。 どのオープンソースの大モデルを適当に選んでも——Qwenにせよ、Llamaにせよ、DeepSeekにせよ、GLMにせよ——これらの次元においてほぼ同じになっている。

講師の原話で過去3年間を3文でまとめると:

- 2024年:みんなLlama 2のコスプレをしていた

- 2025年:テーマは「どうやって崩壊せずに訓練するか」

- 2026年:?

アーキテクチャ収束はどこに表れているのか

Tatsuのコースは以下のコア次元を解体し、ほぼすべての主流モデルが同じ方案を選択していることを発見した:

1. Transformerのバリアント

ほぼ例外なくDecoder-onlyアーキテクチャ。Encoder-decoder(T5系)は汎用LLM領域で完全に周辺化されている。MoE(Mixture of Experts)は「オプション」から「大モデルのデフォルト設定」に変化した。

2. アテンションメカニズム

Multi-Head AttentionからGrouped Query Attention(GQA)への移行は業界全体でほぼ同時に完了した。GQAは推論速度とVRAM占有量での優位性によって、疑いようもなく勝利した。

3. 正規化層

RMSNormがLayerNormに取って代わって标配となり、Pre-Normアーキテクチャが深い訓練で示す安定性によって、ほぼ誰も異議を唱えていない。

4. 活性化関数

SwiGLUが天下を統一。ReLU、GeLUは新しいモデルでほぼ絶滅した。

5. 位置エンコーディング

RoPE(Rotary Position Embedding)は長いコンテキストを必要とするシナリオで事実上の標準となっている。ALiBiは特定のシナリオ(ストリーミング推論など)でまだ位置を占めている。

なぜ収束が2024-2025年に起こったのか

これは偶然ではない。アーキテクチャ収束の背後には3つの力の重なりがある:

コンピューティングコスト:70B+モデルの訓練コストは数百万ドルに達し、試行錯誤の余地は極めて小さい。Llama 2が7B〜70Bの範囲で一組のアーキテクチャ選択の有効性を検証した後、後発者には覆してやり直すインセンティブがほとんどない。

オープンソースの透明性:Llamaシリーズのオープンソース化により、すべてのアーキテクチャの詳細が透明になった。後発のモデルチームは「再発見」する必要がない——直接参照すればよい。

理論的裏付け:スケーリング法則(Scaling Laws)の研究が日増しに成熟し、コミュニティは「どの設計が大規模で有効か」についてより明確な認識を持つようになった。

2026年のテーマは何か

アーキテクチャが収束した以上、競争は何に移ったのか?

データの質と訓練の安定性。

講師は2026年のコア競争次元が以下の方向にシフトしていることを示唆した:

- データ比率の最適化:コード、数学、多言語、指示データの最適な混合比率

- 訓練プロセスの安定性:loss spikeやgradient explosionをどう回避するか

- Post-training方法:RLHF、DPO、ORPOなどのアライメント方法の効率と品質

これこそが、QwenやDeepSeekなどの国産モデルがアーキテクチャが収束した状況下でも、データ戦略と訓練工芸によって著しい性能差異を生み出せる理由を説明している。

従事者にとっての意味

もしあなたが以下のことをしているなら、この情報は重要だ:

- モデル選定:「独特なアーキテクチャ」というマーケティング話術に惑わされてはならない。本当の差異はデータと後訓練にある

- ローカルデプロイ:アーキテクチャが収束している以上、あるモデルの最適化経験(量子化方案や推論フレームワークなど)を他のモデルに移転できる

- 研究の切入点:アーキテクチャレベルの革新空間がますます小さくなるなら、次の突破口はデータ側か訓練方法論から来る可能性が高い

この収束格局における国産モデルの位置

注目すべき詳細:国産モデル(Qwen、DeepSeek、GLM)はアーキテクチャ収束の潮流に追いついただけでなく、ある次元で差異化も生み出している:

- Qwenが多言語能力と長いコンテキストへの継続的な投資

- DeepSeekがMoEアーキテクチャと推論コスト最適化における積極的な戦略

- GLMが中国語理解とローカライズされた知識における優位性

アーキテクチャ収束は能力収束を意味しない——データと訓練工芸こそが本当の分水嶺である。

一言

LLMアーキテクチャの収束は革新の終焉ではなく、競争次元の転換である。2026年のモデル戦争が懸けているのはデータであり、訓練工芸であり、アライメント品質だ——そしてこれらはまさに国産モデルが力を注いでいる領域なのである。