結論

アリババの通義千問チームがQwen-Scopeを正式にオープンソース化した。これは疎自己符号化器(Sparse Autoencoder, SAE)に基づくモデル内部表現分析・制御ツールキットで、Qwen3およびQwen3.5シリーズの計7モデルをカバーする。その核心的価値は**「モデルのファインチューニングなしで、内部特徴量を操作することで出力行動を方向制御できる」**ことにある。

これは単なるオープンソースのおもちゃではない。Anthropicなどの機関による最先端のmechanistic interpretability(機械的解釈可能性)研究を、初めて体系的にエンジニアリング化し、中国語大モデルエコシステムに適合させたものだ。

核心機能の内訳

| 機能次元 | 具体的な機能 | 実用的価値 |

|---|---|---|

| 特徴定位 | モデル内部の特定のニューロン/特徴を特定 | モデルが「なぜ」その出力を生むのかを理解 |

| 出力制御 | 推論段階で特徴活性化に介入 | トレーニングなしでモデルの行動傾向を調整 |

| 分類器構築 | 少量のシードデータで特徴分類器を訓練 | 特定の概念や意図を低コストで検出 |

| サンプル合成 | 特徴活性化に基づいてロングテールサンプルを生成 | レアなシナリオのトレーニングデータを拡充 |

| 異常検知 | 異常出力を引き起こす特徴を特定 | モデルの「悪い癖」を迅速に診断 |

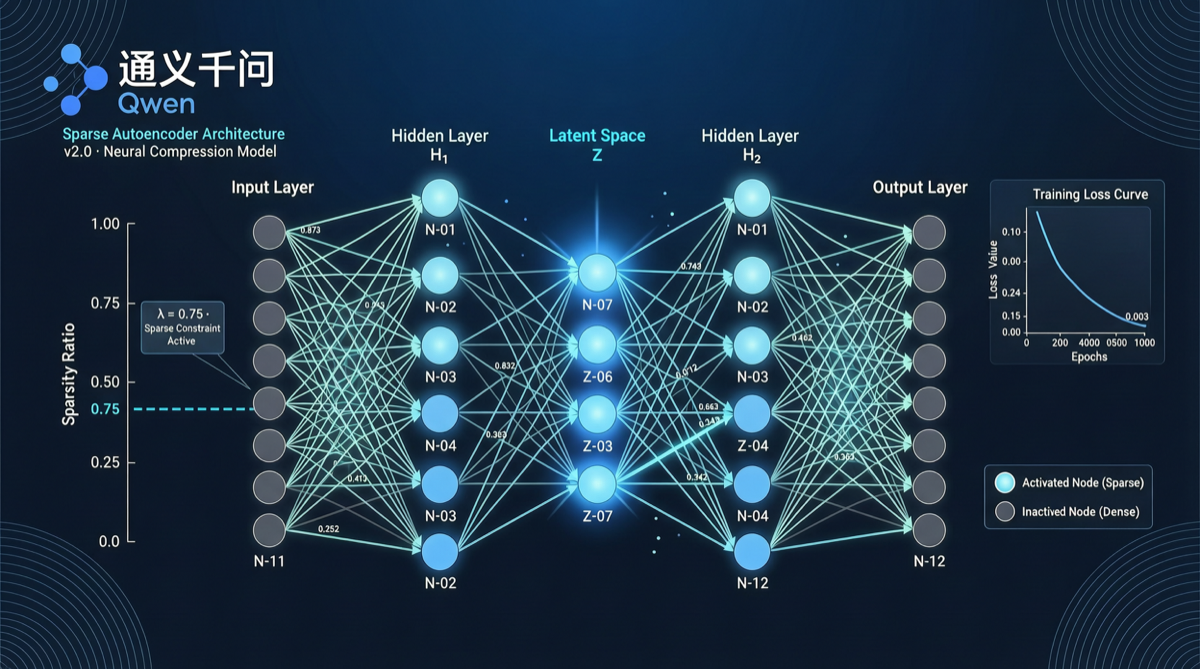

技術原理の概要

Qwen-Scopeのワークフローは3ステップ:

- SAEの訓練:モデルの隠れ層(通常はMLPまたはAttentionの出力)に疎自己符号化器を訓練し、高次元の密な活性化を多数の疎な「特徴」に分解する

- 特徴アノテーション:自動または半自動で各特徴に意味ラベルを付ける(例:「中国語特徴」「コード特徴」「安全拒否特徴」など)

- 特徴介入:推論時に特定の特徴を増強または抑制し、出力の精密制御を実現

このアプローチの巧妙な点は**「モデルを再訓練する必要がなく、推論時に「いくつかのつまみを回す」だけでよい」**ことだ。

カバーするモデル

Qwen-Scopeは以下の7モデルをサポート:

- Qwen3-0.6B / 1.7B / 4B / 8B

- Qwen3.5-4B / 8B / 14B

小規模から中規模までのすべての主流仕様をカバーし、異なるデプロイメントニーズに対応。

実際の適用シナリオ

シナリオ1:言語混在の除去

モデルが中国語の回答に不自然に英語を混在させる場合、「英語特徴」を特定し、推論時に適度に抑制すれば、より純粋な中国語の出力が得られる。

シナリオ2:繰り返し生成の削減

モデルが繰り返し出力を行う場合、繰り返しパターンに対応する特徴を特定して抑制することで、生成品質を大幅に改善できる。

シナリオ3:安全性アラインメントの強化

RLHFをやり直すことなく、「安全拒否特徴」の活性化強度を増やすだけで、有害なリクエストに対してモデルをより敏感にできる。

シナリオ4:特定ドメイン知識の注入

ターゲットドメインの重要な特徴を特定し、推論時にその活性化を強化する。これはモデルに「臨時補習」を施すようなもの。

業界の見通し

Qwen-Scopeのオープンソース化はいくつかの重要なシグナルを発している:

- 解釈可能性ツールが研究からエンジニアリングへ:SAEはもはや論文の中の概念ではなく、ダウンロード・インストール・利用できるツールキットになった

- 中国語モデルの解釈可能性エコシステムが始動:これまでSAEツールは主に英語モデル(Claude、GPT)を対象としていたが、Qwen-Scopeがこの空白を埋めた

- ファインチューニングコストの大幅削減が可能に:特徴制御はファインチューニングの代替手段として、特定のシナリオで大量のコンピューティングリソースと時間を節約できる

AnthropicのSAE研究と比較して、Qwen-Scopeの独自優位性は中国語の言語特性に最適化されている点にある。中国語のトークン化特徴、中英混在検知など、英語モデルツールではカバーできない領域だ。

アクション提案

- モデル開発者:Qwen-Scopeを使ってモデルの特定の行動問題を診断。盲目的なパラメータチューニングより効率的

- アプリケーション側:モデルの出力品質問題に直面した際、まずは特徴制御を試す。再ファインチューニングが不要かもしれない

- 研究者:Qwen-Scopeをベースに中国語大モデルの解釈可能性の新ベンチマークを構築

使い方

# リポジトリのクローン

git clone https://github.com/QwenLM/Qwen-Scope.git

cd Qwen-Scope

# 依存関係のインストール

pip install -r requirements.txt

# 学習済みSAEのロード(Qwen3-8Bの例)

from qwen_scope import SAELoader

sae = SAELoader.from_pretrained("Qwen3-8B-MLP-SAE")

# 推論時の特徴介入

controlled_output = sae.generate(

prompt="あなたの質問",

feature_modulations={"chinese_purity": 1.5, "english_mixed": -0.8}

)SAEの重みはHugging FaceとModelScopeで公開されており、直接ロードして使用できる。

データソース

- GitHub: github.com/QwenLM/Qwen-Scope

- 通義千問公式アナウンス