国産モデル + Agentフレームワーク:エコシステム統合の重要な一歩

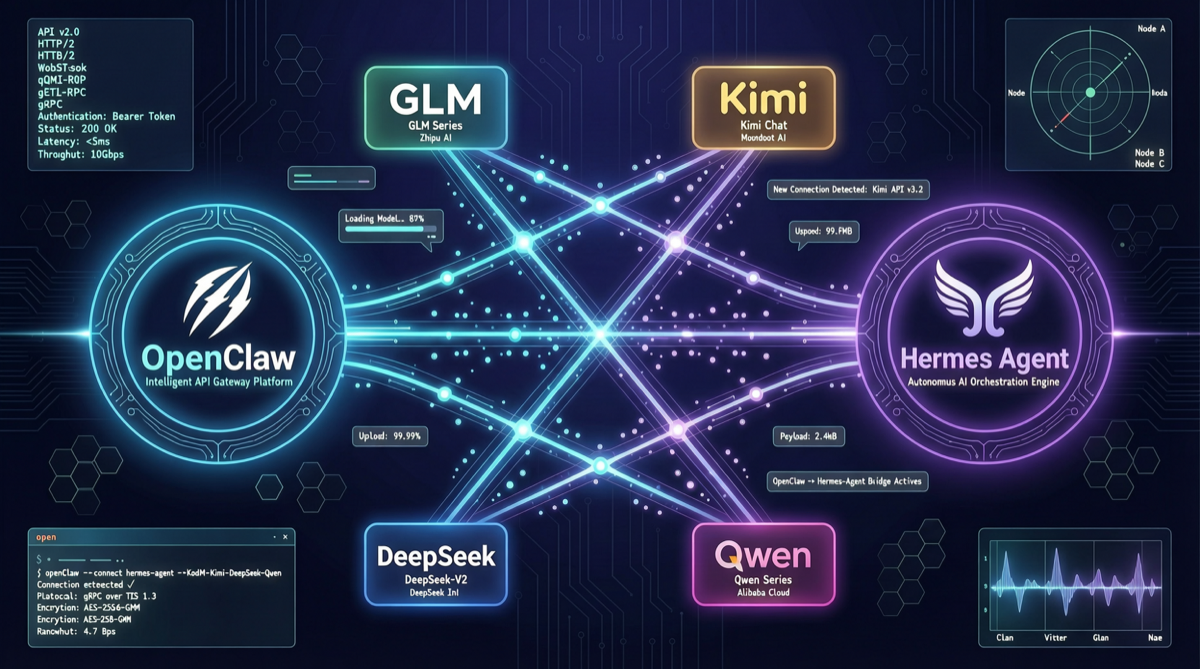

2026年上半期、AI Agentフレームワークのモデル互換性に画期的な変化が訪れました:OpenClawとHermes Agentが主要な中国国産AIモデルを全面サポートしたのです。

これは、開発者が単一モデルベンダーのエコシステムにロックインされなくなったことを意味します。GLM-5.1、Kimi K2.6、DeepSeek V4 Pro、Qwen 3.6などのモデルを同じAgentフレームワーク内で切り替え、タスクタイプとコスト予算に応じて柔軟に選択できます。

サポートされている国産モデル一覧

| モデル | プロバイダー | 統合方法 | 最適な用途 |

|---|---|---|---|

| GLM-5.1 | 智譜 | API / OpenClaw組み込み / Hermes MCP | コーディングAgent、コードレビュー |

| Kimi K2.6 | 月之暗面 | API / Hermes組み込み / OpenClaw | 長文脈、大規模コードベース |

| DeepSeek V4 Pro | DeepSeek | API / OpenClaw組み込み | コスト効率のコーディング、デバッグ分析 |

| Qwen 3.6 Max | アリババ | API / Hermes MCP | Agentコーディング、マルチファイル共同作業 |

| MiniMax M2.7 | MiniMax | API | 高頻度Agent呼び出し |

| MIMO V2.5 Pro | 小米 | API / Ollama | コードAgent、エッジデプロイ |

OpenClaw統合設定

OpenClawのモデル設定は .openclaw/config.yaml で管理され、マルチモデル切り替えをサポートします。

GLM-5.1 統合

models:

glm-5.1:

provider: zhipu

apiKey: "${ZHIPU_API_KEY}"

model: glm-5.1

contextWindow: 131072

maxTokens: 8192

temperature: 0.3GLM-5.1のOpenClawでの優位性はコード生成の安定性です。テストでは、GLM-5.1が20ラウンド以上の継続的コーディング対話で変数名の convention を維持できることが示されました——国産モデル中最強です。

Kimi K2.6 統合

models:

kimi-k26:

provider: moonshot

apiKey: "${MOONSHOT_API_KEY}"

model: kimi-k2.6

contextWindow: 256000

maxTokens: 16384

temperature: 0.2Kimi K2.6の256Kコンテキストウィンドウが最大の強みです。数十のソースファイルを同時に読み取る必要があるリファクタリングタスクなどの大規模コードベースシナリオでは、Kimiは他の国産モデルを大幅に上回ります。

DeepSeek V4 Pro 統合

models:

deepseek-v4-pro:

provider: deepseek

apiKey: "${DEEPSEEK_API_KEY}"

model: deepseek-v4-pro

contextWindow: 128000

maxTokens: 8192

temperature: 0.4DeepSeek V4 Proの核心的競争力はコスト効率です。トークンあたりのコストは国産モデル中最も低く、大量のAPI呼び出しを必要とするAgentワークフローに最適です。

コスト比較:Agentシナリオでの国産モデル

1日100回のAgent呼び出し、1回あたり平均8000入力 + 4000出力トークンを想定:

| モデル | 入力 ($/M) | 出力 ($/M) | 日成本 | 月成本 |

|---|---|---|---|---|

| GLM-5.1 Coding Plan | サブスク | サブスク | — | ¥469 |

| Kimi K2.6 | ~$0.50 | ~$1.00 | ~$0.07 | ~$2.10 |

| DeepSeek V4 Pro | $0.60 | $1.20 | $0.072 | $2.16 |

| Qwen 3.6 Plus | ~$0.30 | ~$0.60 | $0.036 | $1.08 |

| MiniMax M2.7 | $0.30 | 未公開 | < $0.05 | < $1.50 |

重要な発見:国産モデルのAgent利用コストはGPT-5.5の1/10〜1/20にすぎず、個人開発者や小規模チームにとって経済的に実行可能なAgentデプロイメントを提供します。

実践テクニック

1. モデルルーティング:タスクタイプによる自動切り替え

routing:

rules:

- pattern: ".*コード生成|関数作成|実装.*"

model: glm-5.1

reason: "コード生成の安定性が最高"

- pattern: ".*分析.*ファイル|リファクタ.*プロジェクト|.*全コード.*"

model: kimi-k2.6

reason: "長文脈の優位性"

- pattern: ".*デバッグ|バグ特定|.*なぜエラー.*"

model: deepseek-v4-pro

reason: "推論チェーンが完全"2. フォールバック戦略

fallback:

primary: glm-5.1

secondary: kimi-k2.6

tertiary: deepseek-v4-pro

maxRetries: 3モデル選択の意思決定ツリー

主なタスクは何ですか?

├── コード生成 / 機能実装

│ ├── 安定した高品質出力が必要? → GLM-5.1

│ └── コスト重視? → Qwen 3.6 Plus

├── 大規模コードベース / マルチファイルリファクタリング

│ └── → Kimi K2.6(長文脈)

├── デバッグ / トラブルシューティング

│ └── → DeepSeek V4 Pro(推論が完全)

├── 高頻度Agentループ呼び出し

│ └── → MiniMax M2.7(最低コスト)

└── 一般タスク / 日常支援

└── → Qwen 3.6 Plus(最高のコスパ)まとめ

2026年上半期、Agentフレームワークにおける国産モデルの統合度は質的な飞跃を遂げました。「API接続のみ」から「ゼロ設定ワンクリック統合」、「かろうじて使える」から「確実に使える」へ——国産モデルはAgentエコシステムでますます重要な役割を担っています。

開発者にとって、これは重要な転換点を意味します:単一モデルベンダーに依存する必要はもうありません。データベースを選択するように、タスクタイプ、パフォーマンスニーズ、予算に応じて国産モデルを柔軟に組み合わせ、最適なAgentワークフローを構築できます。

主な情報源: