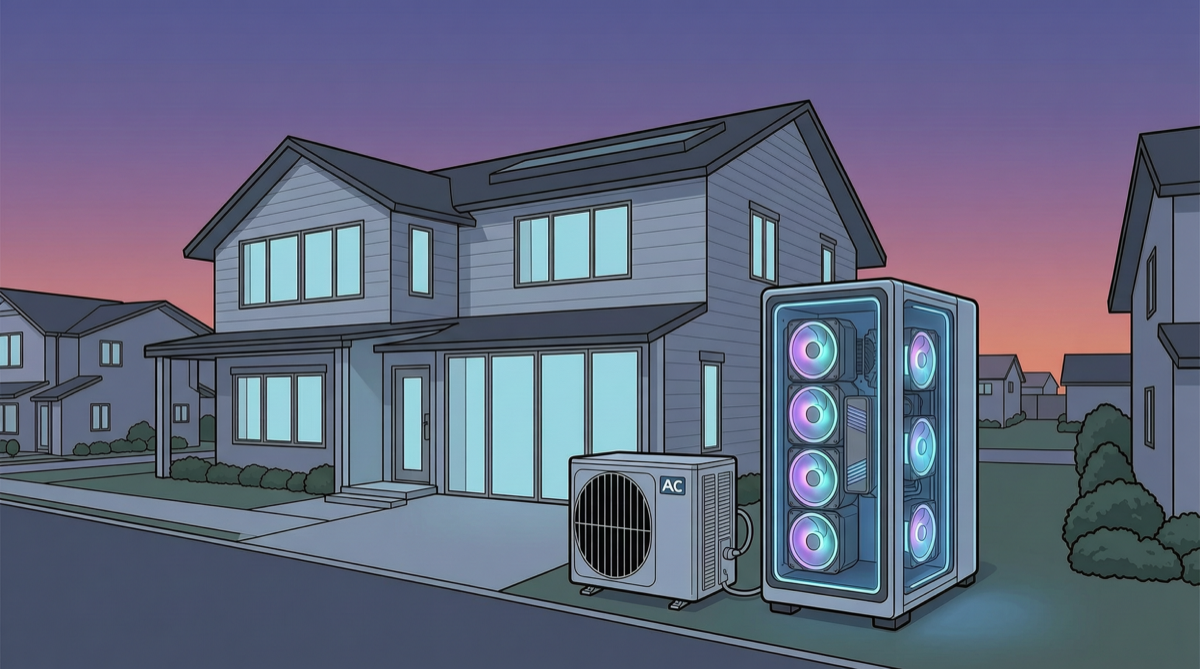

Nvidiaが全員を立ち止まらせた方案を発表した:家の屋外エアコンユニットの隣にAIデータセンターを設置し、ホスト対価として家主に支払う。

これはSFではない。Nvidiaが新たに発表した**XFRA(eXtensible Fabric for Residential AI)**ノードソリューションだ。その登場は、AI算力デプロイメントの根本的な変化——集中型データセンターから分散型エッジネットワークへの移行——を意味している。

XFRAノード仕様

| コンポーネント | 仕様 |

|---|---|

| GPU | 16基のBlackwell RTX Pro 6000 |

| CPU | 4基のAMD EPYC |

| メモリ | 3TB RAM |

| フォームファクター | Dell PowerEdgeラックマウント |

| デプロイ場所 | 家庭用ACコンデンサー隣(屋外キャビネット) |

| 家主コスト | $0 |

| 家主収益 | 収益分配 |

単一XFRAノードの総算力は、小型データセンターに匹敵する。16基のBlackwell GPUのFP4推論性能は、数百の同時LLMインスタンスをサポートするのに十分だ。

なぜ「エアコンの隣」なのか?

このデザインは思いつきではない:

- 冷却:ACコンデンサーエリアには既存の冷却インフラがある——GPUが発生する熱をエアコンシステムで持ち去れる

- 電力:住宅用電力網には通常十分な余力があり、特に日中の太陽光発電ピーク時に余裕がある

- スペース:屋外キャビネットは屋内スペースを占有せず、騒音はキャビネットの防音処理で対応

- ネットワーク:家庭用ブロードバンドの上り帯域幅は推論ワークロードに十分——専用線は不要

ビジネスモデル

Nvidiaのロジック:数十億ドルをかけてデータセンターを建てる代わりに、算力を何千もの家庭ノードに分散する。各ノードのコストはNvidiaが負担、家主は収益分配を得る。

家主のロジック:ゼロコストの「裏庭の印税機」——収益はNvidiaがAI企業に算力を貸し出すことから生まれる。

AI企業のロジック:土地、建設、大規模O&Mコストが不要なため、従来のデータセンターより安い算力にアクセスできる。

格局判断

XFRAの登場は、AI算力デプロイメントにおける3つのトレンドの収束を意味する:

| トレンド | 現れ | 影響 |

|---|---|---|

| 分散化 | データセンターから分散ノードへ | デプロイコスト低減、レジリエンス向上 |

| エッジAI | 算力がユーザーとデータソースに近づく | 低遅延、プライバシーコンプライアンス |

| 算力クラウドソーシング | 家庭が算力プロバイダーに | 新たな収益モデル、新たな規制課題 |

既存ソリューションとの比較:

| ソリューション | デプロイモデル | スケール | 遅延 | 用途 |

|---|---|---|---|---|

| ハイパースケールクラウド(AWS/GCP) | 集中型データセンター | 超大規模 | 中 | 汎用AI |

| Neocloud(CoreWeave等) | 専門データセンター | 大 | 中 | AI訓練と推論 |

| XFRA | 分散家庭ノード | マイクロノード | 低 | エッジ推論、ローカライズAI |

| ローカルデプロイ(家庭PC) | 単一マシン | 極小 | 最低 | 個人利用 |

XFRAが埋めるギャップ:Neocloudとローカルデプロイの間の「コミュニティ規模の算力層」。

潜在的な課題

- 規制:住宅地域での商業級算力機器の設置は、ゾーニング法や騒音規制に関わる可能性

- ネットワーク安定性:家庭用ブロードバンドの上り帯域幅と信頼性はデータセンター専用線に及ばない

- O&M:ハードウェア故障は誰が修理するのか?家主はどれくらい複雑な故障に対応できるのか?

- セキュリティ:物理的セキュリティ(機器盗難)とサイバーセキュリティ(ノード乗っ取り)の両方に対処が必要

- 電力負荷:16基のBlackwell GPUの消費電力は相当なもの——家庭用回路で耐えられるか?

行動提案

| 立場 | 提案 |

|---|---|

| 家主(米国) | Nvidia XFRAパイロットプログラムに注目。地域で開始されれば、ゼロコストで受動収入を得られる |

| AI起業家 | XFRAノードの推論コストを評価せよ。Neocloudより安くなる可能性があり、エッジ推論シナリオに適する |

| 開発者 | 分散推論フレームワークの進展に注目。XFRAにはノード間の負荷分散を管理するソフトウェア層が必要 |

| 投資家 | 「分散型算力」赛道の初期機会に注目。DePINに似ているがAI推論に特化 |

Nvidia XFRAは2026年最も過激なAIインフラ実験かもしれない。成功するかどうかはO&Mと規制の課題を解決できるかによるが、方向性そのもの——算力をどこにでも存在させる——はすでに業界のコンセンサスだ。