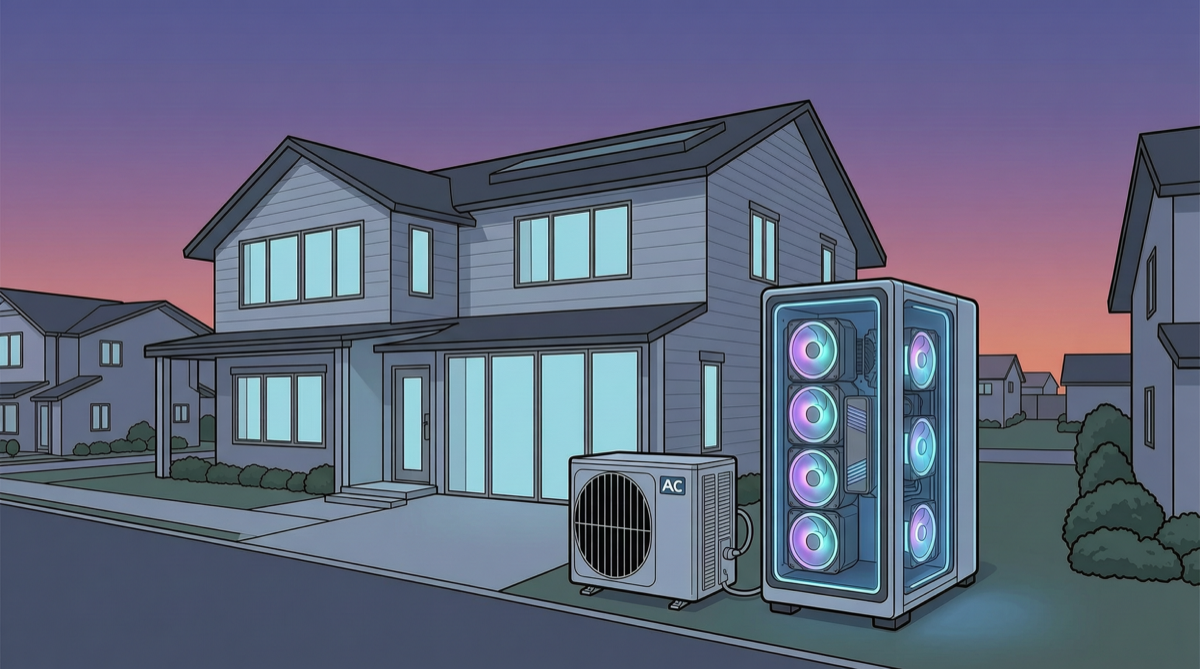

Nvidia 刚发布了一个让所有人愣住的方案:把 AI 数据中心装到你家空调外机旁边,然后付钱让你 hosting。

这不是科幻,而是 Nvidia 最新推出的 XFRA(eXtensible Fabric for Residential AI) 节点方案。它的出现意味着 AI 算力的部署模式正在发生根本性变化——从集中式数据中心走向分布式边缘网络。

XFRA 节点规格

| 组件 | 规格 |

|---|---|

| GPU | 16× Blackwell RTX Pro 6000 |

| CPU | 4× AMD EPYC |

| 内存 | 3TB RAM |

| 外形 | Dell PowerEdge 机架式 |

| 部署位置 | 家庭 AC 冷凝器旁(室外机柜) |

| 房主成本 | $0 |

| 房主收益 | 收益分成 |

一个 XFRA 节点的总算力大约相当于一个小型数据中心的规模。16 块 Blackwell GPU 的 FP4 推理性能足以支撑数百个并发 LLM 实例。

为什么是”空调旁边”?

这个设计不是拍脑袋想出来的:

- 散热:AC 冷凝器区域已经有现成的散热基础设施,GPU 产生的热量可以被空调系统带走

- 电力:住宅电网通常有充足的剩余容量,尤其是在白天太阳能发电高峰期

- 空间:室外机柜不占用室内空间,噪音由机柜隔音处理

- 网络:家庭宽带上行带宽足够支持推理负载,不需要专线

商业模式

Nvidia 的逻辑:与其花几十亿美元建数据中心,不如把算力分散到成千上万个家庭节点中。每个节点成本由 Nvidia 承担,房主获得收益分成。

房主的逻辑:零成本获得一个”后院印钞机”,收益来自 Nvidia 将算力租给 AI 公司。

AI 公司的逻辑:获得比传统数据中心更便宜的算力,因为省去了土地、建筑和大规模运维的成本。

格局判断

XFRA 的出现标志着 AI 算力部署的三个趋势交汇:

| 趋势 | 表现 | 影响 |

|---|---|---|

| 去中心化 | 从数据中心到分布式节点 | 降低部署成本,提高弹性 |

| 边缘 AI | 算力靠近用户和数据源 | 降低延迟,满足隐私要求 |

| 算力众包 | 家庭成为算力提供者 | 新的收入模式,新的监管挑战 |

对比现有方案:

| 方案 | 部署模式 | 规模 | 延迟 | 适用场景 |

|---|---|---|---|---|

| 超大规模云(AWS/GCP) | 集中式数据中心 | 超大规模 | 中 | 通用 AI |

| Neocloud(CoreWeave 等) | 专业数据中心 | 大 | 中 | AI 训练和推理 |

| XFRA | 分布式家庭节点 | 微节点 | 低 | 边缘推理、本地化 AI |

| 本地部署(家用 PC) | 单机 | 极小 | 极低 | 个人使用 |

XFRA 填补了一个空白:介于 Neocloud 和本地部署之间的”社区级算力层”。

潜在挑战

- 监管:住宅区域部署商业级算力设备,可能涉及 zoning laws 和噪音管制

- 网络稳定性:家庭宽带的上行带宽和稳定性不如数据中心专线

- 运维:硬件故障谁来修?房主能处理多复杂的故障?

- 安全:物理安全(设备被盗)和网络安全(节点被入侵)都需要解决

- 电力负荷:16 块 Blackwell GPU 的功耗不低,家庭电路能否承受

行动建议

| 身份 | 建议 |

|---|---|

| 房主(美国) | 关注 Nvidia XFRA 试点计划,如果在你所在地区推出,可以零成本获得被动收入 |

| AI 创业者 | 评估 XFRA 节点的推理成本,可能比 Neocloud 更低,适合边缘推理场景 |

| 开发者 | 关注分布式推理框架的进展,XFRA 需要配套的软件层来管理跨节点的负载分配 |

| 投资者 | 关注”去中心化算力”赛道的早期机会,类似 DePIN 但面向 AI 推理 |

Nvidia XFRA 可能是 2026 年最激进的 AI 基础设施实验。它能不能成功取决于能否解决运维和监管的挑战,但方向本身——让算力无处不在——已经是行业共识。