コアデータ

| 次元 | FlashKDA | FLA ベースライン | 高速化 |

|---|---|---|---|

| 前方推論(H20) | 最適化された CUTLASS カーネル | flash-linear-attention | 1.72×–2.22× |

| 可変長バッチ処理 | ネイティブサポート | 手動処理が必要 | ✅ |

| バックエンド互換性 | 直接置換 | — | プラグアンドプレイ |

| 基盤フレームワーク | CUTLASS | Triton | NVIDIA 公式最適化スタック |

技術ハイライト

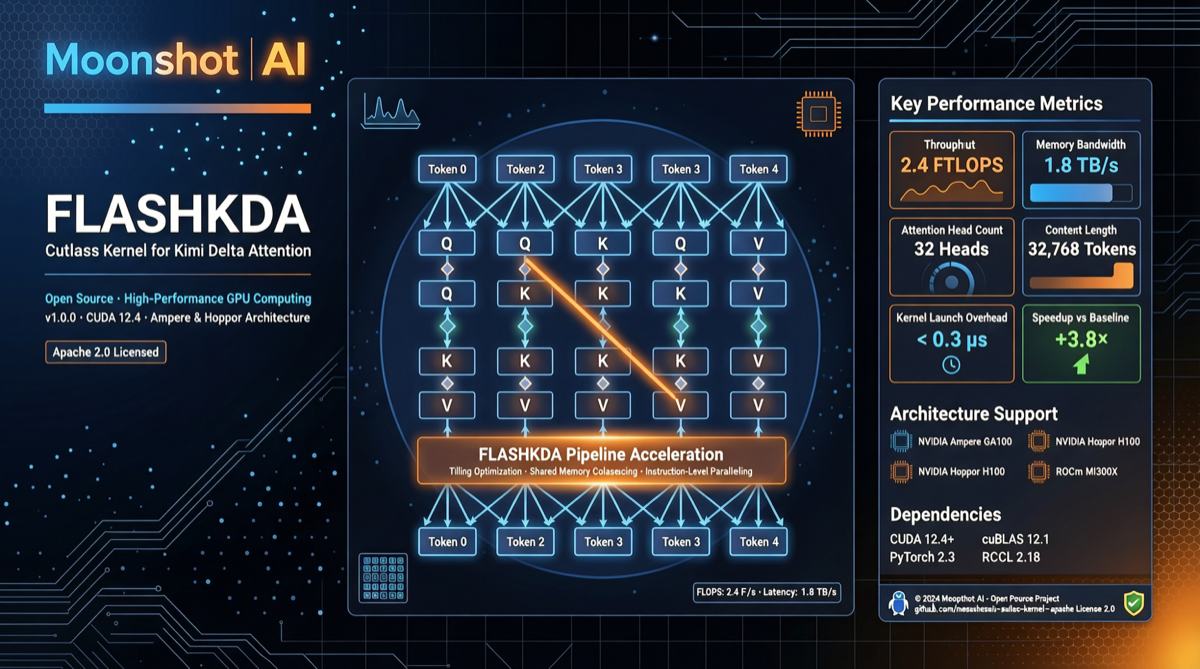

デルタアテンションとは? Kimi K2 シリーズモデルで使用されているデルタアテンションアーキテクチャは、従来の Transformer セルフアテンションとは異なり、増分計算を通じて冗長な操作を削減し、長いコンテキストシナリオに特に適しています。Moonshot は以前に Triton ベースのリファレンス実装をリリースしていましたが、パフォーマンスの最適化にはまだ余地がありました。

なぜ CUTLASS? CUTLASS は NVIDIA の公式 CUDA テンプレートライブラリで、FlashAttention-3 と同じ基盤の上に構築されています。Triton と比較して、CUTLASS は GPU メモリ階層とスレッドスケジューリングをより細かく制御でき、H20 などの国産コンピューティングカードで特に顕著です。

可変長バッチ処理の価値 実際の推論シナリオでは、リクエスト間でシーケンス長が大きく異なります。FlashKDA は可変長バッチ処理をネイティブにサポートし、従来のアプローチでのパディングの無駄を回避し、スループットを直接向上させます。

Qwen FlashQLA との比較

| FlashKDA (Moonshot) | FlashQLA (Qwen) | |

|---|---|---|

| ターゲットアーキテクチャ | デルタアテンション | GDN(ゲーテッドデルタネットワーク) |

| 基盤フレームワーク | CUTLASS | TileLang |

| H20 高速化 | 1.72×–2.22× | 2–3× |

| オープンソース日付 | 2026-04-21 | 2026-04-29 |

| 適用モデル | Kimi K2 シリーズ | Qwen3-Next/3.5/3.6 |

両方とも中国チームによるアテンションカーネル最適化の独立した探求です。Moonshot は CUTLASS ルートを、Qwen は TileLang ルートを選択しています。国産モデルで推論最適化を目指すチームにとって、これら 2 つのプロジェクトは 2 つの異なる技術パスの参考を提供します。

実践的な意義

Kimi ユーザー向け:Kimi K2 シリーズモデルをローカルでデプロイまたはファインチューニングしている場合、FlashKDA はモデルコードを変更せずに既存のアテンションバックエンドを直接置き換えることができます。

推論最適化開発者向け:これは高品質な CUTLASS アテンションカーネルのリファレンス実装であり、可変長バッチ処理のコード構造は学ぶ価値があります。

コンピューティング調達向け:H20 でのベンチマークデータは、ソフトウェアレベルの最適化が既存のハードウェアからより多くのパフォーマンスを引き出せることを示しています。必ずしも次世代チップを待つ必要はありません。

はじめに

git clone https://github.com/moonshot-ai/FlashKDA.git

cd FlashKDA

pip install -e .インストール後、flash-linear-attention のバックエンドとして直接置き換え可能です:

from flash_linear_attention import set_backend

from flashkda import KDACudaBackend

set_backend(KDACudaBackend())情勢判断

中国の大規模モデルチームは「モデルアーキテクチャの革新」から「低レベル演算子最適化」の深みに進んでいます。FlashKDA と FlashQLA の相次ぐオープンソースは、2 つの技術路線間の競争の始まりを示しています。推論コストとレイテンシーで優位性を獲得した者が、エッジ/デバイス Agent 市場で先行することになります。