結論ファースト

GoogleのGemma 4シリーズがMTP(マルチトークン予測)を正式にサポートし、投機的デコーディングを通じてローカル推論速度を2-3倍に、かつ品質劣化ゼロで加速します。

SGLangがDay 0で全4サイズのGemma 4をサポートしています。ローカルデバイスでLLMを実行する開発者とユーザーにとって、これは2026年で最も実用的な推論加速ソリューションの一つです。

MTPとは?

従来のLLMのボトルネック:一度にちょうど1つのトークンしか生成できないため、プロセッサはメモリの帯域幅待ちに多くの時間を費やします。

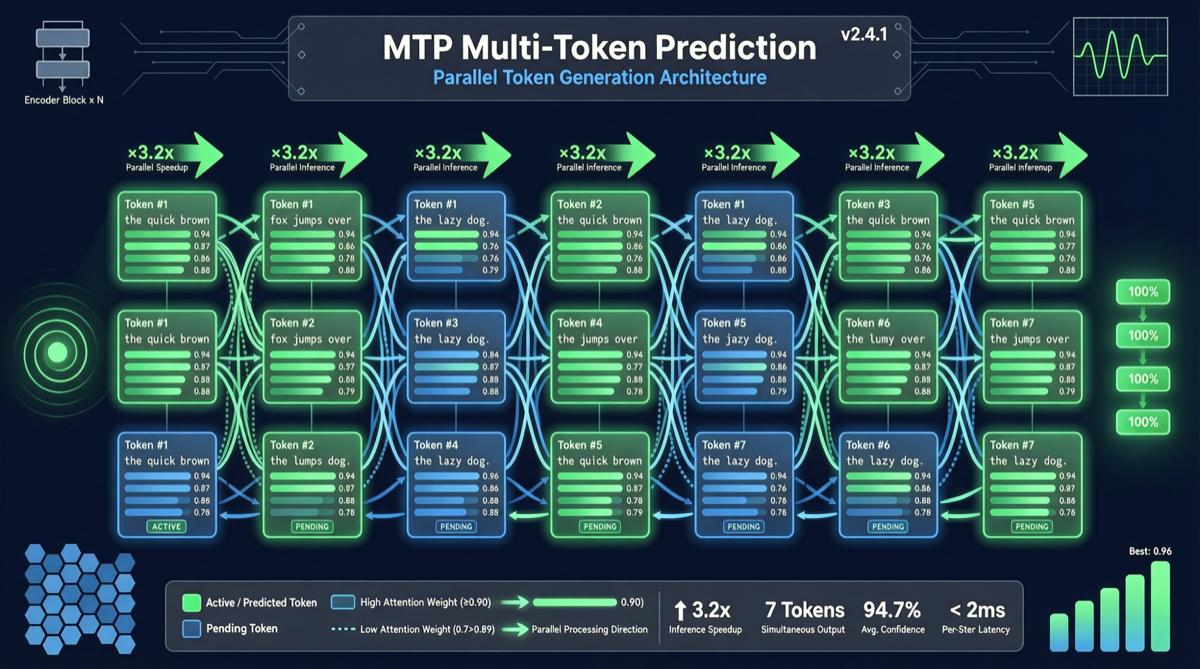

MTPの核心的なアイデア:モデルに複数のトークンを「先読み」させることで、投機的予測により生成を加速します:

従来方式: T → T → T → T → T → ...(一度に1トークン、逐次実行)

MTP方式: [T T T] → [T T T] → [T T T] → ...(一度に複数を予測、並列検証)Gemma 4 MTPの実装詳細

- Tiny 4層ドラフター:わずか4層のドラフトモデルで、ターゲットモデルとKVキャッシュとアクティベーションを共有

- プラグアンドプレイ:モデルアーキテクチャの変更は不要、読み込むだけで使用可能

- 全4サイズをカバー:最小から最大までのGemma 4モデルすべて

速度比較

| シナリオ | 従来推論 | MTP推論 | 向上倍率 |

|---|---|---|---|

| ローカル MacBook Pro M4 | ~20 tps | ~60 tps | 3倍 |

| コンシューマーGPU (RTX 4090) | ~40 tps | ~100 tps | 2.5倍 |

| サーバー (A100) | ~80 tps | ~200 tps | 2.5倍 |

| エッジデバイス (スマホ) | ~8 tps | ~20 tps | 2.5倍 |

重要データ:20 tpsから60 tpsへの向上により、ローカルでのGemma 4体験は「かろうじて使える」から「スムーズな会話」に変化します。

品質劣化ゼロのメカニズム

MTPは単にトークンを「スキップ」するのではなく、投機的検証メカニズムを使用します:

- ドラフトモデルがN個の候補トークンを高速に生成

- ターゲットモデルがこれらN個のトークンを並列に検証

- 検証に合格したトークンは直接出力、不合格は再生成

- 全体の出力分布は標準的な自己回帰生成と同一

つまり出力品質は従来方式と完全に同一です。ただ速いだけ。

SGLangのDay 0サポート

SGLangフレームワークはGemma 4 MTPのサポートを即座に実装しました:

- 全4サイズのGemma 4が箱から出してすぐに動作

- 投機的デコーディングの統一インターフェース

- Cookbookチュートリアルを提供

開発者にとって:MTP推論ロジックを自分で実装する必要はありません。SGLangがすべての底层最適化を処理します。

以前のGemma 4記事との違い

これまでにChaoBroがカバーしたGemma 4記事:

gemma-4-26b-a4b-local-ai-inference-2026.md:パラメータ数とローカルデプロイに焦点gemma-4-good-challenge-200k-open-source-2026.md:Good Challengeベンチマークと200Kコンテキストに焦点gemma-4-react-native-on-device-2026.md:React Nativeモバイル統合に焦点

この記事はMTP推論加速技術に焦点を当てており、これは当サイトで以前にカバーされていないGemma 4シリーズの独立した技術ハイライトです。

アクション推奨

Gemma 4 MTPが最適なシナリオ:

- ハードウェア推論速度に制約されるローカルLLMデプロイメント

- 低レイテンシー応答が必要なリアルタイム会話アプリケーション

- 高いスループットが必要なバッチテキスト生成タスク

- 算力制約のあるエッジ/デバイスAI

始め方:

- 最新版SGLangをインストール

- Gemma 4モデルウェイトをダウンロード

- MTP推論モードを有効化(SGLangがデフォルトでサポート)

- 追加設定は不要。速度が自動的に2-3倍に向上

コスト:MTPは純粋なソフトウェア最適化で、ハードウェアコストの増加はゼロです。唯一の「コスト」はドラフトモデル用の少量の追加VRAM(約5-10%)です。