结论

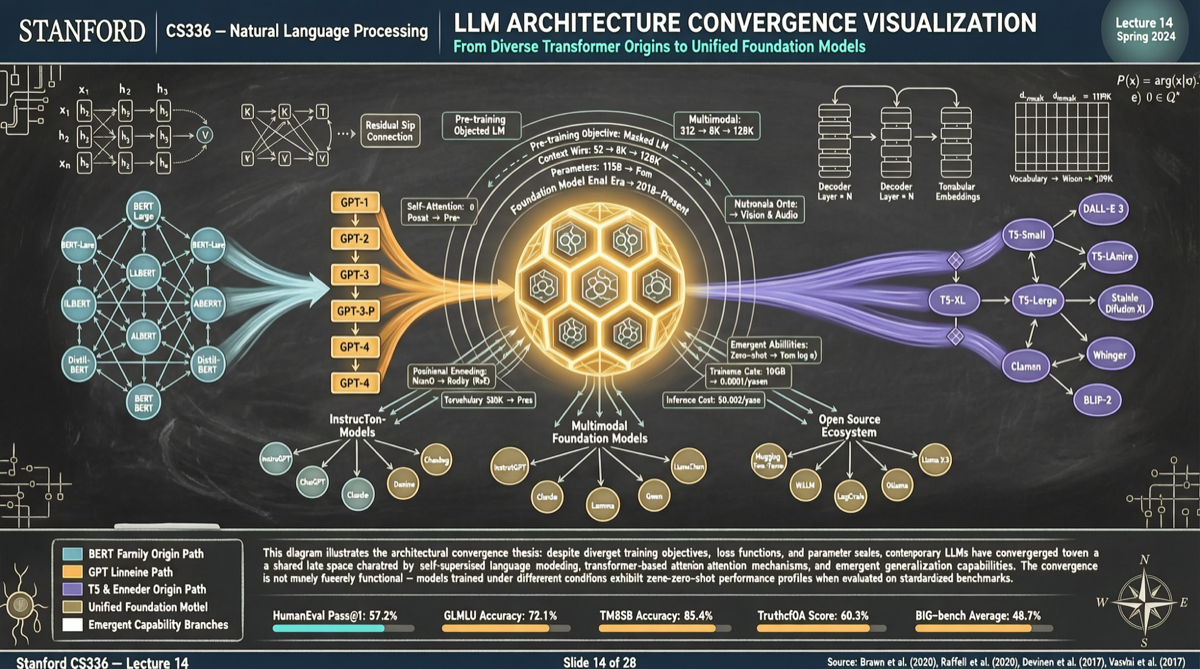

斯坦福 CS336(LLM 训练课程)讲师 Tatsu 在最近一堂课上做了一件极具信息密度的事:把过去 3 年所有主流 LLM 拆开,逐一比较它们的架构选择。

结论相当”爆”:90% 的架构选择已经收敛。 你随便挑一个开源大模型——不管是 Qwen、Llama、DeepSeek、还是 GLM——它们在这些维度上几乎一模一样。

讲师的原话三句总结了过去三年:

- 2024 年:大家都在 cosplay Llama 2

- 2025 年:主题是”怎么训得不崩”

- 2026 年:?

架构收敛体现在哪里

Tatsu 的课程拆解了以下几个核心维度,发现几乎所有主流模型都选择了相同的方案:

1. Transformer 变体

几乎清一色的 Decoder-only 架构。Encoder-decoder(T5 系)在通用 LLM 领域已经彻底边缘化。MoE(Mixture of Experts)从”可选项”变成了”大模型的默认配置”。

2. Attention 机制

从 Multi-Head Attention 到 Grouped Query Attention (GQA) 的迁移几乎是全行业同步完成的。GQA 在推理速度和显存占用上的优势让它没有悬念地胜出。

3. 归一化层

RMSNorm 取代 LayerNorm 成为标配,Pre-Norm 架构在深层训练中表现出的稳定性让它几乎无人质疑。

4. 激活函数

SwiGLU 一统天下。ReLU、GeLU 在新模型中基本绝迹。

5. 位置编码

RoPE(Rotary Position Embedding)在需要长上下文的场景中是事实标准。ALiBi 在特定场景(如流式推理)中仍有位置。

为什么收敛发生在 2024-2025

这不是巧合。架构收敛的背后是三个力量的叠加:

算力成本:训练一个 70B+ 模型的成本动辄数百万美元,试错空间极小。一旦 Llama 2 验证了一组架构选择在 7B-70B 范围内的有效性,后来者几乎没有动力去推翻重来。

开源透明:Llama 系列的开源让所有架构细节变得透明。后来的模型团队不需要”重新发现”——直接参考即可。

理论支撑:对缩放定律(Scaling Laws)的研究日趋成熟,社区对”哪些设计在大规模下有效”有了更清晰的认知。

2026 年的主题是什么

既然架构已经收敛,竞争转向了什么?

数据质量和训练稳定性。

讲师暗示 2026 年的核心竞争维度正在转移到:

- 数据配比优化:代码、数学、多语言、指令数据的最佳混合比例

- 训练过程稳定性:如何避免 loss spike、gradient explosion

- Post-training 方法:RLHF、DPO、ORPO 等对齐方法的效率和质量

这也解释了为什么 Qwen、DeepSeek 等国产模型能够在架构趋同的情况下,依然通过数据策略和训练工艺取得显著的性能差异。

对从业者的意义

如果你在做以下事情,这个信息很重要:

- 模型选型:不要再被”独特架构”的营销话术迷惑。真正的差异在数据和后训练

- 本地部署:既然架构趋同,一个模型的优化经验(如量化方案、推理框架)可以迁移到其他模型

- 研究切入:如果架构层面的创新空间越来越小,下一个突破更可能来自数据侧或训练方法论

国产模型在这个收敛格局中的位置

值得注意的一个细节:国产模型(Qwen、DeepSeek、GLM)不仅跟上了架构收敛的潮流,还在某些维度上做出了差异化:

- Qwen 在多语言能力和长上下文上的持续投入

- DeepSeek 在 MoE 架构和推理成本优化上的激进策略

- GLM 在中文理解和本土化知识上的优势

架构收敛不等于能力趋同——数据和训练工艺才是真正的分水岭。

一句话

LLM 架构的收敛不是创新的终结,而是竞争维度的转移。2026 年的模型战争,拼的是数据、是训练工艺、是对齐质量——而这些恰恰是国产模型正在发力的领域。