结论

阿里通义千问团队正式开源 Qwen-Scope,一套基于稀疏自编码器(Sparse Autoencoder, SAE)的模型内部表征分析与控制工具。该工具覆盖 Qwen3 和 Qwen3.5 系列共 7 个模型,核心价值在于:你可以在不微调模型的情况下,通过操纵内部特征来定向控制模型的输出行为。

这不是一个普通的开源玩具,而是把 Anthropic 等机构前沿的 mechanistic interpretability 研究成果,首次系统性地工程化并适配到中文大模型生态中。

核心能力拆解

| 能力维度 | 具体功能 | 实用价值 |

|---|---|---|

| 特征定位 | 定位模型内部特定神经元/特征 | 找出模型”为什么”产生某个输出 |

| 输出控制 | 推理阶段干预特征激活 | 无需训练即可调整模型行为倾向 |

| 分类器构建 | 少量种子数据训练特征分类器 | 低成本检测特定概念或意图 |

| 样本合成 | 基于特征激活生成长尾样本 | 扩充罕见场景的训练数据 |

| 异常检测 | 定位导致异常输出的特征 | 快速诊断模型的”坏习惯” |

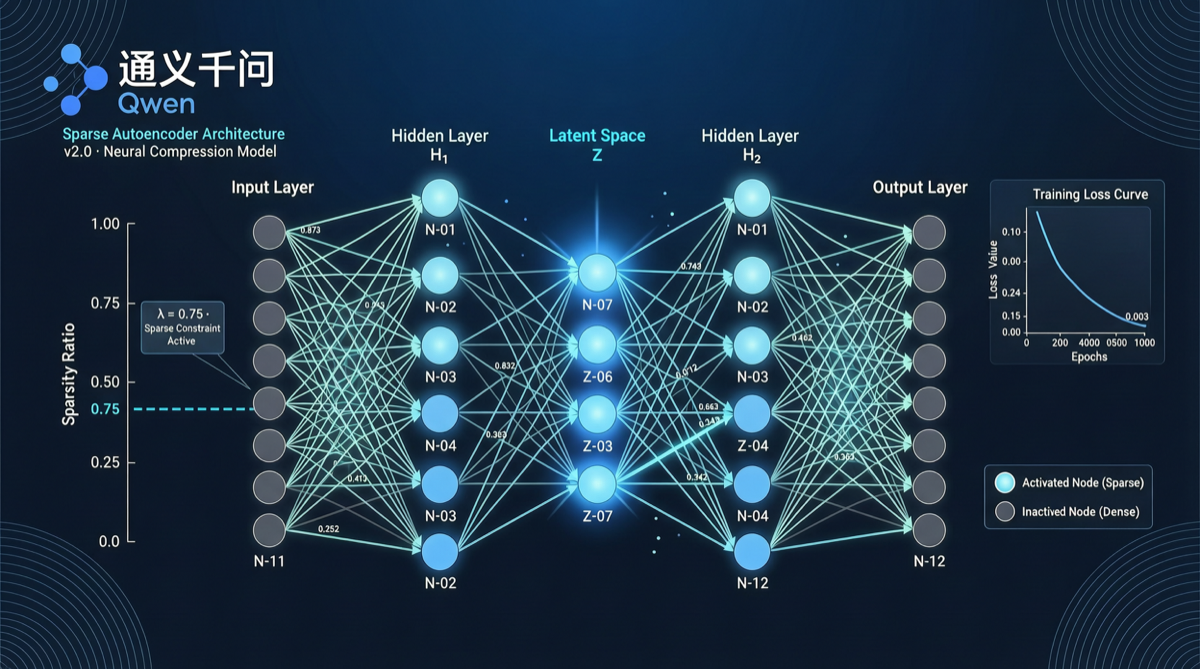

技术原理简述

Qwen-Scope 的工作流程分三步:

- 训练 SAE:在模型隐藏层(通常是 MLP 或 Attention 输出)上训练稀疏自编码器,将高维稠密激活分解为大量稀疏的”特征”

- 特征标注:通过自动或半自动方式,为每个特征标注语义含义(如”中文特征”、“代码特征”、“安全拒绝特征”等)

- 特征干预:在推理时增强或抑制特定特征,实现对输出的精准控制

这种方法的精妙之处在于:你不需要重新训练模型,只需要在推理时”拧几个旋钮”。

覆盖模型

Qwen-Scope 支持以下 7 个模型:

- Qwen3-0.6B / 1.7B / 4B / 8B

- Qwen3.5-4B / 8B / 14B

覆盖从小型到中型的全部主流规格,适配了不同场景的部署需求。

实际应用场景

场景一:消除语言混用

当模型在中文回答中不自然地夹杂英文时,可以定位”英文特征”并在推理时适度抑制,输出会更纯净的中文。

场景二:减少重复生成

模型出现重复输出时,通过定位重复模式对应的特征进行抑制,可以显著改善生成质量。

场景三:安全对齐增强

无需重新做 RLHF,只需增强”安全拒绝特征”的激活强度,就能让模型对有害请求更敏感。

场景四:特定领域知识注入

定位目标领域的关键特征,推理时增强其激活,相当于给模型”临时补课”。

格局判断

Qwen-Scope 的开源释放了几个重要信号:

- 可解释性工具从研究走向工程:SAE 不再是论文中的概念,而是可以下载、安装、使用的工具包

- 中文模型可解释性生态启动:此前 SAE 工具主要面向英文模型(Claude、GPT),Qwen-Scope 填补了中文大模型在这一领域的空白

- 微调成本可以大幅下降:特征控制作为微调的替代方案,在某些场景下可以节省大量算力和时间

与 Anthropic 的 SAE 研究相比,Qwen-Scope 的独特优势在于针对中文语言特性做了优化,包括中文分词特征、中英混用检测等,这是英文模型工具无法覆盖的。

行动建议

- 模型开发者:用 Qwen-Scope 诊断模型的特定行为问题,比盲目调参更高效

- 应用方:遇到模型输出质量问题时,先尝试特征控制,可能不需要重新微调

- 研究者:基于 Qwen-Scope 构建中文大模型可解释性的新 benchmark

上手路径

# 克隆仓库

git clone https://github.com/QwenLM/Qwen-Scope.git

cd Qwen-Scope

# 安装依赖

pip install -r requirements.txt

# 加载预训练 SAE(以 Qwen3-8B 为例)

from qwen_scope import SAELoader

sae = SAELoader.from_pretrained("Qwen3-8B-MLP-SAE")

# 推理时特征干预

controlled_output = sae.generate(

prompt="你的问题",

feature_modulations={"chinese_purity": 1.5, "english_mixed": -0.8}

)SAE 的下载权重已发布在 Hugging Face 和 ModelScope,支持直接加载使用。

数据来源

- GitHub: github.com/QwenLM/Qwen-Scope

- 通义千问官方公告