核心数据

| 维度 | FlashKDA | FLA Baseline | 加速比 |

|---|---|---|---|

| 前向推理(H20) | 优化 CUTLASS 核 | flash-linear-attention | 1.72×–2.22× |

| 变长批处理 | 原生支持 | 需手动处理 | ✅ |

| 后端兼容性 | 直接替换 | — | 即插即用 |

| 底层框架 | CUTLASS | Triton | NVIDIA 官方优化栈 |

技术要点

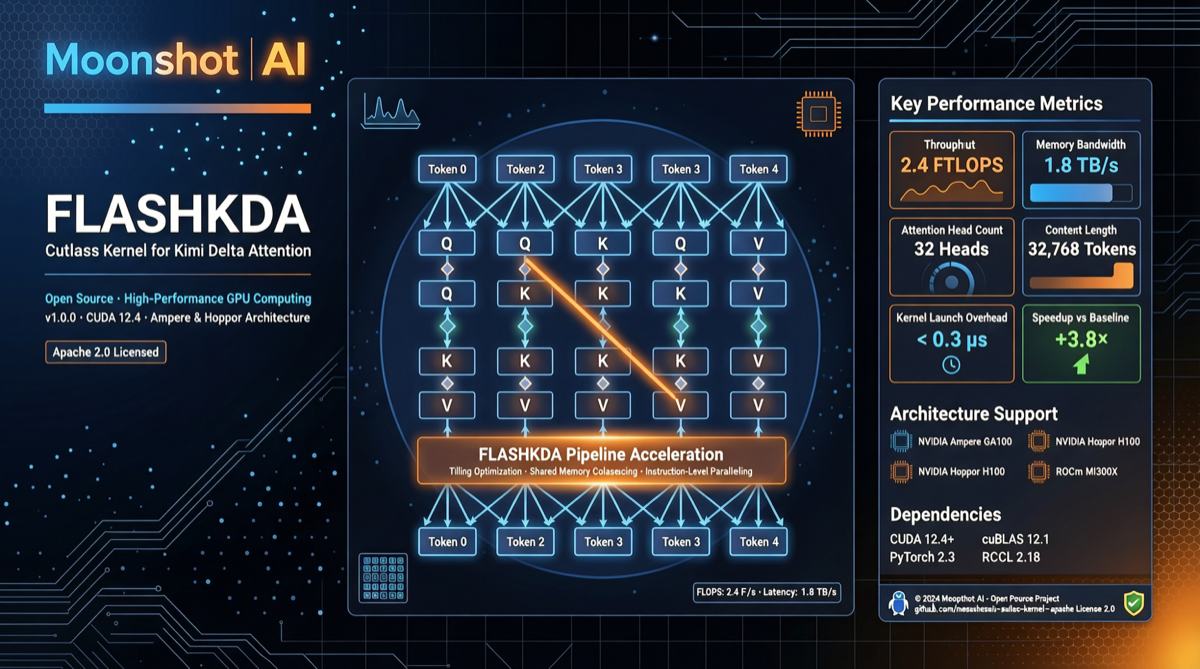

Delta Attention 是什么? Kimi K2 系列模型采用的 Delta Attention 架构与传统 Transformer 自注意力不同,它通过增量计算减少冗余操作,特别适合长上下文场景。Moonshot 之前已发布了基于 Triton 的参考实现,但性能仍有优化空间。

为什么选 CUTLASS? CUTLASS 是 NVIDIA 官方的 CUDA 模板库,FlashAttention-3 同样基于此构建。相比 Triton,CUTLASS 能更精细地控制 GPU 内存层次和线程调度,在 H20 等国产算力卡上尤为明显。

变长批处理的价值 实际推理场景中,不同请求的序列长度差异巨大。FlashKDA 原生支持变长批处理(Variable-Length Batching),避免了传统方案中的 padding 浪费,直接提升吞吐。

与 Qwen FlashQLA 的对比

| FlashKDA (Moonshot) | FlashQLA (Qwen) | |

|---|---|---|

| 目标架构 | Delta Attention | GDN (Gated Delta Network) |

| 底层框架 | CUTLASS | TileLang |

| H20 加速 | 1.72×–2.22× | 2–3× |

| 开源时间 | 2026-04-21 | 2026-04-29 |

| 适用模型 | Kimi K2 系列 | Qwen3-Next/3.5/3.6 |

两者都是国产团队在注意力核优化方向的独立探索——Moonshot 走 CUTLASS 路线,Qwen 走 TileLang 路线。对于想在国产模型上做推理优化的团队来说,这两个项目提供了两种不同的技术路径参考。

实际意义

对 Kimi 用户:如果你在用 Kimi K2 系列模型做本地部署或微调,FlashKDA 可以直接替换现有 attention 后端,无需修改模型代码。

对推理优化开发者:这是一个高质量的 CUTLASS attention 核参考实现,变量长度批处理的代码结构值得学习。

对算力采购方:在 H20 上的实测数据说明,软件层面的优化可以让现有硬件释放更多性能,不一定要等下一代芯片。

上手

git clone https://github.com/moonshot-ai/FlashKDA.git

cd FlashKDA

pip install -e .安装后可作为 flash-linear-attention 的后端直接替换:

from flash_linear_attention import set_backend

from flashkda import KDACudaBackend

set_backend(KDACudaBackend())格局判断

国产大模型团队正在从”模型架构创新”走向”底层算子优化”的深水区。FlashKDA 和 FlashQLA 的相继开源标志着两条技术路线的竞争已经开始。未来谁能在推理成本和延迟上取得优势,谁就能在端侧/边缘 Agent 市场占据先机。