AI 不能再假装自己是真人了。至少在中国市场,从 7 月 15 日开始,这条红线会正式落地。

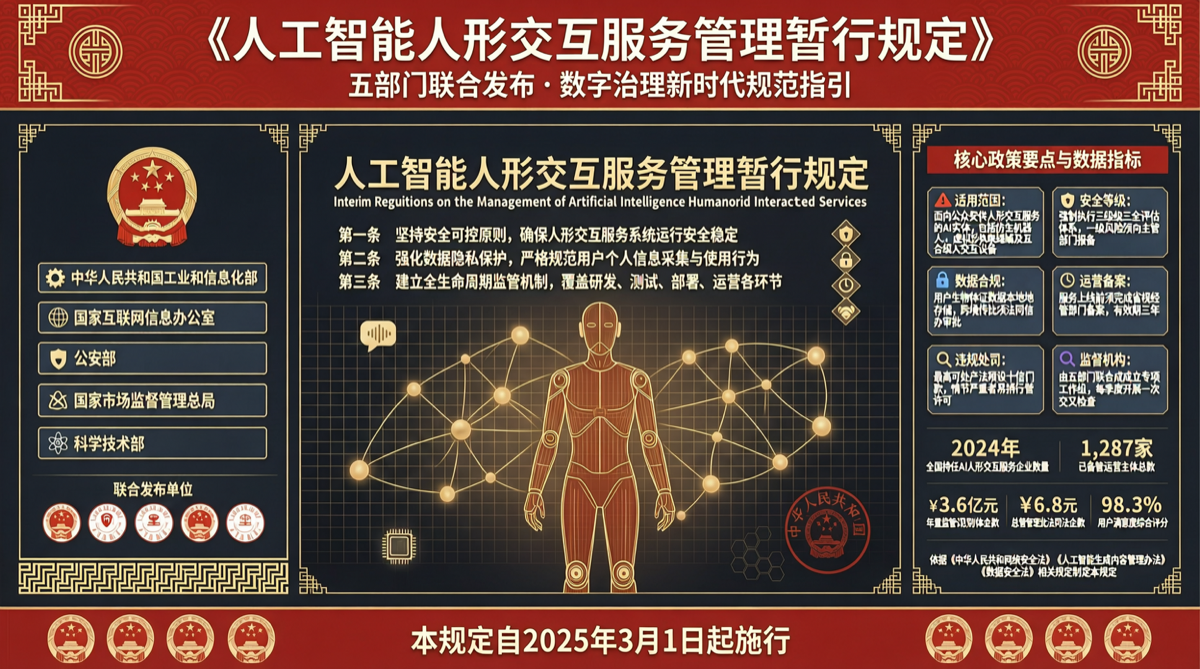

4 月 10 日,国家网信办、国家发改委、工信部、公安部、市场监管总局五部门联合公布了《人工智能拟人化互动服务管理暂行办法》。这是全球范围内少有的专门针对 AI 拟人化行为的专项法规。

核心规定

办法的核心要求可以概括为三条:

第一,身份标识。 提供 AI 服务的平台必须以显著方式告知用户正在与 AI 交互,不得隐瞒或模糊 AI 身份。这意味着那些刻意模仿真人语气的聊天机器人,必须在对话开始前就亮明身份。

第二,行为边界。 AI 服务不得以拟人化方式实施欺诈、误导或其他可能损害用户权益的行为。"像人一样说话"可以,但"假装是人来骗人"不行。

第三,问责机制。 服务提供者需要对 AI 的拟人化互动行为承担管理责任。出了事,不能甩锅给"是 AI 自己说的"。

为什么是现在

这个时间点不意外。2026 年上半年,AI 聊天机器人、虚拟伴侣、AI 数字人等服务在国内快速普及。一些产品的交互设计已经模糊了"工具"和"伴侣"的边界——用户分不清对面是真人还是 AI 的案例,不是没有。

从监管角度看,拟人化 AI 带来的风险不仅是技术层面的,更是社会和心理层面的。当用户对一个 AI 产生情感依赖,而这个 AI 可以不受限制地模拟人类情感——这已经不是用户体验问题了。

对行业的影响

短期来看,影响最大的是以下几类服务:

- AI 虚拟伴侣/情感陪伴类产品。 这类产品的核心卖点就是"拟人化互动",新规要求它们必须在身份标识上做足功课。

- AI 客服系统。 很多企业的 AI 客服已经设计得和真人客服几乎无法区分,新规施行后需要增加明确的 AI 标识。

- 数字人/虚拟主播。 虽然虚拟主播通常不涉及"隐瞒身份",但在互动环节中如果有误导用户的可能,也需要调整。

长期来看,这条法规可能会推动行业在"拟人化"和"透明度"之间找到新的平衡点——不是不让 AI 拟人,而是让拟人化在透明的前提下进行。

国际对比

欧盟的 AI 法案也有关于透明度义务的要求,但更侧重风险分级。中国这个办法的特别之处在于它是专项法规,直接聚焦"拟人化互动"这个具体行为。全球范围内,这种针对性的 AI 监管法规还不多见。

主要来源:

- 国家网信办等五部门联合公告

- 搜狐科技解读