ИИ больше не может притворяться человеком. По крайней мере, на китайском рынке — с 15 июля эта красная линия вступает в силу официально.

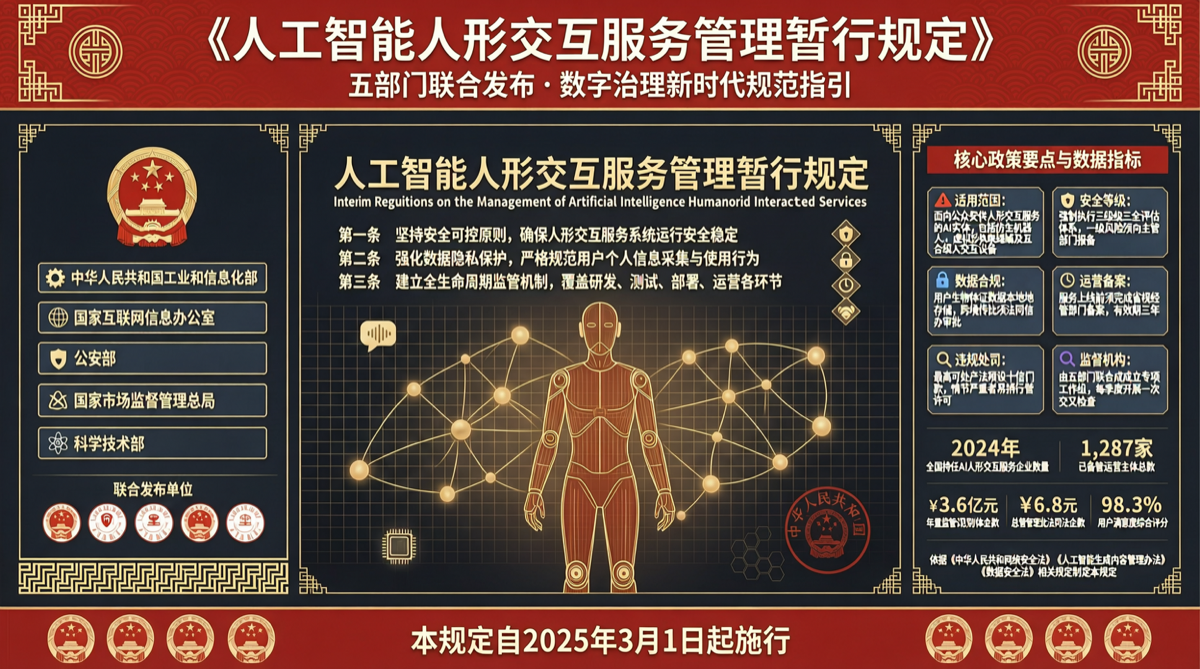

10 апреля пять ведомств — Управление киберпространства Китая, Национальная комиссия по развитию и реформам, Министерство промышленности и информатизации, Министерство общественной безопасности и Государственное управление по регулированию рынка — совместно опубликовали «Временные меры по управлению сервисами человекоподобного взаимодействия ИИ». Это одно из немногих в мире специализированных нормативных актов, конкретно направленных на человекоподобное поведение ИИ.

Основные требования

Регулирование сводится к трём основным требованиям:

Во-первых, маркировка идентичности. Платформы, предоставляющие ИИ-сервисы, должны заметным образом информировать пользователей о том, что они взаимодействуют с ИИ, и не должны скрывать или размывать идентичность ИИ. Чат-боты, намеренно имитирующие человеческий тон, должны раскрывать свою идентичность до начала разговора.

Во-вторых, границы поведения. ИИ-сервисы не должны использовать человекоподобное взаимодействие для мошенничества, обмана или иного ущерба интересам пользователей. «Говорить как человек» можно, но «притворяться человеком, чтобы обмануть» — нельзя.

В-третьих, ответственность. Поставщики услуг несут управленческую ответственность за человекоподобное взаимодействие своего ИИ. Когда что-то идёт не так, «ИИ сказал это сам по себе» больше не является приемлемым оправданием.

Почему сейчас

Этот момент не удивителен. В первом полугодии 2026 года ИИ-чат-боты, виртуальные компаньоны и сервисы ИИ-цифровых людей быстро распространились в Китае. Некоторые продукты размыли границу между «инструментом» и «компаньоном» — случаи, когда пользователи не могли определить, общаются ли они с человеком или ИИ, не редкость.

С точки зрения регулирования, риски человекоподобного ИИ носят не только технический, но и социальный и психологический характер. Когда пользователь развивает эмоциональную зависимость от ИИ, который может без ограничений имитировать человеческие эмоции — это уже не проблема пользовательского опыта.

Влияние на индустрию

В краткосрочной перспективе наибольшее влияние окажет на:

- ИИ-виртуальные компаньоны и продукты эмоциональной поддержки. Их основное преимущество — «человекоподобное взаимодействие», и новые правила требуют от них правильной маркировки идентичности.

- Системы ИИ-обслуживания клиентов. Многие корпоративные ИИ-чат-боты уже практически неотличимы от человеческих агентов и потребуют чёткой идентификации ИИ.

- Цифровые люди и виртуальные ведущие. Хотя виртуальные ведущие обычно не «скрывают идентичность», интерактивные сегменты с потенциалом обмана пользователей потребуют корректировок.

В долгосрочной перспективе это регулирование может подтолкнуть индустрию к новому балансу между «человекоподобием» и «прозрачностью» — не запрещая ИИ быть похожим на человека, но требуя, чтобы человекоподобие происходило прозрачно.

Основные источники:

- Совместное объявление пяти ведомств

- Анализ Sohu Tech