Основной вывод

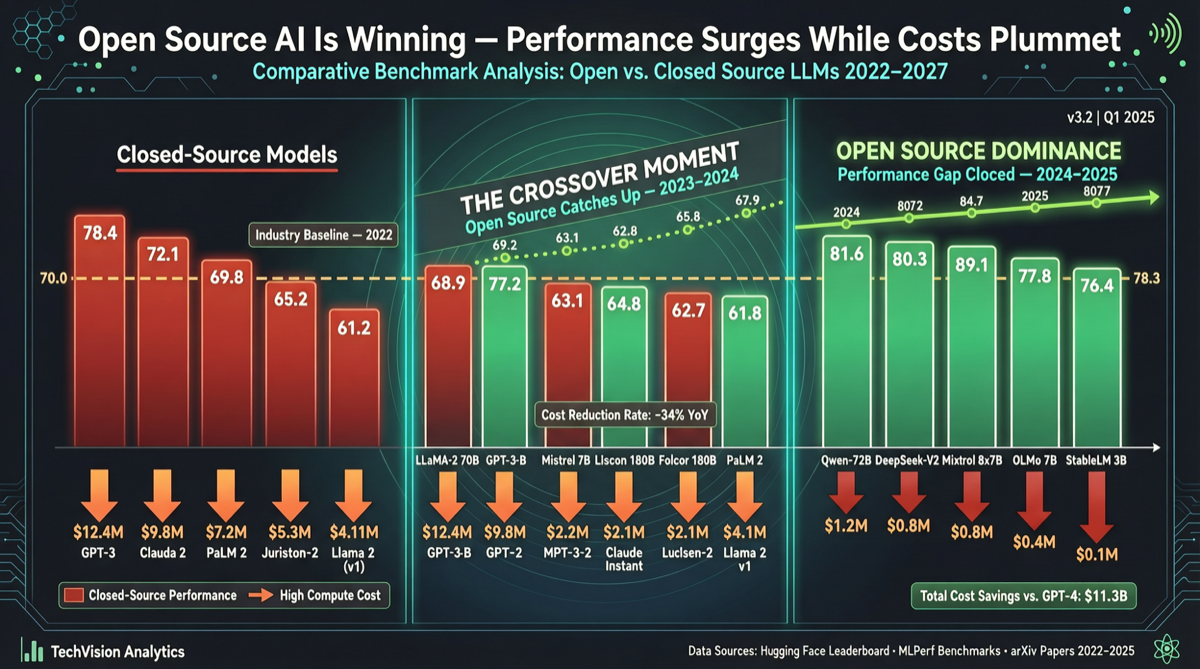

В мае 2026 года разрыв в производительности между моделями ИИ с открытым исходным кодом и закрытыми API исчезает. Последний рейтинг OpenRouter показывает, что Kimi K2.6 уже лидирует в лагере открытого исходного кода по комплексным возможностям, за ней следует GLM 5.1, а DeepSeek V4 Preview догоняет. Для разработчиков это посылает ясный сигнал: если вы занимаетесь пакетной обработкой, асинхронным выводом или задачами, чувствительными к стоимости, модели с открытым исходным кодом уже могут заменить большинство вызовов закрытых API.

Сравнение производительности

Текущее состояние рейтинга OpenRouter

| Модель | Тип | Общий ранг | Сильные стороны | Слабость |

|---|---|---|---|---|

| GPT-5.5 | Закрытая | #1 | Следование инструкциям, сложные рассуждения | Высокая цена API |

| Claude 4 Opus | Закрытая | #2 | Длинный контекст, код | Высокая цена API |

| Kimi K2.6 | Открытая | #3-4 | Понимание китайского, многораундовый диалог | Скорость вывода |

| GLM 5.1 | Открытая | #4-5 | Вызов инструментов, агент | Скорость вывода |

| DeepSeek V4 Preview | Открытая | #5-6 | Математика, код | Ещё обучается |

| Gemini 2.5 Pro | Закрытая | #2-3 | Мультимодальность | Среднее китайское качество |

Ключевой сигнал: Kimi K2.6 и GLM 5.1 «невероятно близки к закрытому ИИ по производительности» — консенсус среди множества разработчиков.

Скорость: единственный систематический недостаток моделей с открытым кодом

| Модель | Средняя задержка первого токена | Пропускная способность (tokens/s) | Подходящие сценарии |

|---|---|---|---|

| GPT-5.5 | ~500мс | 120-150 | Интерактивное взаимодействие в реальном времени |

| Claude 4 | ~600мс | 100-130 | Интерактивное взаимодействие в реальном времени |

| Kimi K2.6 (API) | ~800мс | 80-100 | Почти реальное время |

| GLM 5.1 (API) | ~900мс | 70-90 | Почти реальное время |

| Локальное развёртывание (A100) | ~300мс | 50-80 | Пакетная обработка |

Разрыв в скорости сокращается: облачные API-версии Kimi/GLM имеют задержку в диапазоне 800-900 мс, тогда как локальное развёртывание на A100 можно сжать до 300 мс. Для асинхронных задач (пакетная обработка, маркировка данных, генерация контента) скорость вообще не является проблемой.

Сравнение затрат: настоящий драйвер

На основе обработки 1 миллиона токенов в месяц:

| Решение | Ежемесячная стоимость | Стоимость за миллион токенов | Примечания |

|---|---|---|---|

| GPT-5.5 API | $15-25 | $15-25 | Смешанные входные и выходные |

| Claude 4 API | $20-30 | $20-30 | Включая накладные расходы системного промпта |

| Kimi K2.6 API | $2-5 | $2-5 | Ценовое преимущество китайского API |

| GLM 5.1 API | $2-4 | $2-4 | Чрезвычайно экономично |

| Локальное развёртывание (электричество) | $0.5-1 | ~$0.5 | Стоимость оборудования отдельно |

Стоимость закрытых API в 5-15 раз выше, чем решений с открытым кодом. Когда разрыв в производительности сужается до 10%, стоимость становится решающим фактором.

Какие сценарии готовы к миграции?

| Сценарий | Возможность миграции | Рекомендуемое решение | Примечания |

|---|---|---|---|

| Пакетная маркировка данных | ✅ Полностью возможна | Kimi K2.6 локальное развёртывание | Нечувствительно к скорости |

| Генерация контента | ✅ Полностью возможна | GLM 5.1 API | Хорошее китайское качество |

| Диалог службы поддержки | ⚠️ Частично возможен | Kimi K2.6 API | Задержку нужно оценить |

| Перевод в реальном времени | ⚠️ Частично возможен | Специализированные маленькие модели | Общие модели имеют высокую задержку |

| Генерация кода | ✅ Возможна | Kimi K2.6 + DeepSeek | Открытый код хорошо работает в коде |

| Сложные цепочки рассуждений | ❌ Пока не рекомендуется | GPT-5.5 / Claude 4 | Закрытые модели всё ещё имеют преимущество |

Стратегия миграции

Постепенная миграция (рекомендуется)

Фаза первая: миграция некритичных задач

→ Очистка данных, пакетное суммаризирование, черновики контента

→ Используйте модели с открытым кодом, оставьте закрытые для выборочной проверки качества

Фаза вторая: серый релиз для основных задач

→ Служба поддержки, перевод, генерация кода

→ A/B тестирование качества вывода открытого кода против закрытого

Фаза третья: откат по требованию

→ Оставьте закрытый API в качестве резервного

→ Автоматическое переключение, когда модель открытого кода не удовлетворяет требованиям качестваПример гибридной архитектуры

def smart_route(prompt, task_type):

if task_type in ["batch_label", "content_draft"]:

return kimi_client.generate(prompt) # Низкая стоимость

elif task_type in ["complex_reasoning", "safety_critical"]:

return gpt_client.generate(prompt) # Высокое качество

else:

return glm_client.generate(prompt) # СбалансированныйОценка отраслевой картины

Индустрия ИИ переживает повторение «эры облачных вычислений»:

- Ранний этап: Закрытый API — единственный выбор, дорогой, но лучшая производительность

- Сейчас: Модели с открытым кодом догоняют по производительности, значительный ценовой разрыв

- Будущее: Закрытый API отступает в «сценарии высшего уровня» (интерактивное взаимодействие в реальном времени, сложные рассуждения, мультимодальность), модели с открытым кодом доминируют в «сценариях больших объёмов»

Это не игра с нулевой суммой — провайдеры API будут снижать цены, модели с открытым кодом будут увеличивать скорость, и в конечном итоге пользователи получат выгоду.

План действий

- Сегодня: проверьте счёт API, определите сценарии использования, составляющие 80% затрат

- На этой неделе: замените 20% некритичных вызовов на API Kimi K2.6 или GLM 5.1

- В этом месяце: если у вас есть ресурсы GPU, разверните локальный сервис вывода для дальнейшего снижения затрат

- Постоянно: следите за рейтингом OpenRouter, отслеживайте изменения производительности моделей с открытым кодом

Когда разрыв в производительности моделей с открытым кодом сужается до «незаметного», а разрыв в затратах остаётся «видимым невооружённым глазом», миграция больше не является техническим вопросом, а становится бизнес-решением.