2026 年 4 月底,社区开发者对比 OpenAI 和 Anthropic 最新发布的官方提示词指南后发现:GPT-5.5 和 Claude Opus 4.7 对 prompt 的要求几乎走向了两个极端。

GPT-5.5:别教我怎么做,告诉我要什么

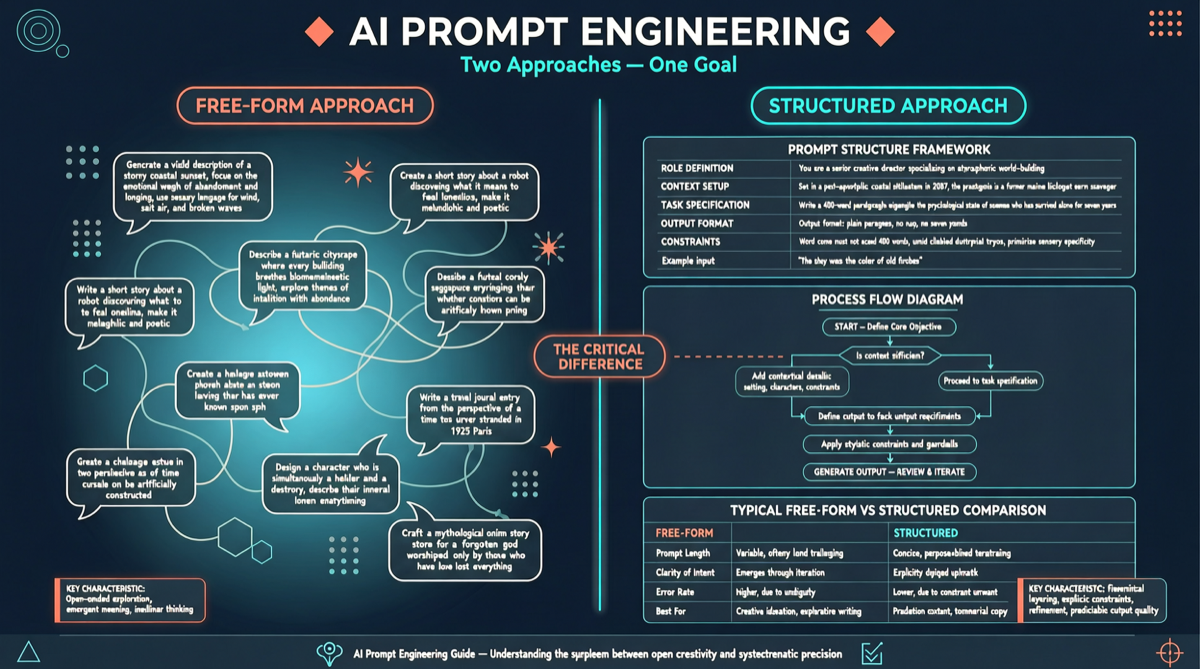

OpenAI 的 GPT-5.5 提示词指南明确建议:

- 直接描述你想要的最终结果,不需要解释实现路径

- 减少步骤化指令——以前那种”第一步做什么、第二步做什么”的详细 prompt 现在反而会限制模型的发挥,让回答变得死板

- 给模型自由度——让它自己决定用什么样的推理路径和工具组合来达成目标

这种设计哲学的前提是:GPT-5.5 的推理能力已经足够强,不需要人类手把手教它”怎么做”。给它一个目标,它会自己找到最优路径。

Claude Opus 4.7:请把每一步说清楚

Anthropic 的 Claude Opus 4.7 提示词指南则采取了相反的策略:

- 结构化指令优于自由描述——将任务分解为明确的步骤、规则和约束条件

- 详细定义输出格式——使用示例和模板来规范输出结构

- 明确限制范围——告诉模型不应该做什么,和应该做什么一样重要

这种设计哲学反映了一个不同的假设:即使是最强的 Claude 模型,在复杂任务中也需要清晰的边界和结构化的引导,才能稳定输出高质量结果。

为什么会出现这种分歧

两种提示词哲学的差异,本质上反映了两家对模型能力边界和可靠性的不同判断:

- OpenAI 认为 GPT-5.5 已经跨过了”需要详细指令才能做好复杂任务”的门槛,更强的推理能力意味着更少的 prompt 工程

- Anthropic 则认为即使是最强的模型,在面向生产的高风险场景中,结构化的提示词仍然是保证输出一致性和安全性的关键

实践影响

对于日常使用来说,这意味着:

- 在 GPT-5.5 上,简洁的 prompt 可能效果更好——用一两句话描述目标,然后让模型自由发挥

- 在 Claude Opus 4.7 上,结构化的 prompt 仍然值得投入——详细的步骤、格式要求和约束条件会带来更稳定的输出

对于 Agent 开发者来说,这意味着为不同模型构建 prompt 模板时需要采用不同的策略。一个在 GPT-5.5 上运行良好的 prompt 直接迁移到 Claude 上可能效果不佳,反之亦然。