2026年5月初旬、Hugging Face上にQwenSeek-2Bという新しいモデルが登場した。これは大手ラボではなく、コミュニティ開発者による独立プロジェクトだ。Qwen3.5-2Bを生徒モデル、DeepSeek-V4の

何があったのか

| 次元 | 詳細 |

|---|---|

| 生徒モデル | Qwen3.5-2B(アリババQwenチームの2Bパラメータオープンソースモデル) |

| 教師シグナル | DeepSeek-V4が出力する |

| ライセンス | Apache 2.0(商用利用可能) |

| リリースプラットフォーム | Hugging Face |

| 動作要件 | RTX 3060 / 4060 1枚で推論可能 |

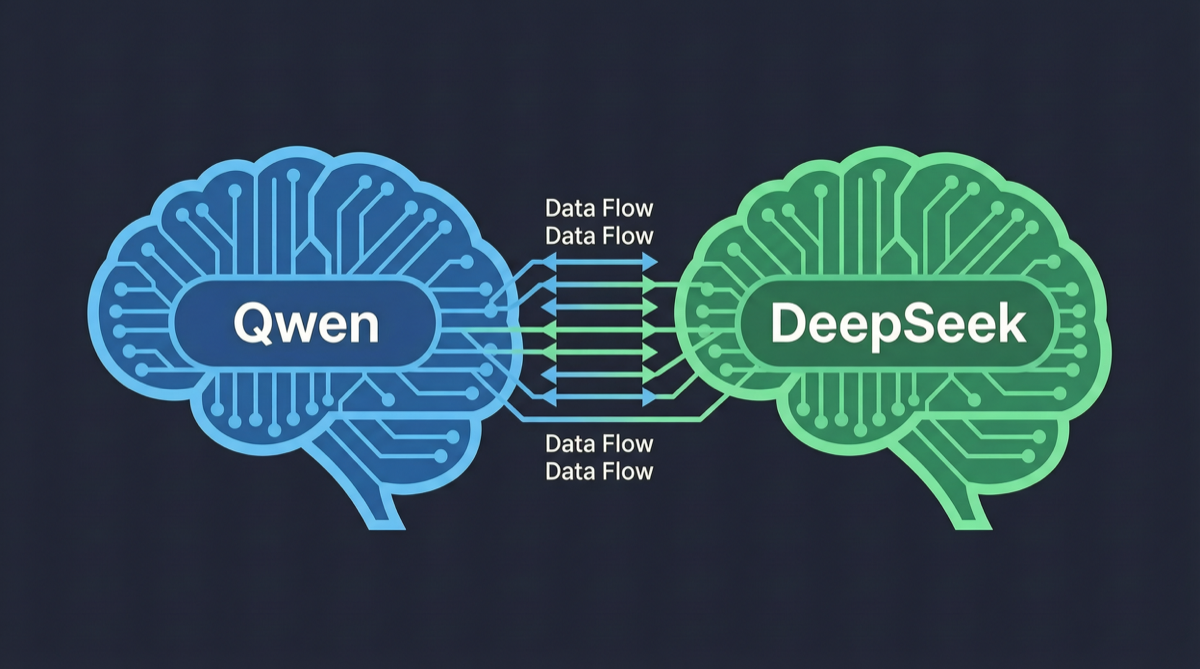

コアアイデアはシンプルだ:小型モデルに大型モデルの推論方法を学ばせる。単に出力結果を模倣するのではなく、「どう考えるか」を学ぶ——DeepSeek-V4が回答前に生成する

なぜ注目すべきか

第一、クロスモデル蒸留の新しいパス。 これまでの蒸留作業はほとんど同一家族内で行われていた(大型Qwenから小型Qwenへ)。QwenSeek-2Bはこの制限を打破した。DeepSeekの推論能力を使ってQwenアーキテクチャを強化し、思考連鎖の知識がアーキテクチャを越えて移行できることを証明した。

第二、2Bパラメータの閾値は非常に実用的。 2Bモデルは4-6GBのVRAMだけで動作する。つまり:

- コンシューマーノートPC用GPU(RTX 3060/4060)

- エッジデバイス(Jetson Orin Nano)

- 低コストクラウドサーバー(月額5-10ドルのVPS)

で実行できる。

第三、Apache 2.0ライセンス。 商用制限なし。企業が製品に直接組み込んでも、ライセンスコンプライアンスを心配する必要はない。

市場分析

この実験は一つの形成中の傾向を明らかにしている:思考連鎖(CoT)自体が蒸留可能な知識資産になりつつある。

DeepSeek-V4のようなオープンソースモデルが

- Claudeの推論パターンをLlamaに蒸留

- GPT-4oのマルチモーダル推論をQwen-VLに蒸留

- 複数の教師の思考連鎖を統合して1人の生徒に蒸留

これは「小型モデル、大能力」の傾向を加速させるかもしれない——2B-7Bパラメータのモデルが、より大きなモデルの推論プロセスを吸収することで、特定のタスクにおいてより大きな競合に迫る。

アドバイス

| あなたのシナリオ | アドバイス |

|---|---|

| エッジデバイスに推論エージェントをデプロイする必要がある | QwenSeek-2Bを試す、VRAMの閾値が低い |

| すでにQwen3.5-2Bをデプロイ済み | 蒸留前後の出力品質の差異を比較 |

| モデルファインチューニング実験を行っている | 蒸留フローを参考に、独自の教師シグナルで同様の実験を行う |

| 商用製品に統合 | Apache 2.0で直接使用可能だが、まずは重要でないパスで検証を |

注意:これはコミュニティの実験的プロジェクトであり、公式リリースではない。安定性、セキュリティ、長期的なメンテナンスは保証されていない。本番環境で使用する前に必ず自行評価すること。