核心結論

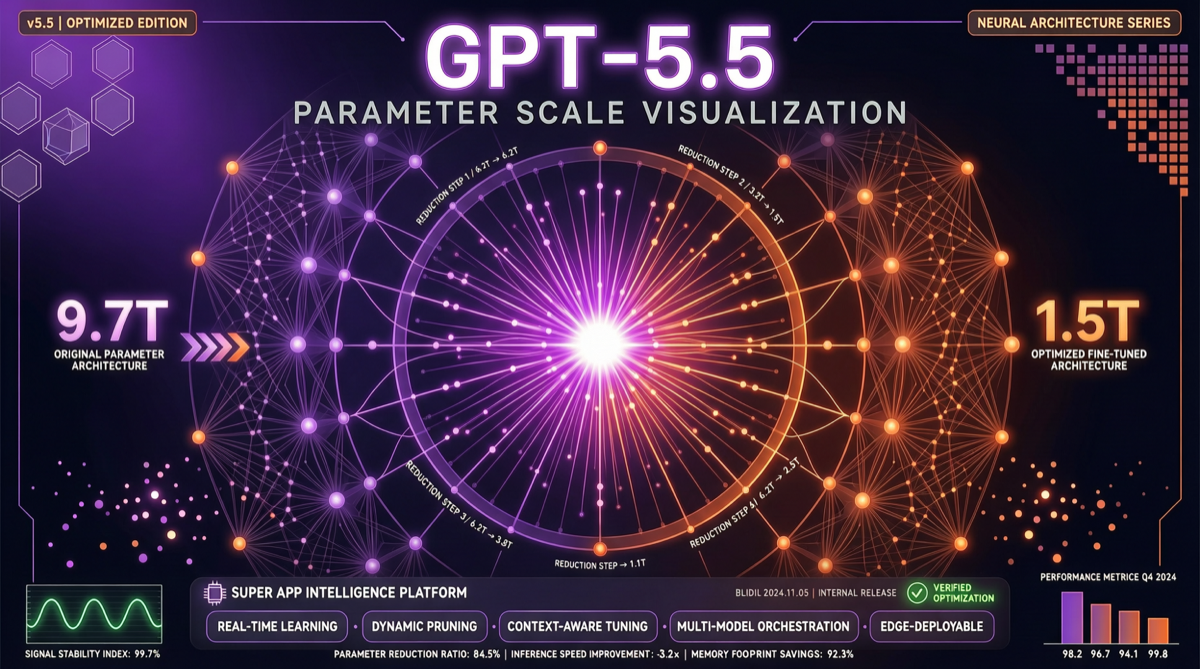

GPT-5.5のパラメータ数が再計算されました——広く出回っていた9.7兆ではなく、1.5兆です。6.5倍の差。これはOpenAIが誰もが予想していたよりもはるかに小さいモデルで、同等かそれ以上の性能を達成したことを意味します。これは単なる技術的勝利ではなく、業界全体の「パラメータ競争」ナラティブを覆すものです。

修正が意味すること

数値比較

| 推定バージョン | パラメータ数 | ソース |

|---|---|---|

| 初期推定 | 9.7T | 初期リーク/推測 |

| 再修正 | 1.5T | 研究者の再計算 |

| 差 | 6.5倍 | — |

6.5倍のパラメータ差で同等かそれ以上の性能。これは以下の重要な事実を指し示しています:

1. 学習効率の大幅な飛躍

OpenAIはGPT-5.5で質的な学習効率の向上を達成しました:

- データ量は質より重要:より精選された学習データがパラメータ規模の不足を補える

- アーキテクチャ最適化:注意メカニズム、位置エンコーディング、またはMoE戦略に大幅な改善があった可能性

- RLHF/後学習効率:GPT-5.2 → 5.3 → 5.4 → 5.5のイテレーション速度は、後学習パイプラインが高度に成熟していることを示す

2. 「規模の法則」から「効率の法則」へ

業界は長年「scale is all you need」を信奉してきました——パラメータ越多、データ越多、算力越多、モデル越好。GPT-5.5の出現は以下を示唆しています:

学習効率 > パラメータ規模

これは業界に深遠な影響を与えます:

- 中小チームは兆パラメータを追求しなくても良いモデルを作れる

- 算力コストはもはや越えられない障壁ではない

- 「小さいモデル、大きな知恵」が2026年下半年の主旋律になる可能性

GPT-5.5:モデル更新にとどまらない

「スーパーアプリ」戦略の一部

ロイター通信の報道はGPT-5.5のより宏大な位置づけを明らかにしました——ChatGPTのプラットフォーム化转型の核心コンポーネント:

- 生産性機能:ドキュメント処理、メール、スケジュール管理

- 検索統合:リアルタイム検索機能内蔵

- コンテンツ作成:マルチモーダル生成能力

- 自動化:Codex agentのオーケストレーション

これは「より良いチャットボット」ではなく、OpenAIが統一されたAIエントリポイントを構築しているのです。

バージョンイテレーションリズムの圧縮

2025年12月から2026年4月まで、OpenAIのリリースペースは息苦しいほどです:

2025.12 → GPT-5.2

2026.02 → GPT-5.3 (Codex)

2026.03 → GPT-5.4

2026.05 → GPT-5.5ほぼ毎月1回の重大更新。Anthropicも同様のペースでイテレーション(Opus 4.5 → 4.6 → 4.7)。AI業界の「更新サイクル」が年から月に短縮されました。

GPT-5.6との関係

さらに興味深いのは、Codexの内部ログですでにGPT-5.6の痕跡が発見されていることです。GPT-5.5が「GPT-4.5以来初めて基礎から再学習されたベースモデル」なら、GPT-5.6は以下を意味する可能性があります:

- さらに極端なパラメータ効率の最適化

- 全く新しい学習方法やデータ戦略

- 「パラメータは少なくてもっと強く」というルートの継続

Sam AltmanはすでにGPT-5.6を予告しています。現在のペースなら、2026年6-7月就能看到。

市場分析

競合他社への影響

- Claude/Anthropic:Opus 4.7は「パラメータ効率」という新しい競争次元に直面。Anthropicの「小さく賢く」というルートが修正によって検証された

- DeepSeek/オープンソース陣営:1.5Tのパラメータ数はオープンモデルの追撃ハードルがさらに下がることを意味

- Google/Gemini:Gemini 3.1 Proのリリースペースが圧迫され、効率次元での回应が必要

業界への影響

- 算力需要予想の下方修正:1.5Tで9.7Tの効果が得られるなら、学習コストは大幅に下がる

- オープンソースコミュニティの恩恵:小さいパラメータ規模は再現と微調整が容易

- 「規模競争」ナラティブの終焉:業界の関心は「谁的モデル更大」から「谁的学習更高效」へ移行

アクション推奨

- 算力購入を計画している場合:ニーズを再評価——1.5Tレベルのモデルで十分かもしれない

- モデル選定を行っている場合:パラメータ規模だけでなく、学習効率と実際のタスク表現に注目

- オープンソースの方向を追っている場合:GPT-5.5の効率ルートはオープンモデルに新しい追撃戦略を提供——パラメータを積み重ねず、学習品質を向上させる