シグナル

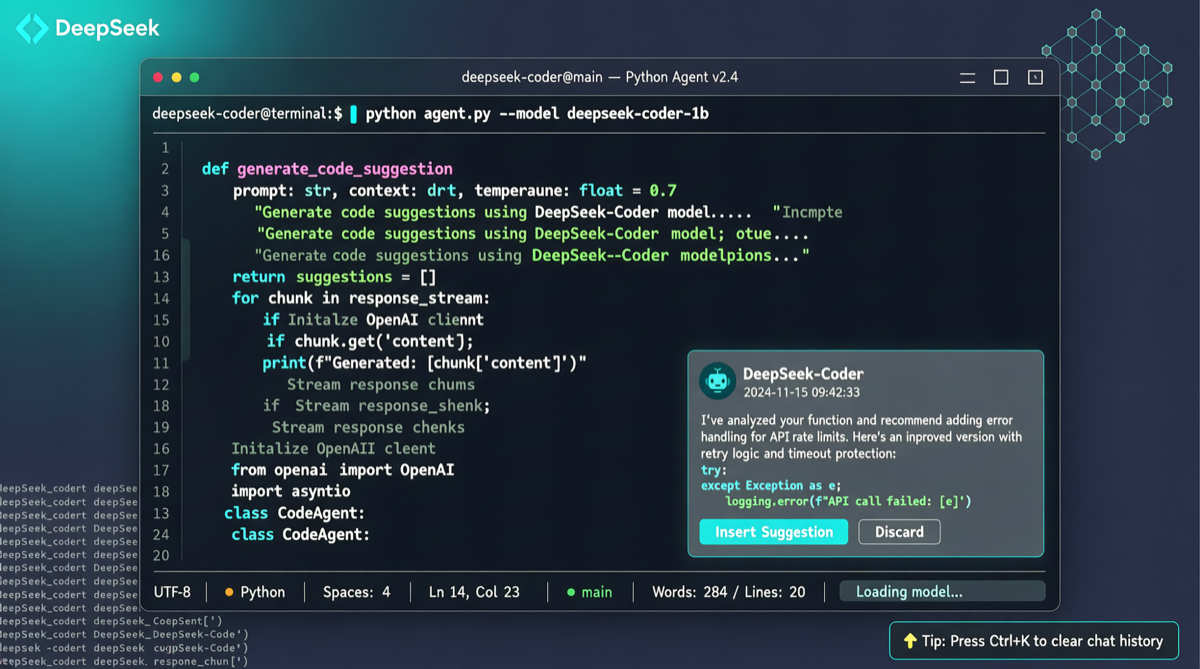

今日の GitHub Trending ランキングに注目すべきプロジェクトが登場しました:DeepSeek-TUI(Hmbown/DeepSeek-TUI)—— DeepSeek V4 の 1M トークンコンテキストとプレフィックスキャッシュを活用して構築されたターミナルネイティブのコーディングエージェントです。

現在のデータ:

- ⭐ 合計 3,831 スター、本日は +1,277 スター

- 🔀 259 フォーク

- 📦 565 コミット、最新バージョン v0.8.10

- 🏆 GitHub Trending 第4位

増分はどこにあるか

DeepSeek-TUI は単なる「ChatGPT のラッパー」ではありません。その設計哲学は明確です:DeepSeek の最先端モデルをターミナルの中に直接配置し、ファイルの読み書き、シェルコマンドの実行、ウェブ検索、git 管理、サブエージェントのオーケストレーション——これらすべてを高速なキーボード駆動の TUI(テキストユーザーインターフェース)を通じて実現します。

コアアーキテクチャ

deepseek CLI(ディスパッチャ)

→ deepseek-tui コンパニオンバイナリ

→ ratatui ターミナルインターフェース(Rust)

→ 非同期エンジン

→ OpenAI 互換ストリーミングクライアント

→ ツールルーティングレジストリ(shell / ファイル / git / ウェブ / サブエージェント / MCP / RLM)Node/Python の依存関係はゼロ——単一のバイナリだけで動作します。

3つの作業モード

| モード | 動作 | 用途 |

|---|---|---|

| Plan | 読み取り専用の探索、変更なし | コードレビュー、アーキテクチャ理解 |

| Agent | インタラクティブ、重要操作は人間の承認が必要 | 日常開発、リファクタリング |

| YOLO | 完全自動承認、確認不要 | 信頼されたワークスペース、バッチタスク |

主要機能

RLM 並列推論(r1a_query):1〜16個の安価な deepseek-v4-flash 子ノードを並列に展開し、バッチ分析と並列推論を実現。

思考プロセスのリアルタイムストリーミング:モデルの推論プロセスが「シンキングモード」としてターミナル上にリアルタイムで表示されます。エージェントがどのように一歩ずつ考えているのかを確認できます。

1M トークンコンテキスト:DeepSeek V4 の百万トークンコンテキストをネイティブにサポート。自動インテリジェント圧縮メカニズムを内蔵し、コスト最適化のためにプレフィックスキャッシュを認識します。

LSP 診断統合:編集のたびに rust-analyzer、pyright、typescript-language-server、gopls、clangd などの言語サーバーの診断情報を自動注入。モデルが次の推論ステップに進む前にコードの問題を把握できます。

セッション管理:長期セッションの保存/再開、ワークスペースのロールバック(サイドgitスナップショット)、/restore および revert_turn コマンドをサポート。

永続化タスクキュー:バックグラウンドタスクは再起動後も存続。スケジュールされた自動化や長期コードレビューに最適。

Skills システム:GitHub から取得可能な、コンポーザブルでインストール可能なスキルパック。バックエンドサービスは不要。

ユーザーメモリ:システムプロンプトに注入されるオプションの永続ノートファイル。セッションを跨いだ好み記憶を実現。

リアルタイムコスト追跡:1ターンごとおよびセッションレベルのトークン使用量とコスト見積もり。キャッシュヒット/ミスの中内訳を含む。

推論力のギア

Shift+Tab で推論力を切り替え可能:off → high → max、タスクの複雑さに応じて柔軟に調整。

マルチプロバイダー対応

デフォルトの DeepSeek API に加え、以下もサポート:

- NVIDIA NIM

- Fireworks

- セルフホスト SGLang

インストール

# npm でインストール

npm i -g deepseek-tui

# またはビルド済みバイナリを直接ダウンロード

# Linux / macOS / Windows に対応設定ファイルは ~/.deepseek/config.toml に配置されます。

分析

DeepSeek-TUI の急成長は、3つのトレンドの収束を反映しています:

第一に、ターミナルコーディングエージェントが主流パラダイムになりつつある。 Cursor から Aider、Claude Code まで、開発者は AI にコードベースを直接操作させることにますます慣れてきています。DeepSeek-TUI はこの体験を純粋なターミナル環境にもたらしました——SSH リモート開発、CI/CD パイプライン、低リソースサーバーなどのシナリオで特に魅力的です。

第二に、1M コンテキストはマーケティングスローガンからエンジニアリングの現実へと移行している。 DeepSeek V4 の百万トークンコンテキストとプレフィックスキャッシュの組み合わせにより、エージェントはチャンク検索を繰り返すのではなく、コードベース全体を一度に理解できるようになりました。これはコンテキストエンジニアリングの質的変化です。

第三に、国産モデルのターミナルエコシステムが形成されつつある。 これまで、ターミナル AI ツールはほぼ OpenAI/Claude エコシステムに独占されていました。DeepSeek-TUI は DeepSeek をデフォルトモデルとし、手頃な価格(deepseek-v4-flash の極めて低いトークンコスト)で、海外 API に依存しないターミナルエージェントのパスを中国の開発者に提供しています。

v0.8.10 の迅速なイテレーション(565 コミット)は、プロジェクトの高い活動レベルを示しています。RLM 並列推論、LSP 診断、Skills システムなどの機能は、すでに多くの同種ツールを凌駕しています。

注目すべき点:このプロジェクトは中国語ロケールの切り替えをサポートしており(README.zh-CN が昨日更新)、中国の開発者への明確な関心を示しています。DeepSeek ユーザーでターミナルワークフローを好む方にとって、これは現在最も完全なターミナルコーディングエージェントの選択肢となるかもしれません。