核心判断

世界模型(World Model)正在成为继大语言模型之后的下一个关键基础设施。

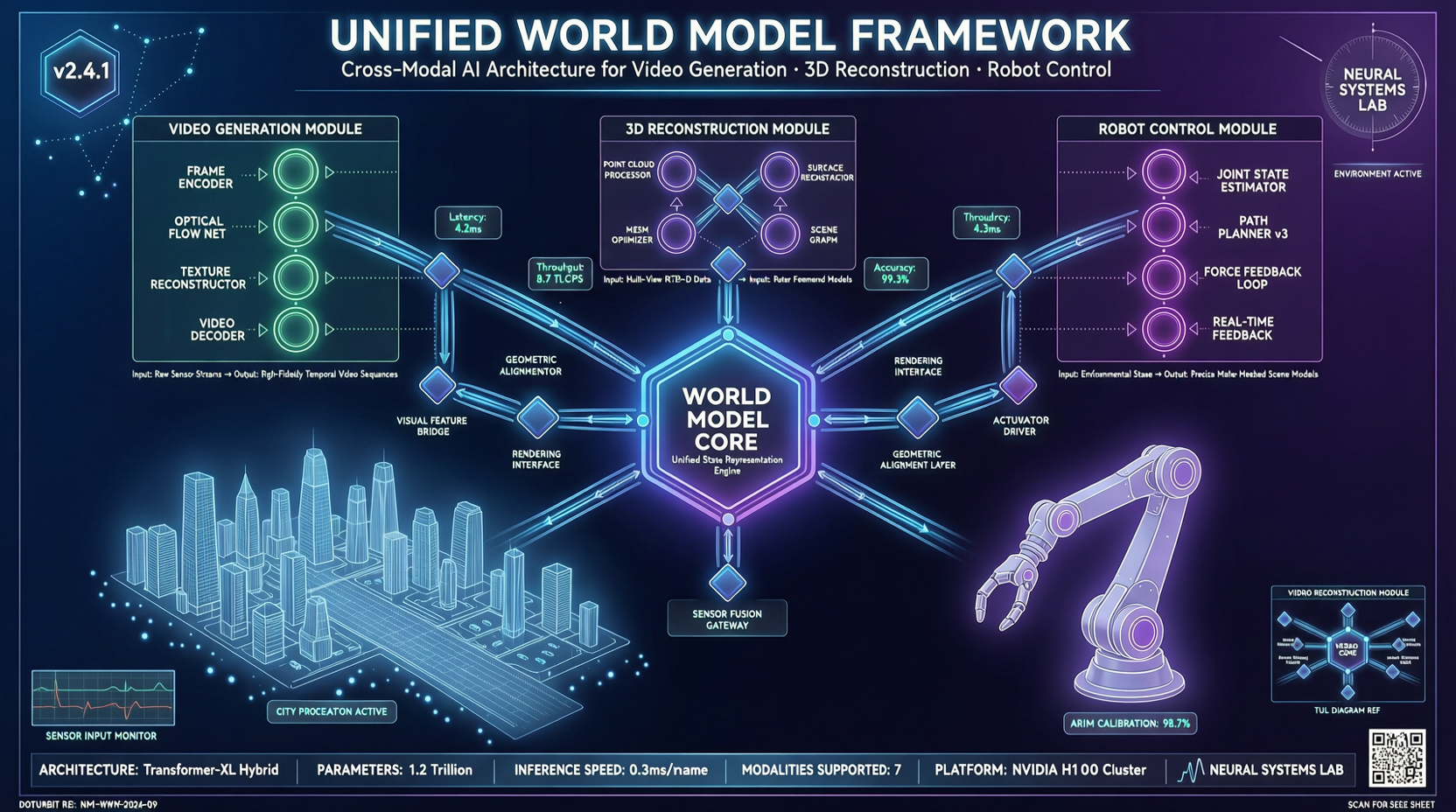

过去两年,AI 领域的研究重心正在从「纯文本生成」转向「对物理世界的感知、理解与交互」。但世界模型赛道面临一个严重的工程问题:视频生成、3D 重建、具身控制等任务各自为战,接口不统一、推理流程割裂、系统耦合严重。OpenWorldLib 的出现,试图通过一套标准化框架终结这种碎片化状态。

发生了什么

北京大学 DCAI 团队联合快手可灵团队、上海算法创新研究院、中关村学院等机构,正式开源了 OpenWorldLib——一个统一、规范、可扩展的先进世界模型推理框架。

该框架对世界模型做出了明确界定:一种以感知为核心,具备交互能力与长期记忆能力,用于理解和预测复杂世界的模型或框架。在此定义下,OpenWorldLib 整合了多模态理解、生成与行动能力,构建了面向开源社区的标准化接口体系。

技术细节:框架架构拆解

OpenWorldLib 的核心设计思路是「统一接口 + 模块化组装」,主要体现在三个层次:

1. Pipeline(核心调度层)

作为系统的中枢,Pipeline 负责串联各功能组件,实现从输入到输出的完整推理过程。支持两种执行模式:

- 单轮推理(forward):适用于视频生成、标准推理场景

- 多轮交互(stream):自动调用 Memory 模块维护历史状态,适用于交互式视频编辑或具身控制等需要长期依赖的复杂任务

2. Operator 机制(输入标准化层)

充当原始输入与核心执行模块之间的桥梁。世界模型需要处理文本、图像、连续控制动作、音频信号等多样化输入,Operator 负责两件事:

- 校验(Validation):确保输入格式、形状、类型满足下游模型要求

- 预处理(Preprocessing):将原始信号转换为标准化张量——图像缩放、文本分词编码、动作空间归一化

3. 四大核心模块

- Synthesis(合成):负责视频生成、图像生成等创作类任务

- Reasoning(推理):融合文本、图像等多模态信息,完成空间关系分析与复杂语义推理

- Representation(表征):从视觉输入到结构化三维表示的统一建模,支持 3D 场景重建

- Memory(记忆):为多轮交互提供上下文读取与更新能力,维持状态一致性

实验效果

框架在多个典型任务上进行了验证:

- 交互式视频生成:相比早期方法(Matrix-Game 系列),新一代模型在长序列生成中显著提升了视觉质量与物理一致性,减少了颜色漂移与结构失真

- 多模态推理:Reasoning 模块能输出具有可解释性的推理结果,使模型兼具「生成能力」和「理解决策能力」

- 3D 场景重建:通过 Representation 模块实现多视角重建与仿真验证,尽管在大视角变化下仍存在几何不一致问题

- VLA(视觉-语言-动作)控制:能将自然语言指令与视觉观测转化为动作序列,实现从「理解」到「行动」的闭环

行业意义

OpenWorldLib 的价值不只是又一个开源项目,它解决了一个关键的行业痛点:

研究者不再需要为每类任务单独构建推理逻辑与工程环境。

在这之前,做视频生成的团队和做具身控制的团队可能在使用完全不同的接口规范和工程架构,跨任务对比和模型复用极其困难。OpenWorldLib 通过统一的模块模板(Operator / Reasoning / Synthesis / Representation / Memory),让开发者只需实现对应接口即可接入新模型,无需修改整体架构。

这与 LLM 生态中 Hugging Face Transformers 库的角色类似——标准化接口降低了研究门槛,促进了生态的协同发展。

背景

OpenWorldLib 由北京大学 DCAI 团队主导开发。该团队深耕 AI 模型及数据侧的底层革新与系统落地,此前已开源了多个高质量项目:

- DataFlow:数据准备系统

- DataFlex:模型动态训练系统

- One-Eval:自动评估智能体

DCAI 主仓库:https://github.com/OpenDCAI

对于关注世界模型、具身智能或多模态 AI 的研究者和开发者来说,OpenWorldLib 提供了一个可直接上手、可扩展的基础设施,值得关注。