核心结论

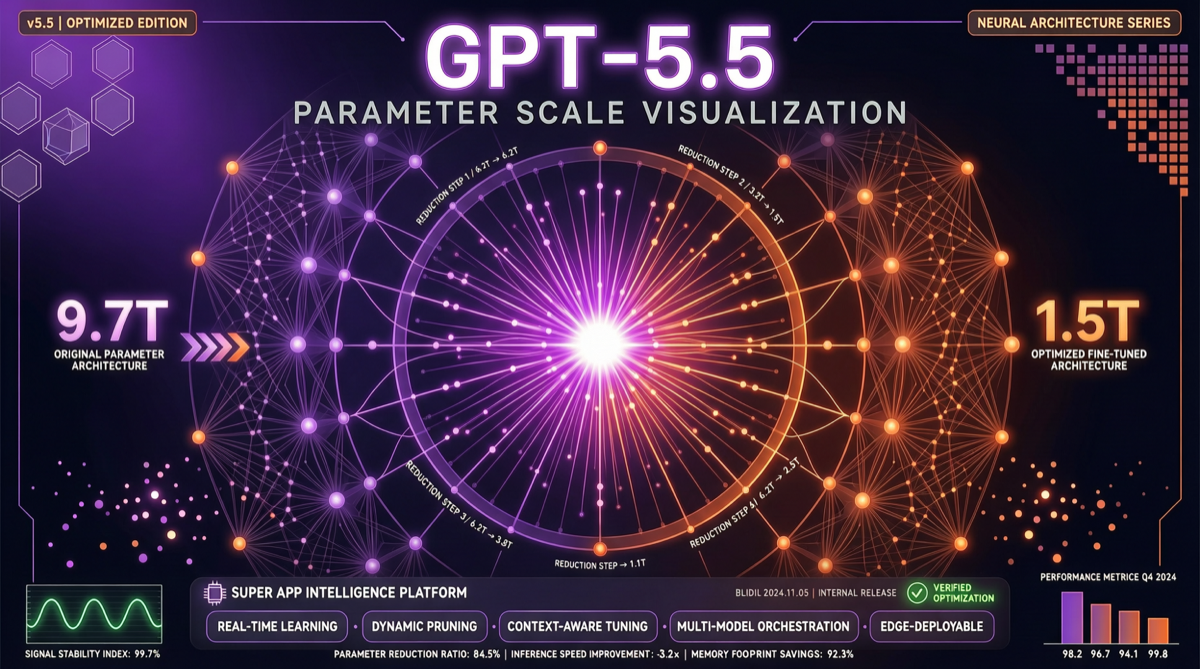

GPT-5.5 的参数量被重新计算——不是之前广泛流传的 9.7 万亿,而是 1.5 万亿。差距 6.5 倍。这意味着 OpenAI 用远比外界预期更小的模型,实现了同等甚至更优的性能。这不仅是技术路线的胜利,更是对整个行业”参数竞赛”叙事的颠覆。

参数修正意味着什么

数字对比

| 估算版本 | 参数量 | 来源 |

|---|---|---|

| 最初估算 | 9.7T | 早期泄露/推测 |

| 重新修正 | 1.5T | 研究人员重新计算 |

| 差距 | 6.5 倍 | — |

6.5 倍的参数差距,性能却持平甚至更好。这指向了几个关键事实:

1. 训练效率的大幅跃升

OpenAI 在 GPT-5.5 上实现了质的训练效率提升:

- 数据质量优于数据量:更精选的训练数据可以弥补参数规模的不足

- 架构优化:可能在注意力机制、位置编码或 MoE 策略上有重大改进

- RLHF/后训练效率:从 GPT-5.2 → 5.3 → 5.4 → 5.5 的迭代速度表明后训练流程高度成熟

2. 从”规模定律”到”效率定律”

行业长期以来信奉”scale is all you need”——参数越多、数据越多、算力越多,模型就越好。GPT-5.5 的出现暗示:

训练效率 > 参数规模

这对行业的影响是深远的:

- 中小团队不需要追求万亿参数也能做出好模型

- 算力成本不再是不可逾越的壁垒

- “小模型大智慧”可能成为 2026 下半年的主旋律

GPT-5.5:不止是模型更新

”超级应用”战略的一部分

路透社的报道揭示了 GPT-5.5 更宏大的定位——它是 ChatGPT 向平台化转型的核心组件:

- 生产力功能:文档处理、邮件、日程管理

- 搜索整合:内置实时搜索能力

- 内容创作:多模态生成能力

- 自动化:Codex agent 编排

这不是”更好的聊天机器人”,这是 OpenAI 在构建一个统一的 AI 入口。

版本迭代节奏压缩

从 2025 年 12 月到 2026 年 4 月,OpenAI 的发布节奏令人窒息:

2025.12 → GPT-5.2

2026.02 → GPT-5.3 (Codex)

2026.03 → GPT-5.4

2026.05 → GPT-5.5几乎每月一次重大更新。Anthropic 也在以类似节奏迭代(Opus 4.5 → 4.6 → 4.7)。AI 行业的”更新周期”从年缩短到月。

与 GPT-5.6 的关系

更有趣的是,有人已经在 Codex 内部日志中发现了 GPT-5.6 的痕迹。如果 GPT-5.5 是”自 GPT-4.5 以来首次从头重新训练的基础模型”,那么 GPT-5.6 可能意味着:

- 更极端的参数效率优化

- 全新的训练方法或数据策略

- 甚至可能是”参数更少但更强”的路线延续

Sam Altman 已经在预告 GPT-5.6 的到来。按照当前的节奏,可能在 2026 年 6-7 月就能看到。

格局判断

对竞争对手的冲击

- Claude/Anthropic:Opus 4.7 需要面对”参数效率”的新竞争维度。Anthropic 一直强调”更小更聪明”的路线,GPT-5.5 的修正恰好验证了这一方向

- DeepSeek/开源阵营:1.5T 的参数量意味着开源模型追赶的门槛进一步降低

- Google/Gemini:Gemini 3.1 Pro 的发布节奏被压缩,必须在效率维度上给出回应

对行业的影响

- 算力需求预期下调:如果 1.5T 就能做到 9.7T 的效果,那训练成本会大幅降低

- 开源社区受益:更小的参数规模意味着更容易复现和微调

- “规模竞赛”叙事终结:行业关注点从”谁的模型更大”转向”谁的训练更高效”

行动建议

- 如果你在规划算力采购:重新评估需求,1.5T 级别的模型可能已经够用

- 如果你在做模型选型:不要只看参数规模,关注训练效率和实际任务表现

- 如果你在关注开源方向:GPT-5.5 的效率路线为开源模型提供了新的追赶策略——不需要堆参数,提升训练质量