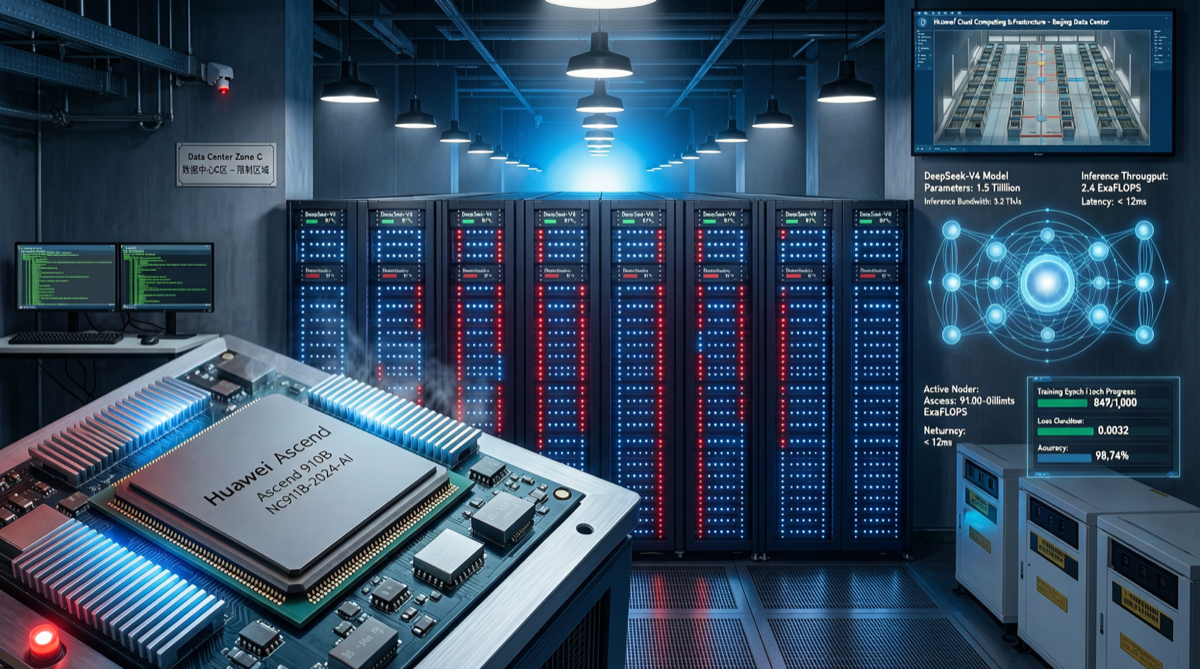

当 DeepSeek V4 在 2026 年 4 月 24 日正式发布时,技术圈最关注的是它的万亿参数 MoE 架构和 1/166 于 GPT-5.5 的定价。但一个被忽略的细节才是真正的信号:DeepSeek 正在系统性地将其训练和推理基础设施迁移到华为昇腾芯片上。

延迟发布背后的芯片真相

DeepSeek V4 的发布时间比市场预期的晚了数周。CCTV 关联社交媒体账号透露,延迟的核心原因不是模型本身的技术问题,而是 DeepSeek 在进行一次底层算力架构的大规模切换。

| 阶段 | 算力来源 | 战略意图 |

|---|---|---|

| DeepSeek V3 时代 | 英伟达 A100/H100(存量) | 利用出口管制前的库存 |

| DeepSeek V4 训练期 | 昇腾 910B + 英伟达混合 | 过渡期,验证国产算力可行性 |

| DeepSeek V4 推理期 | 昇腾芯片为主 | 推理端率先完成国产化替代 |

| DeepSeek V5 规划 | 昇腾 + 国产芯片全栈 | 训练端完全自主 |

这不是一个公关叙事。DeepSeek 的选择是被迫与主动的混合体:美国出口管制让英伟达高端芯片的获取变得不可靠,但与此同时,昇腾 910B 的性能迭代恰好达到了可用的临界点。

昇腾 910B:从”能用”到”好用”

昇腾 910B 的关键进步不在于单卡性能超越 H100——它没有——而在于生态系统成熟度。

软件栈突破:

- CANN 8.0 对 PyTorch 的兼容层显著改善,迁移成本从”重写大部分代码”降到”修改部分算子”

- MindSpore 框架在大规模分布式训练中的稳定性经过 V4 训练周期验证

- 昇腾与 DeepSeek 的 MoE 架构有特殊的优化路径——稀疏激活模式恰好匹配昇腾的内存带宽特性

成本账:

- 昇腾集群的每 token 训练成本约为英伟达方案的 60-70%

- 但考虑到供应链安全性和汇率风险,长期 TCO(总拥有成本)的差距更大

- DeepSeek 的极致效率工程(370 亿激活参数 / 1 万亿总参数)使昇腾的内存瓶颈被有效缓解

地缘政治下的 AI 供应链重构

美国国务院 2026 年 4 月发布的外交密电指控 DeepSeek、月之暗面(Kimi)和 MiniMax 通过”蒸馏”方式获取美国模型能力。这一指控与芯片管制的组合拳,正在加速中国 AI 公司的去美化进程。

三股力量交汇:

- 出口管制:英伟达特供版芯片(H20)性能受限,性价比持续走低

- 国产替代:昇腾 910B 迭代 + 海光 DCU + 寒武纪,多条技术路线并行

- 模型效率革命:MoE、量化、蒸馏等技术降低了对绝对算力的依赖

DeepSeek 的选择具有示范效应。如果中国排名第一的开源模型公司能在昇腾上训练出世界级模型,其他公司的迁移意愿将大幅提升。

读者行动建议

对于开发者:

- 如果你的服务面向中国市场,现在应该开始测试昇腾平台的模型部署

- DeepSeek V4 的 Ascend 优化版本预计将在 2026 年 Q2 推出,提前适配可以避免后期迁移成本

- 关注华为昇腾社区的工具链更新——CANN 的迭代速度正在加快

对于企业决策者:

- 算力供应链的多元化已经不是”可选项”,而是”必选项”

- 评估模型供应商时,将”芯片供应链安全性”纳入考量维度

- DeepSeek V4 Pro 折扣延长至 5 月 31 日,现在是锁定低成本 API 的窗口期

对于投资者:

- 昇腾生态的受益方不限于华为,还包括服务器厂商、软件适配层公司和算力运营方

- 中国 AI 芯片自主化的投资逻辑正在从”概念”转向”业绩验证”

格局判断

DeepSeek V4 的昇腾转向不是孤立事件,而是一个趋势的缩影。2026 年下半年,我们将看到更多中国 AI 公司公开宣布其国产芯片适配计划。这不仅仅是技术选择,更是供应链安全的战略决策。

真正的竞争不在模型层面,而在算力基础设施层面。谁能以更低成本、更可靠的方式获取算力,谁就能在下一轮模型迭代中占据主动权。DeepSeek 已经用行动给出了答案:不等别人给你芯片,自己造路。