核心发现

cocoindex-io/cocoindex 本周登上 GitHub Trending Python 榜单,获得 8,000+ Star。项目的定位很独特:它不是又一个 Agent 编排框架,而是一个增量计算引擎,专门为长时间运行的 Agent 任务设计。

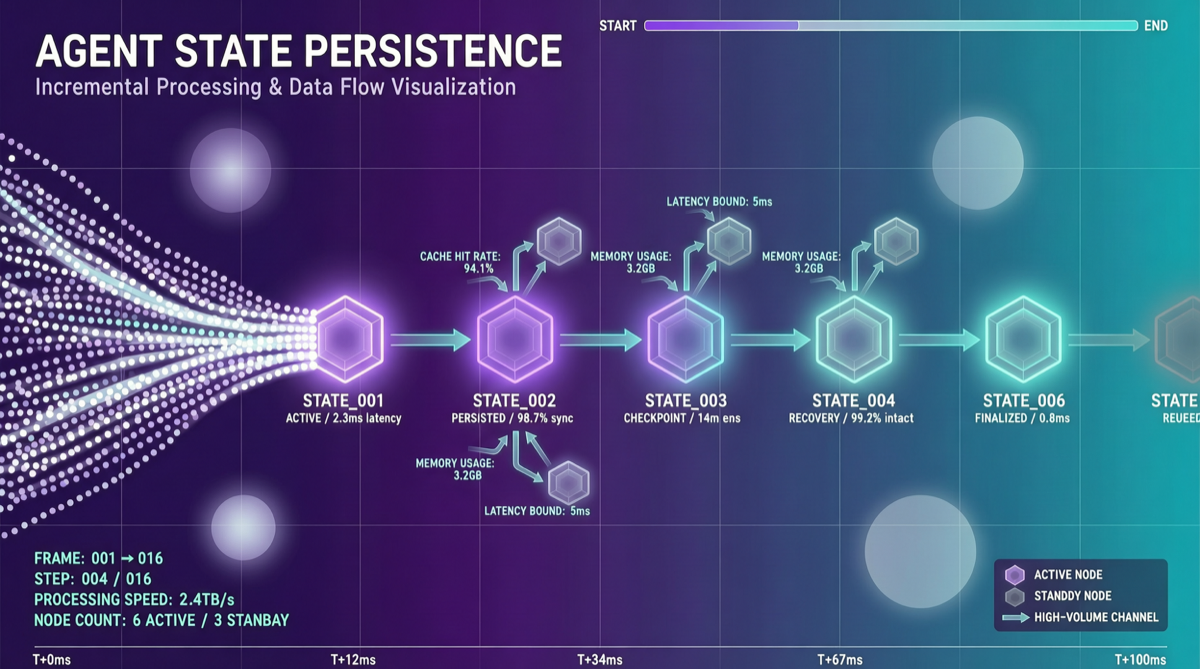

项目的标语直接点明了痛点:“Incremental engine for long horizon agents”——解决 Agent 在长时间任务中的状态持久化和增量更新问题。

为什么长周期 Agent 是难题?

当前的 Agent 框架(LangChain、CrewAI、AutoGen 等)在短周期任务(几分钟内的问答或简单工具调用)上表现良好,但在长周期场景下面临三个核心挑战:

挑战 1:上下文丢失

Agent 运行 30 分钟后,LLM 的上下文窗口可能已经被中间结果占满。传统做法是截断或摘要历史对话,但这会导致关键信息的不可逆丢失。

挑战 2:状态不可恢复

如果 Agent 进程因网络中断、服务器重启或 Token 耗尽而中断,整个推理状态丢失,必须从头开始。

挑战 3:重复计算

长周期任务通常涉及对同一数据集的反复查询和分析。如果没有增量缓存机制,Agent 会反复执行相同的子任务,浪费 Token 和时间。

cocoindex 的解决方案

cocoindex 的核心思路是借鉴数据库和流处理领域的增量计算范式:

| 概念 | 传统 Agent | cocoindex Agent |

|---|---|---|

| 状态管理 | 内存中的对话历史 | 持久化的增量状态树 |

| 中断恢复 | 丢失全部状态 | 从最近的检查点恢复 |

| 重复计算 | 每次重新执行 | 增量更新,只处理变化部分 |

| 数据管道 | Agent 内部硬编码 | 声明式管道定义 |

关键架构特点

- 声明式管道:用 Python 代码定义数据处理流程,cocoindex 自动追踪依赖关系

- 增量执行:只有输入数据发生变化时,相关步骤才会重新执行

- 状态持久化:Agent 的中间状态可以持久化到磁盘,支持跨会话恢复

- 长上下文友好:通过增量状态树,Agent 不需要将整个历史加载到 LLM 上下文中

典型使用场景

| 场景 | 传统方案的问题 | cocoindex 的优势 |

|---|---|---|

| 持续代码审查 | 每次 PR 审查都从空状态开始 | 维护代码库的增量理解,新变更只需分析 diff |

| 数据管道监控 | 定时全量检查数据质量 | 增量监控,只处理新增/变更的数据 |

| 长周期研究任务 | 数小时的研究会话中断后丢失进展 | 状态持久化,可随时暂停和恢复 |

| 知识库持续更新 | 全量重建索引成本高 | 增量更新索引,只处理新增内容 |

与现有框架的关系

cocoindex 不是 LangChain 或 CrewAI 的替代品,而是一个底层引擎:

┌─────────────────────────────────────┐

│ LangChain / CrewAI (编排层) │

│ 定义 Agent 角色、任务、工作流 │

├─────────────────────────────────────┤

│ cocoindex (增量引擎层) │

│ 状态持久化、增量计算、恢复检查点 │

├─────────────────────────────────────┤

│ LLM API (模型层) │

│ GPT-5.5 / Claude / Qwen 等 │

└─────────────────────────────────────┘这种分层架构让 cocoindex 可以与任何 Agent 框架配合使用——它解决的是框架层不关心的基础设施问题。

格局判断

长周期 Agent 是 2026 年的关键趋势之一。随着 Agent 从”问答助手”演变为”自主工作者”(写代码、做研究、管理项目),长时间运行的能力从加分项变成了必需品。

cocoindex 的出现标志着 Agent 基础设施正在从”快速原型”阶段走向”生产就绪”阶段。增量计算、状态持久化、检查点恢复——这些都是数据库和流处理领域已经成熟的技术,现在被引入到 Agent 生态中。

行动建议

- 评估你的 Agent 是否需要长周期能力:如果你的 Agent 运行时间超过 10 分钟,或者需要跨多个会话工作,cocoindex 值得评估

- 与现有框架的集成测试:如果你已经在用 LangChain/CrewAI,可以先在部分流程中引入 cocoindex 做增量状态管理,观察效果

- 关注检查点策略:cocoindex 的效果很大程度上取决于检查点的频率和粒度——太频繁会拖慢性能,太稀疏会增加恢复成本