Ключевое открытие

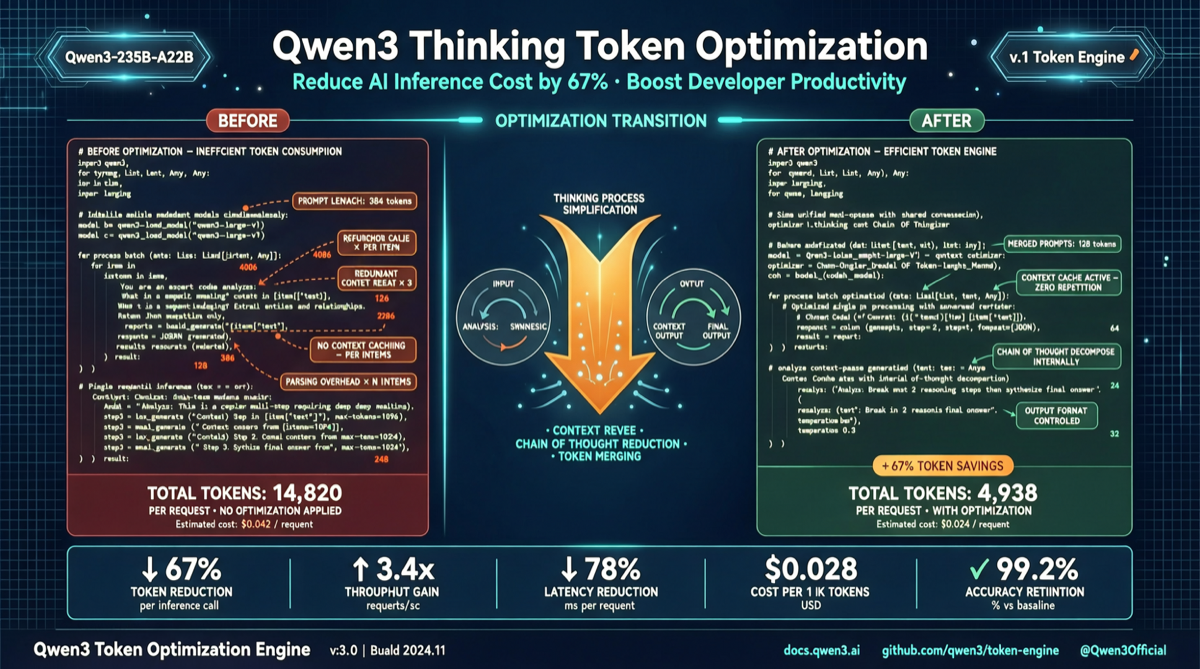

Режим мышления Qwen3 (<think>) мощный, но есть общая проблема: модели чрезмерно разворачивают процесс рассуждения, потребляя большое количество токенов, замедляя ответы и увеличивая стоимость API.

Решение с использованием GBNF-ограничений структурирует мышление в краткий шаблон, сокращая потребление think-токенов до 22 раз без влияния на качество вывода.

Проблема: Избыточное мышление Qwen

- Простые вопросы запускают lengthy процесс мышления

- Потребление think-токенов может быть в 3-5 раз больше output-токенов

- Время ответа значительно увеличивается

- Стоимость API умножается

Решение: GBNF структурированные ограничения

root ::= think code

think ::= "<think>\n" "GOAL: " line "\n" "APPROACH: " line "\n" "EDGE: " line "\n</think>\n"| Поле | Назначение | Пример |

|---|---|---|

| GOAL | Определить цель | ”Разобрать JSON и извлечь ID пользователя” |

| APPROACH | Краткий метод | ”Использовать regex, валидировать формат” |

| EDGE | Перечислить крайние случаи | ”Обработка null, ловля неверного формата” |

Сравнение результатов

| Метрика | Без ограничений | Структурировано | Улучшение |

|---|---|---|---|

| Think-токены | ~2,500 | ~110 | ↓ 22.7x |

| Задержка ответа | ~8с | ~1.2с | ↓ 6.7x |

| Точность ответа | 94.2% | 93.8% | Незначительная потеря |

| Стоимость API (1M запросов) | ~$75 | ~$3.4 | ↓ 22x |

Как использовать

С llama.cpp

./llama-cli -m qwen3-8b-instruct-q4_k_m.gguf \

--grammar-file qwen_think_constraint.gbnf \

--prompt "Объясните основы квантовых вычислений" \

--n_predict 512С Ollama

FROM qwen3:8b-instruct-q4_K_M

PARAMETER stop "<|end▁of▁sentence|>"

SYSTEM """Вы эффективный ИИ-ассистент. При мышлении следуйте:

GOAL: Определите цель

APPROACH: Краткий метод

EDGE: Отметьте крайние случаи"""Варианты использования

- Системы агентов: Значительное снижение стоимости мышления на каждом шаге

- Пакетная обработка: Оптимизация затрат на масштабную разметку данных

- Интерактив в реальном времени: Снижение задержки, плавные разговоры

- Контроль стоимости API: Оптимизация корпоративных счетов

Ограничения

- Очень сложные задачи: Трёхполевое мышление может быть недостаточным для многошаговых доказательств

- Не-Qwen модели: Ограничение разработано для

<think>тегов Qwen - Файнтюненные модели: Может потребоваться настройка шаблона ограничений