Главное в двух словах

NVIDIA официально раскрыла данные о производительности инференса DeepSeek V4 на платформе Blackwell, и основная информация весьма значима:

- DeepSeek V4 (1.6T параметров MoE) достигла 20-кратного снижения стоимости за токен на Blackwell

- Нативная поддержка окна контекста в 1 миллион токенов, доступна с первого дня

- NVIDIA подчёркивает, что это единственная аппаратная платформа, совместно спроектированная с MoE моделями

Это не просто заявление «работает быстрее» — оно раскрывает более глубокую тенденцию: агентный ИИ фундаментально меняет логику проектирования чипов для инференса.

Почему в 20 раз?

Чтобы понять вес этой цифры, нужно рассмотреть архитектурные особенности DeepSeek V4 и целевые оптимизации Blackwell:

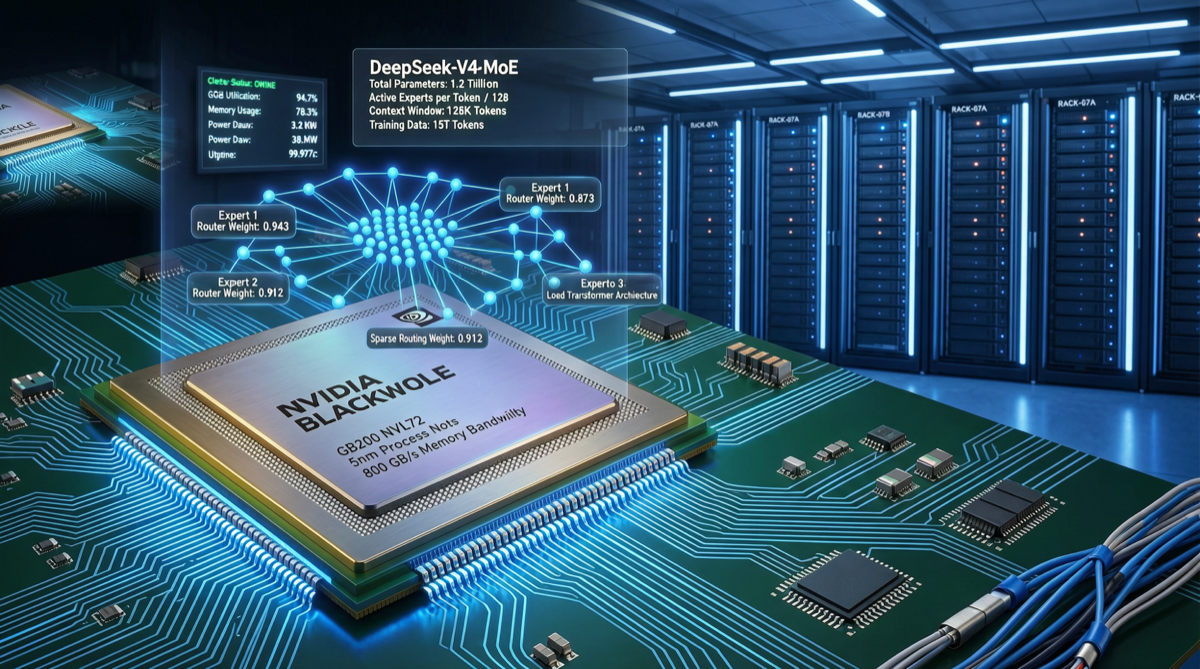

Архитектура MoE DeepSeek V4

DeepSeek V4 использует архитектуру смеси экспертов (MoE):

- Общее количество параметров: 1.6 триллиона

- Активированные параметры: примерно 37 миллиардов (при каждом инференсе активируется лишь небольшая часть экспертов)

- Контекст: 1 миллион токенов

Характеристика MoE — вычисления разрежены, но память интенсивна — не все параметры используются при каждом инференсе, но все параметры должны находиться в видеопамяти.

Целевые оптимизации Blackwell

NVIDIA Blackwell сделала несколько ключевых проектных решений для MoE:

- Увеличение пропускной способности NVLink 5 — MoE требует быстрой маршрутизации между различными экспертами на нескольких GPU, пропускная способность межсоединения является бутылочным горлышком

- Transformer Engine второго поколения — поддерживает более детальную смешанную точность FP4/FP6, снижая память активаций

- Движок декомпрессии — сжатые веса распаковываются при передаче, снижая давление на пропускную способность памяти

Когда разреженные вычисления MoE встречаются с целевой оптимизацией Blackwell, 20-кратное снижение стоимости становится объяснимым.

Новые требования агентного ИИ к инференсу

NVIDIA особо выделила «агентный ИИ» в этом заявлении. Почему?

Традиционные сценарии инференса — это «один вопрос, один ответ»: ввод пользователя -> вывод модели -> готово.

Сценарии агентного ИИ совершенно иные:

- Многоходовое автономное взаимодействие: агенты могут вызывать модель десятки или даже сотни раз последовательно

- Накопление длинного контекста: история каждого взаимодействия должна сохраняться в контексте

- Вызов инструментов: моделям необходимо многократно вызывать внешние инструменты и API

В этом сценарии стоимость за токен напрямую определяет экономическую целесообразность агентов. Если одна задача агента потребляет 500 тысяч токенов, то цена $3.48 за миллион токенов означает примерно $1.74 за задачу — приемлемо при масштабировании. Но при цене в 20 раз выше традиционной каждая задача стоила бы $34.80, и бизнес-модель рушится.

Влияние на индустрию

| Измерение | Влияние |

|---|---|

| Стоимость развёртывания моделей | Порог развёртывания 1.6T MoE значительно снижается, малые и средние предприятия могут рассмотреть передовые модели |

| Экономика агентов | 20-кратное снижение стоимости делает масштабное развёртывание сложных многошаговых агентов возможным |

| Конкуренция чипов | NVIDIA строит аппаратный ров для MoE-инференса через совместное проектирование |

| Выход китайских моделей на глобальный рынок | Международная конкурентоспособность DeepSeek V4 дополнительно усилена оптимизацией Blackwell |

Деталь, заслуживающая внимания

NVIDIA заявляет, что это «единственная платформа, совместно спроектированная» с MoE моделями.

Что это значит? Серия MI400 от AMD и TPU v6 от Google могут временно отставать в MoE-инференсе. MoE становится мейнстримной архитектурой (DeepSeek V4, Mixtral, Qwen-MoE — все идут по этому пути), и если NVIDIA закрепит преимущество первопроходца в оптимизации MoE на аппаратном уровне, этот разрыв может сохраниться на протяжении нескольких циклов продуктов.

Вывод

Комбинация DeepSeek V4 + Blackwell иллюстрирует ключевую логику конкуренции в AI-инфраструктуре 2026 года:

Дело не в том, что большие модели лучше, а в том, что степень синергии «архитектура модели + аппаратная платформа» определяет конечную производительность.

Для разработчиков, использующих DeepSeek V4, выбор платформы Blackwell означает 20-кратное снижение стоимости за токен — в сценариях агентов это может напрямую определить, будет ли проект реализован или нет.