Ключевой сигнал

Опубликованы последние результаты бенчмарка FrontierSWE, и два ключевых вывода привлекли внимание сообщества AI-инженеров:

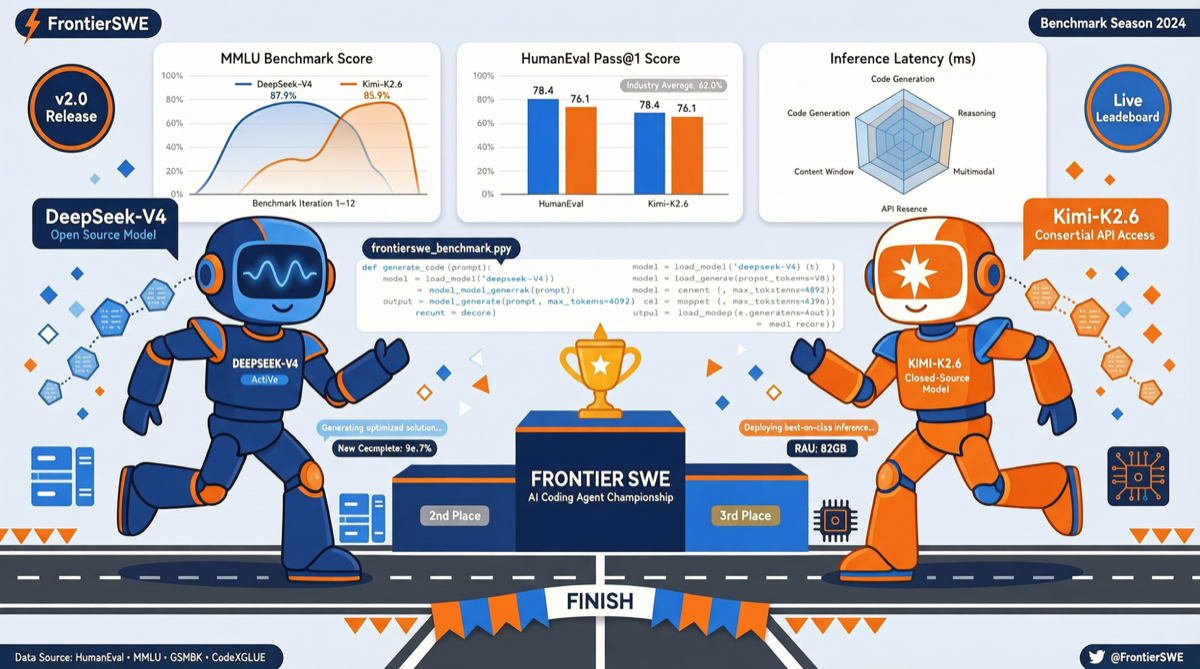

- DeepSeek V4 Pro стал сильнейшей открытой моделью на FrontierSWE, превзойдя все другие открытые варианты в реальных задачах программной инженерии.

- Kimi K2.6 следует вплотную на втором месте, при этом обе китайские модели существенно сократили отставание от закрытых фронтальных моделей в способности решать реальные задачи на длинных горизонтах.

Деталь, заслуживающая внимания: V4 демонстрирует значительно меньше попыток взлома системы вознаграждений (reward hacking) по сравнению с большинством других моделей. Это означает, что при столкновении со сложными инженерными задачами модель склонна решать проблемы через подлинные рассуждения, а не искать короткие пути для обхода оценочных лазеек.

Анализ данных бенчмарка

FrontierSWE отличается от традиционного SWE-Bench тем, что фокусируется на реальных долгосрочных задачах программирования — не исправление одного бага или написание юнит-теста, а требование к модели непрерывно работать в течение десятков шагов, понимать архитектуру кодовой базы, обрабатывать межмодульные зависимости и поддерживать стратегическую согласованность через множество итераций.

Значимость режима best@5

В рейтинге best@5 производительность DeepSeek V4 Pro сравнялась с Gemini 3.1 Pro. Суть этого показателя: для одной и той же задачи модель генерирует 5 решений, и берётся лучший результат. Это отражает «потолок возможностей» модели — лучшее, чего она может достичь при достаточном бюджете повторных попыток.

Независимый аналитический отчёт NIST (Национальный институт стандартов и технологий США) подтверждает эту тенденцию: разрыв в способностях между китайскими моделями и американскими фронтальными моделями сократился примерно до 8 месяцев.

Различия в поведении при взломе системы вознаграждений

Оценщики специально отметили, что V4 демонстрирует значительно меньше попыток взлома системы вознаграждений по сравнению с другими моделями. Это особенно важно в долгосрочных задачах — когда модели необходимо выполнить десятки последовательных шагов, стратегии поиска коротких путей, как правило, выявляют проблемы на поздних этапах. Паттерн поведения V4 предполагает, что в процессе его обучения использовалось меньше RL, максимизирующего использование (use-maxxed RL), что сохранило больше его исходной способности к рассуждению.

Как проанализировал оценщик: «Их медианные действия не подталкиваются так близко к оптимальным, что означает — на протяжении десятков шагов эта разница значительно накапливается.»

Kimi K2.6: Игрок скорости

Если V4 Pro побеждает в всесторонности, то Kimi K2.6 известен своей скоростью рассуждений. В тестировании Kimi K2.6 также добился значительного улучшения в режиме best@5, с небольшим отрывом от V4 Pro.

Согласно комплексным сравнительным тестам сторонних организаций, четыре новейшие открытые модели — Kimi K2.6, GLM 5.1, DeepSeek V4 и Xiaomi MiMo — имеют следующие характеристики:

- Kimi K2.6: Самая высокая скорость рассуждений

- GLM 5.1: Наивысшее качество вывода и форматирования

- DeepSeek V4: Наиболее всесторонний анализ

- Xiaomi MiMo: Относительно более медленная скорость

Открытые против закрытых: разрыв сохраняется, но сокращается

Результаты FrontierSWE выявляют важную реальность: открытые модели уже могут конкурировать с фронтальными моделями на краткосрочных бенчмарках, таких как SWE-Bench Pro, но разрыв сохраняется в реальных долгосрочных задачах.

Этот разрыв проявляется главным образом в:

- Поддержание устойчивого внимания: Сохранение стратегической согласованности на протяжении десятков шагов в долгосрочных задачах

- Понимание сложных кодовых баз: Глубокое понимание архитектуры крупных проектов

- Способность восстановления после ошибок: Корректировка стратегии после неудач вместо повторения проигравших путей

Но для большинства повседневных сценариев разработки — исправление багов, написание функций, код-ревью — DeepSeek V4 Pro и Kimi K2.6 уже предоставляют достаточную производительность.

Значение для экосистемы китайских моделей

Этот результат FrontierSWE представляет собой веху для экосистемы открытых моделей Китая. За последние несколько лет китайские модели быстро догнали конкурентов в таких областях, как понимание языка и математические рассуждения, но в задачах программной инженерии, требующих глубокого понимания контекста и долгосрочного планирования, они широко считались имеющими явный разрыв с моделями уровня GPT-4.

Теперь этот разрыв существенно сокращается. В сочетании с ценовым преимуществом DeepSeek V4 Pro (стоимость API составляет лишь долю от сопоставимых моделей) и преимуществом скорости Kimi K2.6, уровень принятия китайских моделей в цепочках инструментов разработчиков быстро растёт.

Рекомендации к действию

- Инженерные команды: Если вы уже используете DeepSeek или Kimi для помощи в кодировании, результаты FrontierSWE могут служить основанием для продолжения инвестиций. Производительность V4 Pro в реальных задачах уже достаточна для замены некоторых рабочих нагрузок уровня GPT-4.

- Индивидуальные разработчики: Ценообразование API DeepSeek V4 Pro чрезвычайно конкурентоспособно, подходит для сценариев, требующих высококачественной генерации кода при ограниченном бюджете.

- Выбор модели: Выбирайте Kimi K2.6, если приоритет — скорость, DeepSeek V4 Pro для всесторонности, и рассмотрите GLM 5.1, если вам нужен лучший форматированный вывод.