AIモデル競争において、長らくデフォルトの仮定が存在した:パラメータが多い = 能力が高い。しかしIntelligence Indexの最新データはこの仮定を打ち破ろうとしている。

コアデータ

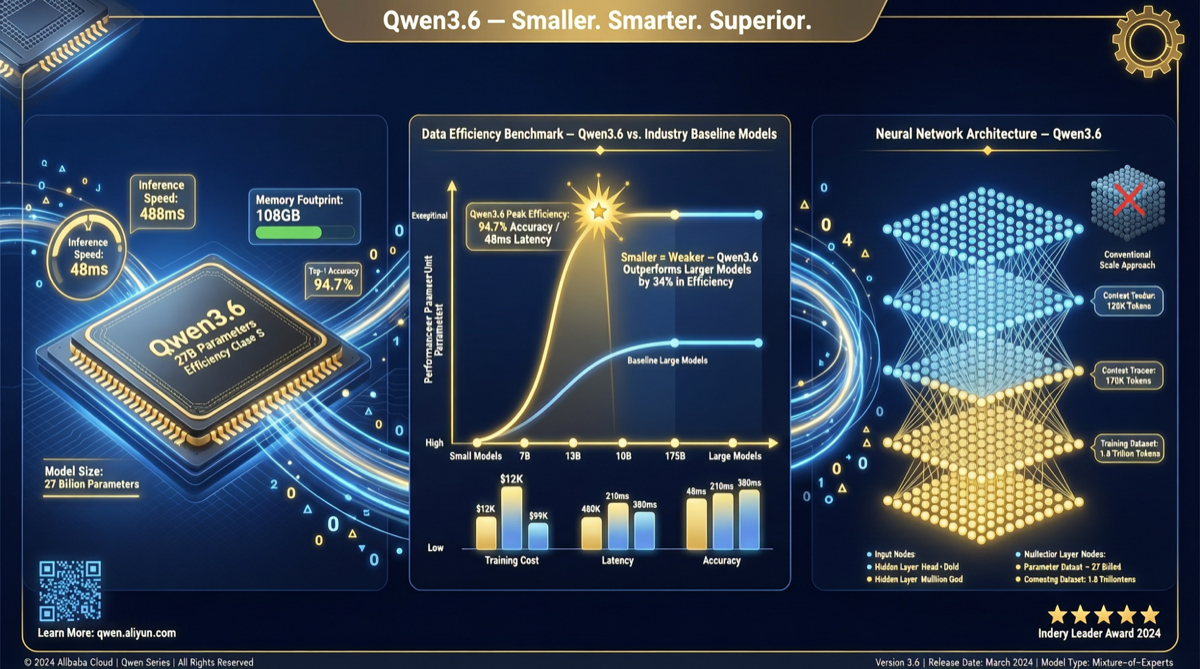

Qwen3.6 27BがGDPval-AAテストで1414 Eloを記録。この数字の意義:

| モデル | パラメータ | GDPval-AA Elo |

|---|---|---|

| Qwen3.6 27B | 27B | 1414 |

| DeepSeek V4 Flash | 284B (1.6T MoE) | 1414 |

| Meta Muse Spark | 未公開 | 1414 |

| Qwen3.5 27B | 27B | 1157 |

核心結論:Qwen3.6 27BはDeepSeek V4 Flashの10分の1未満のパラメータで全く同じスコアを達成。Qwen3.5 27Bと比較して257 Elo急増。

257 Eloの意味

Intelligence Index评价体系において、257ポイントの上昇は1世代のモデル迭代を跨越することに相当:

- GPT-4 → GPT-4o:約150-200 Elo

- Claude 3 Haiku → Sonnet:約100-150 Elo

- Qwen3.5 → Qwen3.6:257 Elo = 1世代の改善を超える

しかもこれはパラメータ不変(引き続き27B)で達成された。改善は完全に訓練方法、データ品質、アーキテクチャ最適化による——パラメータの積み上げではない。

なぜ重要なのか

1. 推論コスト革命

27Bモデルの推論コストは284Bモデルの約1/10。能力が同等なら:

- 自部署の閾値が大幅に低下(コンシューマーGPUで実行可能)

- API呼び出しコストが1桁低下

- エッジデプロイメントが「不可能」から「可能」に

2. オープンソースエコシステムの転換点

27Bのオープンウェイトモデルが数百億パラメータのクローズドモデルに匹敵するとき、「大企業しか良いモデルを訓練できない」という叙事が崩れ始める。

アクションアイテム

- モデル選定中の方へ:極端なパフォーマンス要件がない場合、Qwen3.6 27Bは現在最高のコストパフォーマンス選択肢の可能性

- エッジデプロイメント:27Bは現在RTX 4090(24GB)1枚でINT4量子化で実行可能な最大「トップクラス」モデル

- オープンソース動向追跡:Qwen3.6の訓練方法論は深入研究の価値あり——「より多くのパラメータなしでより良くする」技術方向を代表

パラメータ競争の次の段階は「誰が大きいか」ではなく**「誰がより効率的か」**。Qwen3.6 27Bはすでに答えを出した。