AIエージェントの「トレーニング可能」革命

長年、AIエージェントは構築は簡単だが最適化は困難という核心的な矛盾に直面してきた。

LangChainやCrewAIなどのオーケストレーションフレームワークを使えば、ツールを定義し、プロンプトを書き、LLM APIに接続してエージェントを素早く構築できる。しかし、期待通りのパフォーマンスが得られない場合、最適化手段は非常に限られている:プロンプトエンジニアリング、ツール呼び出しロジックの調整、あるいはベースモデルの切り替え。

これらはすべて「手動チューニング」の方法であり、従来の機械学習モデルのようにデータ駆動でシステマティックにパフォーマンスを向上させることはできない。

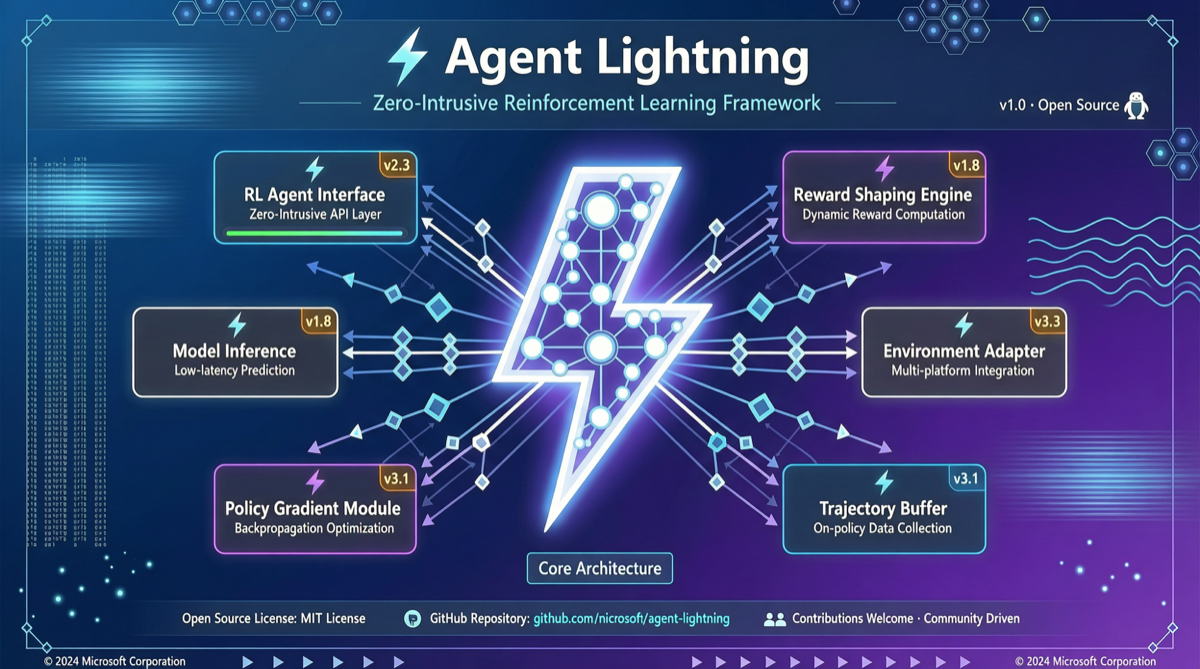

マイクロソフトアジア研究院がオープンソース化したAgent Lightningフレームワークは、この問題に根本から取り組むものである。

コアコンセプト:ゼロ侵入型強化学習

Agent Lightningの設計哲学は一言で表せる:エージェントのコードに触れずに、より強くする。

| コンポーネント | 機能 |

|---|---|

| Observer | エージェントと環境のすべての相互作用をインターセプトし、状態-アクション-結果のシーケンスを記録 |

| Reward Engine | プラガブルな報酬計算エンジン。結果レベルの報酬(タスクの成功/失敗)とプロセスレベルの報酬(ツール呼び出し効率、パス品質)をサポート |

| Trainer | PPO/GRPOなどの強化学習アルゴリズムに基づくポリシーオプティマイザー。vLLM、Megatron-LMなどの推論バックエンドと互換 |

| Strategy Injector | トレーニングされたポリシーを「行動ガイダンス」としてエージェントに注入。エージェントのソースコード変更不要 |

なぜこれが重要なのか

1. エージェント最適化のハードルを下げる

現在、RLエンジニアリング能力を持つ少数のチームのみがエージェントをシステマティックに最適化できる。Agent Lightningはこの能力を「報酬関数を設定するだけで使える」ツールに変えた。

2. 「ラストマイル」問題の解決

ベースモデルの能力は急速に向上しているが、エージェントのパフォーマンスは「その能力をどれだけうまく使うか」に依存する。Agent Lightningはベースモデルを変更せずに、RLトレーニングによって特定タスクでのエージェントのパフォーマンスを数倍に向上させることができる。

適用シナリオ

- 複雑なワークフローエージェント:複数ステップの推論と複数ツールの呼び出しが必要なシナリオ

- カスタマーサービス/対話エージェント:対話品質やユーザー満足度を報酬信号として継続的に最適化

- 自律実行エージェント:OpenClawやHermes Agentのように環境で自律的に意思決定を行うシステム

主な情報源:

- Agent Lightning GitHub - Microsoft

- MSRA Agent Lightning紹介 - MSRA