核心结论

LLM API 市场正在经历「支付层」的整合。WorldRouter 作为 WLFI 生态的新成员,把 Claude Opus 4.7、GPT-5.5、Gemini 2.5 Pro、Qwen 3 等 300+ 模型塞进同一个账户,并且所有模型价格统一打七折。

这不只是「便宜」的问题——它解决的是开发者长期头疼的三个痛点:

- 多账户管理:之前需要分别注册 OpenAI、Anthropic、Google、阿里等多个平台的账号

- 价格碎片化:每家模型的计价单位、阶梯定价、缓存策略都不一样

- Fallback 路由:某个模型挂了或限流,无法自动切换到备选模型

价格对比

WorldRouter 公布的定价(USD / 1M tokens):

| 模型 | 官方输入 → 输出 | WorldRouter 输入 → 输出 |

|---|---|---|

| Claude Opus 4.7 | $15 / $75 | $10.5 / $52.5 |

| Claude Sonnet 4.5 | $3 / $15 | $2.1 / $10.5 |

| GPT-5.5 | $10 / $50 | $7 / $35 |

| Gemini 2.5 Pro | $2.5 / $10 | $1.75 / $7 |

| Qwen 3-235B | $3 / $15 | $2.1 / $10.5 |

注意:官网标注「以发布时为准」,实际价格可能因市场波动调整。

技术架构

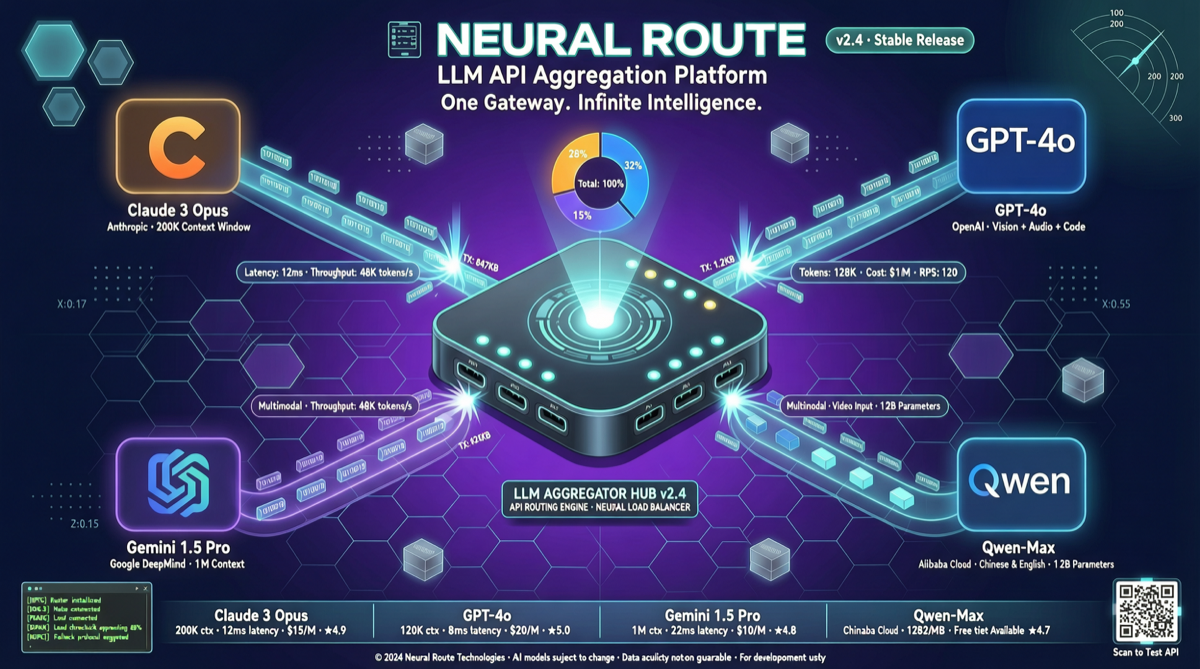

WorldRouter 的核心是一个 LLM 聚合路由层,工作流程如下:

开发者请求 → WorldRouter Gateway → 智能路由 → 目标模型 API

↓

fallback 队列(备选模型)

↓

统一响应格式返回关键能力:

- 智能路由:根据延迟、成本、可用性动态选择最优模型

- Fallback 机制:主模型限流或不可用时自动切换备选

- 统一认证:一个 API Key 搞定所有模型

- 统一计费:不用分别查各家账单

为什么能做到 30% 折扣?

官方价格是由模型供应商直接制定的,WorldRouter 能做到 30% 折扣,可能的机制:

- 批量采购:以企业级用量向各家 API 采购,获得批发价

- WLFI 生态补贴:作为 WLFI 生态的基础设施,部分成本由代币经济覆盖

- 缓存共享:跨用户共享 prompt cache,降低重复请求的实际成本

风险提示:第三方聚合服务的长期稳定性值得关注——如果上游供应商改变合作策略或调整 API 条款,价格优势可能缩水。

和同类产品的对比

| 维度 | WorldRouter | LiteLLM / OpenRouter | 直连官方 |

|---|---|---|---|

| 模型数量 | 300+ | 200+ | 单家 1-10 个 |

| 价格 | 官方 -30% | 接近官方价 | 官方定价 |

| 智能路由 | ✅ | 基础 | ❌ |

| 统一计费 | ✅ | ✅ | ❌ |

| 生态绑定 | WLFI | 独立 | 各家自有 |

对开发者的实际意义

适合场景:

- 需要同时测试多个模型的团队

- 预算敏感但需要前沿模型能力的初创公司

- 需要高可用 fallback 机制的生产环境

不适合场景:

- 对数据合规有严格要求的企业(请求经过第三方)

- 需要直接和模型供应商建立合作关系的场景

- 对延迟极度敏感的高频应用(多一层路由增加延迟)

结论

WorldRouter 代表了一个趋势:LLM API 市场正在从「分散零售」走向「聚合批发」。 当 300+ 模型可以通过一个接口调用、且价格统一更低时,开发者没有任何理由继续维护多个分散的 API 集成。

但聚合层本身也面临信任问题——毕竟你的所有请求都经过它。选择之前,值得评估数据合规和供应商稳定性。