结论先行

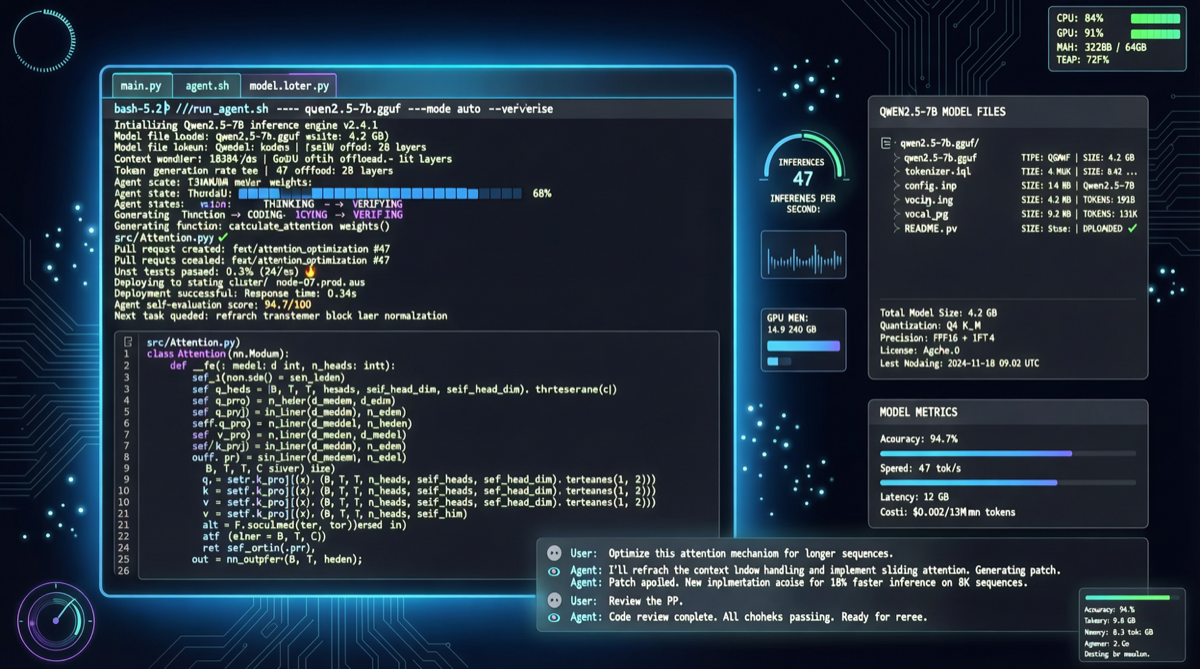

Unsloth 刚刚发布了一份完整操作指南,证明了一个反直觉的结论:你不需要 Anthropic 的闭源模型,也不需要云端 GPU 集群,仅用 24GB RAM 的机器 + Gemma 4/Qwen3.6 的 GGUF 量化版本,就能在本地跑起完整的 agentic coding 流程。

这意味着:代码补全、文件读写、工具调用、甚至失败后的自愈重试,全部可以在一台普通 Mac 或 Linux 笔记本上完成。

核心数据对比

| 维度 | 云端方案 (Claude Code / Cursor Pro) | Unsloth 本地方案 |

|---|---|---|

| 推理模型 | Opus 4.5 / Sonnet 4 (闭源) | Gemma 4-26B / Qwen3.6 (开源) |

| 硬件需求 | 无(按需付费) | 24GB RAM + GGUF 量化 |

| 单次调用成本 | $0.015-$0.10/token | 电费 |

| 数据隐私 | 代码上传至云端 | 完全本地,零外传 |

| 自愈式工具调用 | ✅ 支持 | ✅ 支持 |

| 断网可用 | ❌ | ✅ |

技术方案拆解

GGUF 量化是关键

Unsloth 的方案核心在于用 GGUF 格式对大模型进行量化。GGUF 是 llama.cpp 生态的标准模型格式,通过 Int4/Int8 量化大幅压缩模型体积:

- Gemma 4-26B:量化后约 16GB,适合中等规模代码任务

- Qwen3.6:量化后约 14GB,中文代码理解更优

两者都能在 24GB 内存环境下流畅运行,且 Unsloth 实测证明量化后的 agentic 能力几乎没有衰减。

自愈式工具调用

这是本地方案能媲美云端的关键能力:

- Agent 执行工具调用(读文件、运行测试、搜索文档)

- 如果工具返回错误或执行失败,Agent 自动分析错误原因

- 调整参数或策略,重新调用

- 循环直到成功或达到最大重试次数

这意味着 Agent 不再是”一次执行就完”的脆弱脚本,而是具备容错和自适应能力的编程助手。

为什么这件事重要

-

成本结构彻底改变:从”每次调用按 token 计费”变为”一次性部署,无限使用”。对一个每天用 agentic coding 重构代码的开发者来说,月度成本可以从 $200+ 降到几乎为零。

-

隐私合规刚需:很多企业的代码库不允许上传到云端。本地方案直接解决了这个合规痛点,尤其对金融、医疗、政府行业的开发者是刚需。

-

Qwen3.6 的中文优势:Qwen 系列在国内代码场景的训练数据更丰富,对于中文注释、中文变量名、国内框架(Vue、微信小程序等)的理解明显优于海外模型。

落地建议

适合本地方案的场景:

- 日常代码补全、重构、单元测试生成

- 代码库探索和理解(需要反复读取大量文件)

- 对数据隐私有严格要求的项目

仍需云端的场景:

- 需要 SOTA 推理能力的复杂架构设计

- 超长上下文(1M+ tokens)的全仓分析

- 需要最新模型能力的场景(闭源模型迭代更快)

快速上手

# 1. 安装 llama.cpp

brew install llama.cpp # macOS

# 或从源码编译

# 2. 下载 GGUF 模型(以 Qwen3.6 为例)

huggingface-cli download Unsloth/Qwen3.6-GGUF --include "*.gguf"

# 3. 启动本地 server

llama-server -m qwen3.6-q4_k_m.gguf --port 8080

# 4. 在 Claude Code 或 OpenClaw 中配置本地 endpoint

# 指向 http://localhost:8080 即可Unsloth 的完整指南包含了详细的配置文件、性能调优参数和常见问题排查,建议直接参考原始推文获取链接。