核心结论

AI 基础设施赛道出现了一个清晰的岔路口:面对超长上下文需求,行业正在分裂为两种截然不同的技术路线。

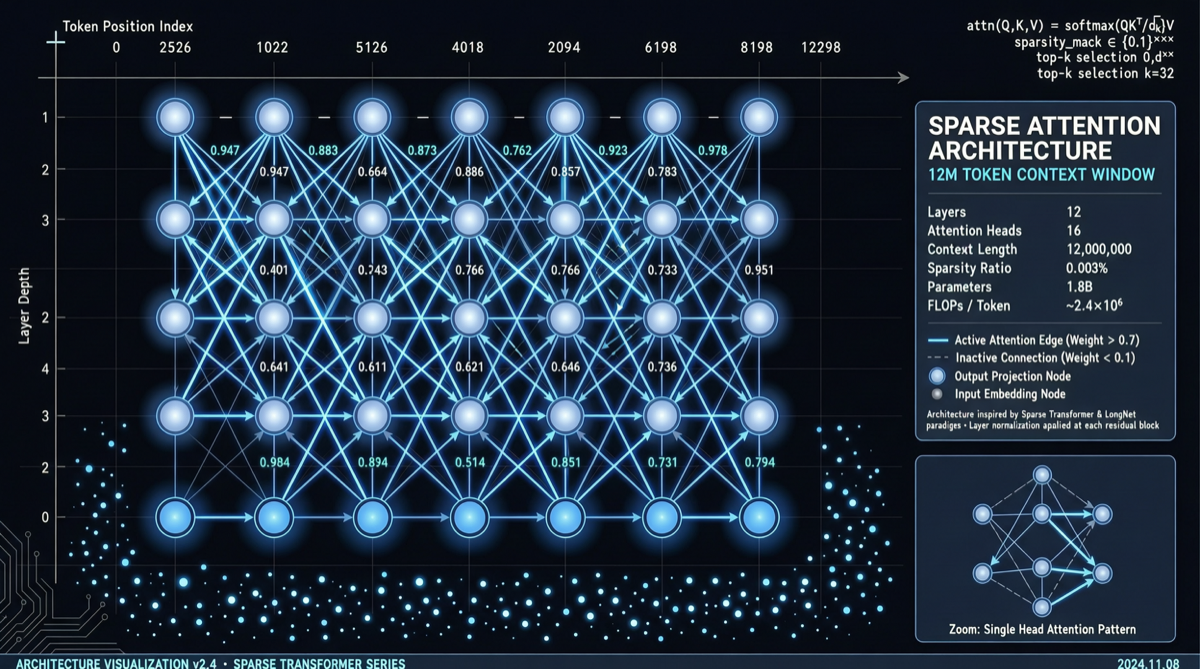

路线一(垂直整合):SubQ 拿 $2900 万,从底层重新训练一个支持 1200 万 token 上下文的模型。

- 风险大、回报大——如果成功,性能和效率都可控

- 但需要大量算力和数据,且只能服务自家模型

路线二(水平嵌入):evermind 的 MSA(Multi-Scale Attention)方案,给主流模型加记忆层。

- 谁的模型都能用,无需重新训练

- 但依赖宿主模型本身的注意力机制兼容性

社区讨论一针见血:「2900 万美金做 12M context,侧面证明整个行业都开始相信稀疏注意力是 dense attention 的解药。」

为什么是稀疏注意力?

要理解这个争论,得先回到问题本身:

传统 Transformer 的 dense attention 机制在长上下文场景下面临两个硬约束:

- 计算复杂度 O(n²)——上下文翻倍,计算量翻四倍

- KV Cache 显存爆炸——12M token 的 KV Cache 需要数百 GB 显存

密集注意力在 128K 以下工作良好,但超过百万 token 后,成本和延迟都不可接受。

稀疏注意力的核心思路是:不是所有 token 对所有 token 都重要。 通过有选择地计算注意力,可以在保持精度的同时把复杂度降到接近 O(n)。

两条路线拆解

SubQ:重训一个模型

SubQ 选择了最激进的路——从零开始训练一个原生支持 1200 万 token 上下文的模型。

- 优势:注意力机制可以针对长上下文做端到端优化,无需向后兼容

- 劣势:$2900 万在模型训练领域不算多,容错空间极小

- 风险:如果训练过程中发现架构有问题,沉没成本巨大

值得注意的是,SubQ 的 API 与其产品深度绑定,走的是「模型即服务」路线。

evermind MSA:给主流模型加记忆

evermind 的 Multi-Scale Attention 选择了另一条路——不碰模型权重,而是在推理时外挂一个记忆层。

- 优势:兼容 Claude、GPT、Gemini 等主流模型,客户无需切换模型供应商

- 劣势:性能上限受宿主模型限制,本质上是「打补丁」方案

- 风险:如果主流模型自己加了长上下文能力,MSA 的差异化价值会被削弱

行业信号

这笔融资透露了几个值得关注的信号:

- 稀疏注意力正在从学术概念变成商业赛道——投资人愿意为「注意力机制创新」买单,而不仅仅是「更大的模型」

- 12M 上下文正在成为新的标杆——在此之前,1M token(Claude)、2M token(Gemini)是公开的上限,12M 是一个数量级跃升

- 路线之争还没有赢家——这和当年卷积 vs Transformer 的故事很像,早期多路线并行是健康的

对开发者的影响

| 需求场景 | 推荐路线 | 理由 |

|---|---|---|

| 需要极致长上下文性能 | SubQ(如果训练成功) | 原生稀疏注意力,端到端优化 |

| 想用现有模型 + 长记忆 | evermind MSA | 无需切换模型,即插即用 |

| 成本敏感 | 观望 | 两条路线都在早期,价格尚未透明 |

结论

$2900 万不是大数目,但它标志着AI 基础设施的竞争维度正在下移——从「谁的模型参数更大」转向「谁的注意力机制更聪明」。

稀疏注意力是否真的是 dense attention 的终极解药?答案可能不在今天,但这场融资至少说明:有人愿意用真金白银去赌。