核心结论

4 月 28 日,研究团队开源了 Skill Retrieval Augmentation(SRA) 框架及配套的 SRA-Bench 基准测试。这是一个专门解决”Agent 面对新任务时不知道该用什么技能”问题的技术方案。

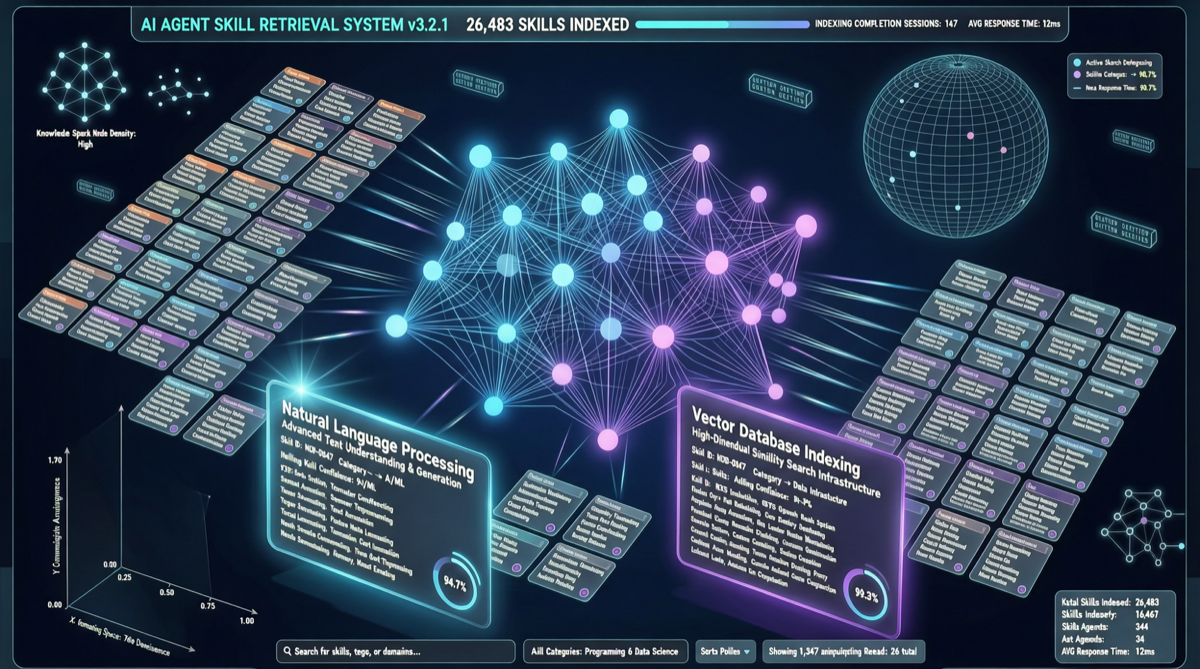

SRA 的核心贡献在于构建了一个包含 26,262 个技能、636 个黄金技能、5,400 个测试任务 的大规模基准,并证明通过高效的技能检索增强,Agent 在新任务上的成功率可以显著提升。

这不是又一个 Agent 框架——它是Agent 框架的”搜索引擎”。

痛点:Agent 的技能膨胀与检索失效

现有 Agent 框架(包括 Claude 的 Skills、OpenClaw 的 MyClaw、Hermes 的 Curator)都解决了一个问题:技能太多,Agent 不知道用哪个。

典型场景:

- 你的 Agent 技能库里有 300+ 个技能文件

- 用户说”帮我分析这份财报”

- Agent 需要决定:是用”数据提取”技能、“财务分析”技能、还是”图表生成”技能?

- 当前方案大多是简单的关键词匹配或 prompt 列举——技能超过 50 个后效果急剧下降

SRA 把这个过程形式化为一个检索增强生成(RAG)问题,但检索对象不是文档,而是技能。

SRA 的技术方案

架构概览

用户请求 → SRA 编码器 → 技能索引检索 → Top-K 技能 → Agent 执行| 组件 | 作用 | 类比 |

|---|---|---|

| SRA 编码器 | 将用户请求编码为技能空间的向量 | 翻译器——把自然语言翻译成”技能需求” |

| 技能索引 | 26,262 个技能的向量化存储 | 图书馆的卡片目录 |

| 检索器 | 从索引中找出最相关的 Top-K 技能 | 图书管理员 |

| 增强器 | 将检索到的技能注入 Agent 的上下文 | 把找到的书递给读者 |

SRA-Bench 基准

| 指标 | 数值 |

|---|---|

| 总技能数 | 26,262 |

| 黄金技能数 | 636 |

| 测试任务数 | 5,400 |

| 技能来源 | 社区贡献 + 自动合成 |

| 评估维度 | 检索准确率、任务完成率、推理延迟 |

与现有方案的对比

| 方案 | 检索方式 | 技能规模上限 | 检索延迟 |

|---|---|---|---|

| Prompt 列举 | 全文匹配 | ~50 个 | 随技能数线性增长 |

| Claude Skills | 文件名匹配 + LLM 排序 | ~200 个 | 中等 |

| OpenClaw MyClaw | 偏好设置预筛选 | ~13,700 个(但需要手动分类) | 低 |

| SRA | 向量检索 + 语义匹配 | 26,000+ | 毫秒级 |

为什么重要

1. Agent 框架的”基础设施层”

SRA 不是要替代 Claude Skills 或 OpenClaw——它是可以嵌入任何 Agent 框架的检索层。就像向量数据库之于 RAG 应用,SRA 之于 Agent 框架。

2. 规模效应

26,000+ 技能的基准意味着 SRA 在大规模技能库场景下经过了验证。OpenClaw 的 13,700+ SKills 库如果接入 SRA 的检索能力,用户找技能的效率会有质的提升。

3. 开源社区效应

SRA-Bench 的开放性意味着任何团队都可以提交新技能、新任务来扩展基准。这可能导致 SRA 成为 Agent 技能检索的事实标准——类似于 GLUE 之于 NLP 模型评测。

可以怎么用

快速上手

如果你正在构建自己的 Agent 系统:

- 克隆 SRA 仓库,加载预训练的技能编码器

- 将你现有的技能文件(无论是 Claude Skills、OpenClaw Skills 还是自定义格式)批量编码为向量

- 接入 FAISS 或 Milvus 等向量数据库

- 在 Agent 的规划层之前插入 SRA 检索步骤

与现有框架集成

- Claude Code: 在

.claude/技能目录前加一层 SRA 检索 - OpenClaw: 替换 MyClaw 的偏好预筛选为 SRA 语义检索

- Hermes Agent: 在 Curator 自动治理的基础上,用 SRA 做运行时检索

局限与未解问题

- SRA 目前主要针对离散技能(函数/脚本级别),对于连续技能(如多步骤工作流的组合)检索效果待验证

- 基准中的 636 个黄金技能来自人工标注,在更开放的社区贡献场景下,技能质量参差不齐可能影响检索效果

- 编码器的训练数据覆盖了主流任务类型,但垂直行业(医疗、法律、金融)的技能覆盖度可能不足

主要来源:

- Twitter @ai_research 介绍

- SRA 论文与技术报告