结论先行

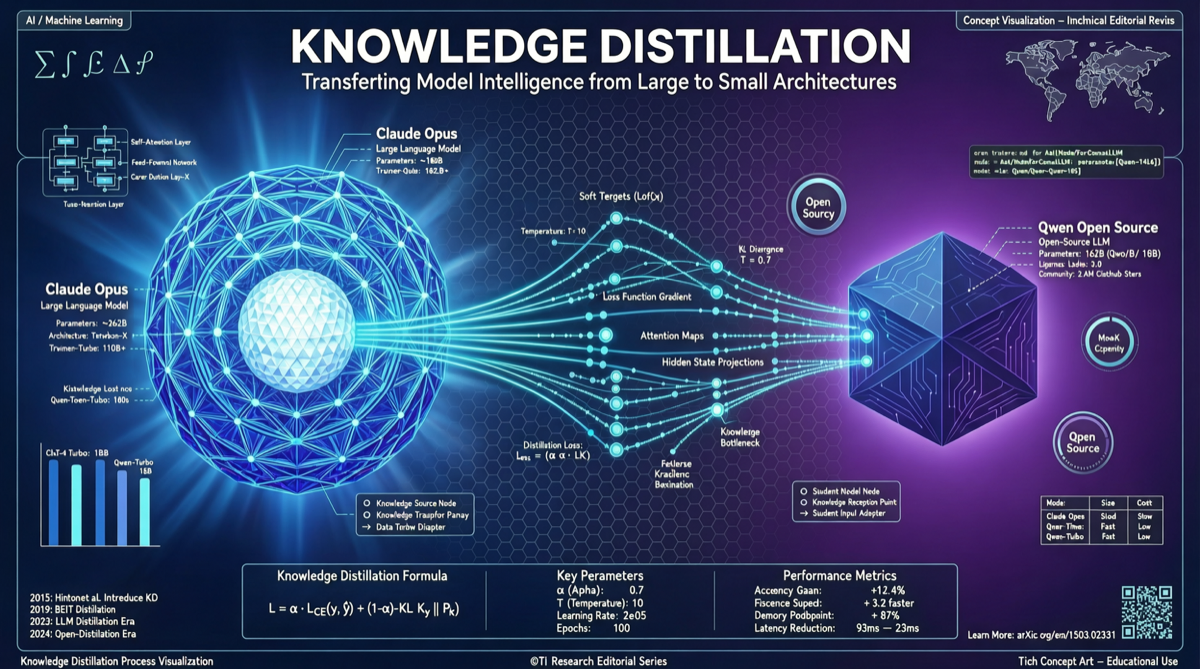

HuggingFace 社区开发者 Jackrong 发布了 Qwen3.6 35B A3B 蒸馏版,使用 Claude Opus 的推理输出进行知识蒸馏。模型文件大小 71.9GB,GGUF 量化版本即将推出。

这意味着什么:社区正在用闭源旗舰模型的推理数据”喂”给开源模型,让开源模型在推理能力上逼近闭源旗舰。这种”蒸馏蒸馏再蒸馏”的模式正在成为开源社区追赶闭源模型的核心路径。

技术方案拆解

基础架构

| 维度 | 信息 |

|---|---|

| 基础模型 | Qwen3.6 35B A3B(MoE 架构) |

| 蒸馏来源 | Claude Opus 推理输出 |

| 模型大小 | 71.9GB(FP16) |

| 发布者 | Jackrong(HF 社区知名蒸馏模型作者) |

| 平台 | HuggingFace |

| 量化版本 | GGUF 即将发布 |

为什么选 Qwen3.6 35B A3B?

Qwen3.6 35B A3B 是一个 MoE(Mixture of Experts) 架构模型,特点是:

- 总参数量:35B

- 激活参数量:约 3B(A3B = Active 3 Billion)

- 推理效率高:实际运行时只激活 3B 参数,速度接近小模型

- 知识容量大:35B 总参数量意味着存储了大量知识

用 Claude Opus 的推理数据蒸馏到这个架构上,相当于让一个”跑得快的底盘”装上了”旗舰级的引擎”。

蒸馏方法论

Claude Opus 推理数据(教师)

↓

生成高质量推理链

↓

Qwen3.6 35B A3B(学生)

↓

学习推理模式 + 知识迁移

↓

蒸馏后的开源模型这种蒸馏方式的核心优势:

- 不泄露 Claude 权重:只蒸馏输出,不涉及模型内部参数

- 推理能力可迁移:Claude Opus 的链式推理、规划、反思能力可以通过蒸馏传递

- 成本效益高:用一次性的推理数据换取永久可用的开源模型

对比分析

| 维度 | 原版 Qwen3.6 35B | 蒸馏版(Opus 数据) | Claude Opus 4.6 |

|---|---|---|---|

| 参数规模 | 35B (激活3B) | 35B (激活3B) | 闭源,估计数百亿B |

| 推理能力 | Qwen 原生 | 融合 Opus 推理模式 | 旗舰级 |

| 推理速度 | 快(3B激活) | 快(3B激活) | 取决于 API |

| 开源 | ✅ | ✅ | ❌ |

| 本地部署 | ✅ | ✅ | ❌ |

| 成本 | 免费 | 免费 | 按 token 计费 |

上手指南

硬件需求

| 配置 | 推荐方案 |

|---|---|

| 最低 | 24GB VRAM(需要 GGUF Q4 量化) |

| 推荐 | 48GB VRAM(GGUF Q8 或 FP16 部分层) |

| 理想 | 80GB VRAM(A100/H100,FP16 全精度) |

| Mac | 96GB+ 统一内存(M2/M3 Max) |

预期用途

- 本地推理增强:在消费级硬件上获得接近 Opus 水平的推理能力

- Agent 基础模型:作为自主 Agent 的核心推理引擎

- 二次蒸馏基础:可以进一步蒸馏到更小模型(如 7B、14B)

- 微调基础:在蒸馏基础上针对特定领域做 SFT

格局判断

这个蒸馏模型代表了一个明确的趋势:开源社区正在通过”蒸馏闭源旗舰输出”的方式快速缩小能力差距。

Jackrong 之前已经做过多个成功的蒸馏项目,这次选择 Qwen3.6 35B A3B 作为底座,说明这个 MoE 架构在社区的认可度正在快速上升。对于需要在本地部署强推理能力的场景,这是一个值得关注的选项。