核心结论

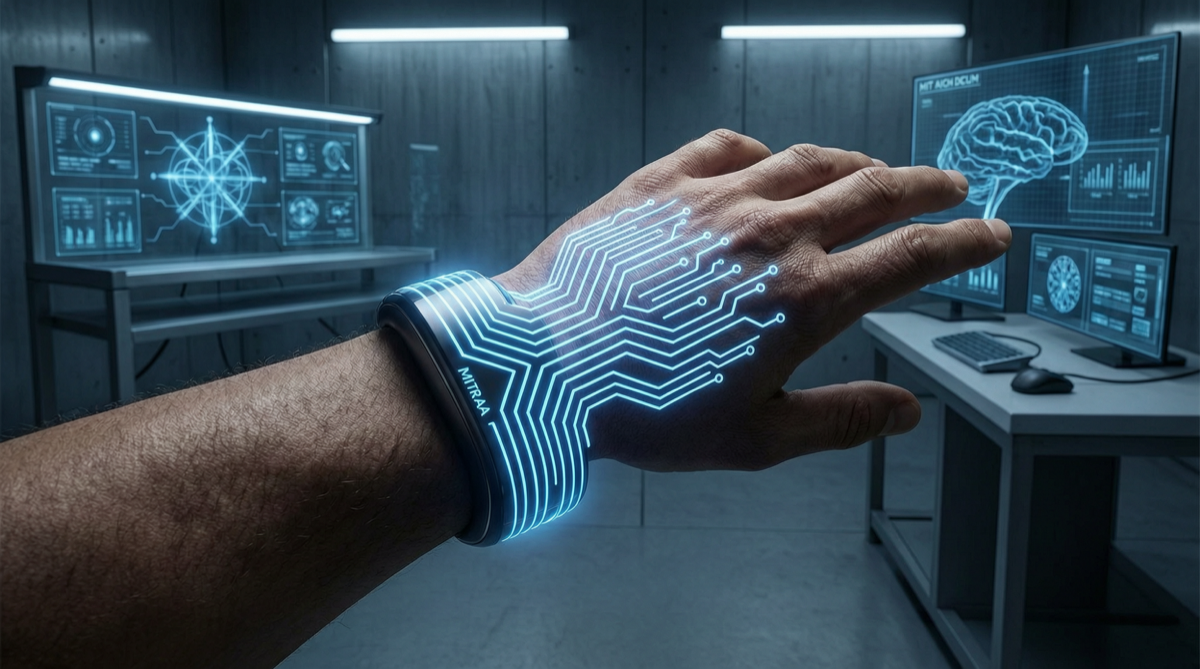

2026 年 5 月初,在 MIT Hard Mode 2026 黑客松上,一支 6 人团队赢得了”Learn Track”赛道冠军。他们的作品 Human Operator 是一个可穿戴 AI 系统,能够实时控制人类的手部和腕部运动——通过摄像头观察环境、AI 推理出身体应该做的动作、然后用电脉冲引导肌肉执行。

这不是远程控制机器人,而是直接引导人体。

技术拆解

系统架构

┌─────────────┐ ┌─────────────┐ ┌─────────────────┐ ┌──────────┐

│ 摄像头输入 │ → │ AI 视觉理解 │ → │ 运动推理引擎 │ → │ 神经肌肉 │

│ (你看到的) │ │ (环境分析) │ │ (你该做什么) │ │ 电脉冲 │

└─────────────┘ └─────────────┘ └─────────────────┘ └──────────┘| 组件 | 功能 | 技术栈 |

|---|---|---|

| 视觉采集 | 实时捕捉用户视角环境 | 可穿戴摄像头 |

| AI 推理 | 理解场景、识别目标、规划动作 | 大视觉模型 + 运动规划 |

| 运动引导 | 将动作指令转化为肌肉刺激信号 | 神经肌肉电刺激 (NMES) |

| 执行反馈 | 传感器检测实际运动完成度 | 惯性测量单元 (IMU) |

关键技术点

-

视觉到运动的映射:AI 需要理解”用户在什么环境中”以及”用户应该做什么动作”。比如看到螺丝,AI 推断出”需要握持螺丝刀并旋转”。

-

精确的肌肉控制:通过电脉冲引导特定肌肉群收缩,实现手部精细动作。这需要精确的时序控制——不同肌肉的激活顺序和强度必须匹配目标动作。

-

实时闭环:从看到到引导到完成,整个循环必须在毫秒级完成,否则用户体验会严重延迟。

为什么这件事重要

”下载物理技能”的第一步

这个系统证明了:物理技能可以像软件一样被编码和传输。

- 一个经验丰富的外科医生的操作可以被录制为 AI 训练数据

- 一个新手可以通过穿戴系统”下载”这些技能,AI 引导他的手完成精确操作

- 未来可能实现:观看一段教学视频后,你的肌肉就能自动执行其中的动作

应用场景

| 场景 | 价值 |

|---|---|

| 医疗培训 | 实习医生可以在 AI 引导下练习手术动作,降低培训风险 |

| 工业操作 | 新工人快速掌握精密装配技能 |

| 康复治疗 | 中风患者通过 AI 引导恢复手部运动功能 |

| 体育训练 | 运动员精确复现标准动作 |

与 AI Agent 的关联

这个系统本质上是一个具身 AI Agent(Embodied AI Agent)。它不仅能”思考”,还能通过物理接口直接”执行”。这与当前的 AI Agent 框架(如 Hermes Agent、OpenClaw)形成了互补:

- 软件 Agent:在数字世界中自主执行任务

- 具身 Agent:在物理世界中引导人类执行任务

局限性与争议

| 问题 | 描述 |

|---|---|

| 安全性 | 电脉冲的强度和频率必须严格控制,避免肌肉损伤 |

| 伦理 | ”控制人体运动”的边界在哪里?是否会被滥用? |

| 泛化性 | 目前仅限于手部和腕部,全身运动引导需要更复杂的系统 |

| 个体差异 | 不同人的肌肉电生理特征不同,需要个性化校准 |

格局判断

MIT 团队用 48 小时就做出了这个系统,说明基础技术组件已经成熟——摄像头、AI 视觉模型、神经肌肉电刺激都是现有技术。真正的创新在于把这些组件组合成了一个闭环系统。

这意味着类似产品可能在 1-2 年内从实验室走向消费级市场。

行动建议

- 医疗/康复从业者:关注此类技术的发展,可能在 2-3 年内出现商用产品

- AI 研究者:具身 AI 是下一个热点,视觉-运动映射是核心技术

- 普通用户:短期内可以关注基于纯软件的运动指导应用(如 AI 健身教练),作为可穿戴系统的替代方案