交易数据

Meta 于 2026 年 4 月 29 日发布 Q1 财报:

| 指标 | Q1 2026 实际值 | 市场预期 | 变化 |

|---|---|---|---|

| 营收 | 563 亿美元 | 595.6 亿美元 | 低于预期 |

| Q2 营收指引 | 580-610 亿美元 | 595.6 亿美元 | 符合预期 |

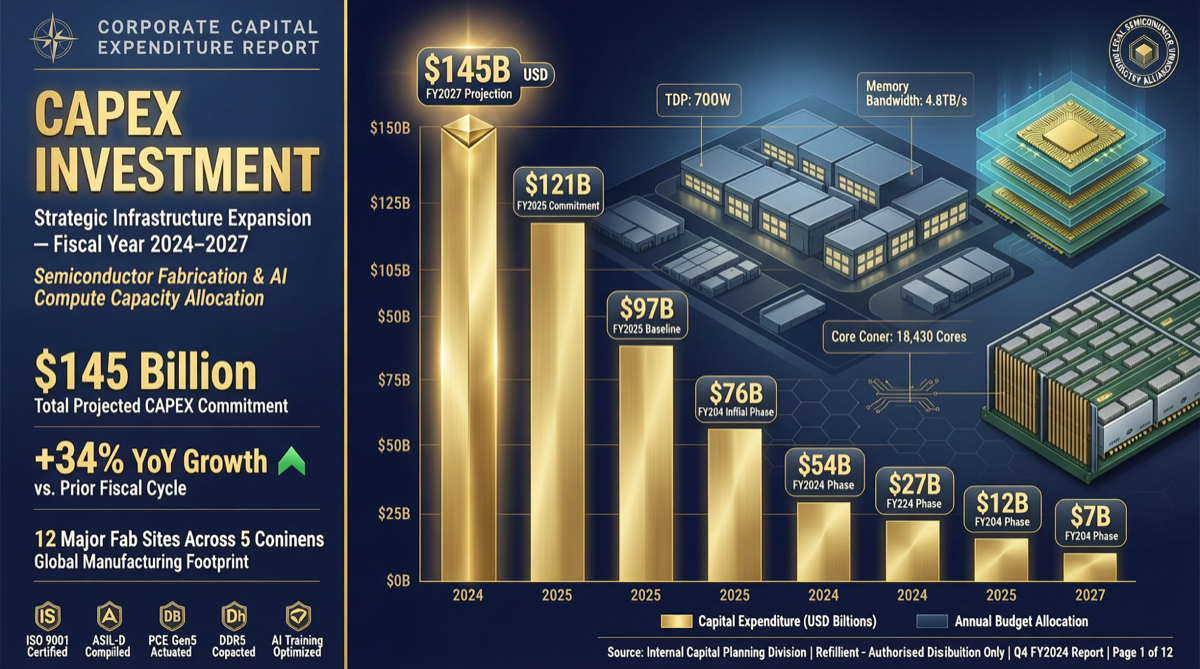

| 全年 CAPEX | 1250-1450 亿美元 | 1150-1350 亿美元 | 显著上调 |

| CAPEX 增量 | +100-150 亿美元 | — | 约上调 10-12% |

扎克伯格在财报电话会上表示:

“其中大部分是由于组件成本上升,尤其是内存价格。”

这不是“我们计划多花钱”,而是“我们不得不多花钱”。

业务背景

Meta 当前的 AI 战略围绕三个核心展开:

- Avocado 模型:下一代基础模型,因表现未达预期从 3 月推迟到 5 月

- Llama 生态:继续推进开源策略,已发布 Llama 4 Scout(MoE 架构,1000 万上下文)

- AI 基础设施:大规模 GPU 集群投资,支撑推荐系统、广告和 Meta AI 助手

投资逻辑:内存正在成为 AI 竞赛瓶颈

HBM(高带宽内存)是当前 AI 芯片的核心组件。2026 年的供需格局如下:

| 因素 | 影响 |

|---|---|

| 需求爆发 | 大厂全面扩建 AI 集群,HBM 需求同比增长 200%+ |

| 产能有限 | HBM 产线建设需要 18-24 个月 |

| 技术升级 | HBM4 正在放量,良率爬坡阶段成本很高 |

| 定价权 | 卖方市场,供应商拥有很强定价权 |

对行业的影响

1. 内存供应商的“黄金时代”

三星、SK Hynix 和美光在 HBM 市场获得了前所未有的定价权。

2. 模型效率变得更重要

当内存成本成为主要变量时,模型设计哲学必须改变:

- MoE 架构更有优势,因为并非每次都需要把所有参数加载进内存

- 量化和压缩技术需求会继续上升

- 小模型 + Agent 编排可能比单一超大模型更经济

3. 竞争格局出现微妙变化

Meta 上调 CAPEX 说明:AI 竞赛没有放缓,反而还在加速。

但 Avocado 的延期也说明:花更多钱不等于更快拿到结果。AI 基础设施投资正在面临明显的边际收益递减。

可执行建议

| 角色 | 建议 |

|---|---|

| AI 创业公司 | 考虑量化模型或 MoE 架构,评估云厂商预留实例 |

| 企业 IT | 在 AI 预算中单独列出内存和存储成本 |

| 投资者 | 关注 HBM 供应链,包括三星、SK Hynix、美光 |

| 开发者 | 学习模型量化、LoRA 微调,降低内存占用 |

格局判断

Meta 上调 CAPEX 告诉我们:

- AI 军备竞赛没有放缓:即便营收略低于预期,Meta 仍然增加投入

- 瓶颈正在转移:从“算力不够”转向“内存太贵”,这是结构性变化

- 效率就是竞争力:谁能用更少内存做更多事,谁就有优势

- 开源可能成为差异化优势:Llama 生态在内存效率上领先,会吸引成本敏感用户