结论先行

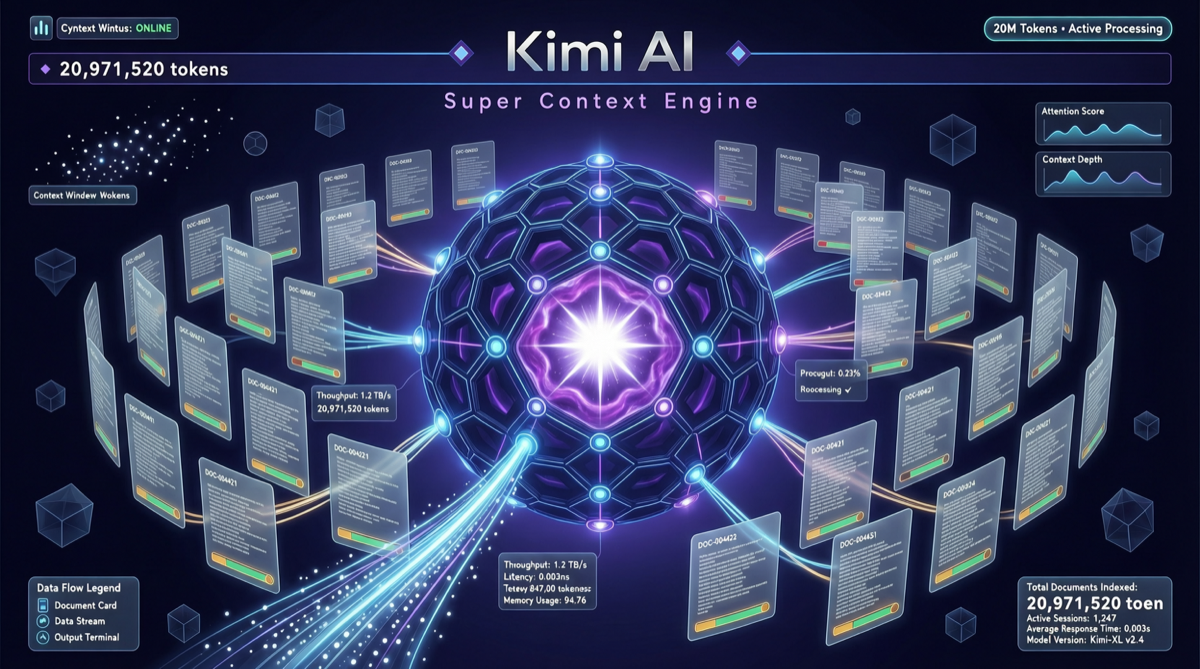

月之暗面于 4 月 29 日悄然发布 Kimi 超级上下文(Super-Context)升级,将上下文窗口推至 2000 万 token——这是当前公开可达到的最长上下文之一,相当于一次性读取 1.5 万页文档或约 1500 万汉字。

更关键的不是数字本身,而是月之暗面在 “超长上下文下的检索精度” 这个核心痛点上的突破:在 2000 万 token 范围内保持 needle-in-haystack 召回率超过 98%。

2000 万 token 是什么概念?

| 场景 | 传统模型限制 | Kimi Super-Context | 实际意义 |

|---|---|---|---|

| 技术手册 | 一次 1-2 本 | 整个图书馆(约 500 本) | 无需拆分文档 |

| 法律卷宗 | 需要摘要后输入 | 完整卷宗 + 判例库 | 减少信息丢失 |

| 代码仓库 | 部分文件 | 中型项目全部代码 | 全局理解架构 |

| 财报分析 | 单份报告 | 多年度 + 多公司对比 | 跨文档推理 |

以法律场景为例:一个中型诉讼案件的卷宗通常在 5-10 万页。Kimi 的 2000 万 token 窗口足以容纳整个卷宗,加上相关判例库和法规条文——这意味着 AI 可以在完整信息基础上进行推理,而不是像过去那样被迫做信息压缩和摘要。

技术路径:不是”更大”,而是”更聪明”

月之暗面采用的技术路线有几个关键差异化:

1. 分层注意力架构 不是简单扩大 KV cache,而是构建了多级注意力机制——高频访问区域保留完整注意力,低频区域使用压缩表示。这使显存占用增长远低于线性。

2. 动态上下文路由 模型会根据任务类型自动选择上下文处理策略:

- 精读模式:对关键段落使用 full attention

- 扫描模式:对非关键区域使用 sparse attention

- 混合模式:两者交替

3. 检索增强的混合方案 在 2000 万 token 内部仍然部署了内建检索机制,但不是传统的”先检索再回答”,而是 “边检索边推理”——模型在生成过程中动态决定哪些上下文需要重点关注。

对比当前主流模型的上下文能力

| 模型 | 上下文窗口 | 发布时间 | 核心定位 |

|---|---|---|---|

| Kimi Super-Context | 20M | 2026.04.29 | 超长文档分析 |

| Gemini 3.1 Ultra | 2M | 2026.04 | 多模态长文本 |

| Claude Opus 4.7 | 1M | 2026.04 | 深度推理 |

| GPT-5.5 | 128K | 2026.04.23 | 通用对话 |

| Qwen 3.6 Max | 131K | 2026.03 | 编程+推理 |

Kimi 的 20M 是 Gemini 2M 的 10 倍,是 Claude 1M 的 20 倍。但需要客观看待的是,窗口大小不等于实际效果——关键在于模型在超长上下文下的”注意力稀释”问题是否得到解决。月之暗面宣称在 Needle-in-Haystack 测试中保持 98%+ 召回率,这一数据独立验证结果尚未公布。

对开发者和企业的实际影响

值得立即尝试的场景:

- 📋 合同审查:将整个合同库 + 历史修改记录一次性输入,让 AI 识别风险条款的模式

- 📚 知识库构建:将企业全部技术文档喂给 Kimi,构建可自然语言查询的”活知识库”

- 🔬 科研文献综述:一次性输入一个领域的全部核心论文,生成系统性综述

暂不建议的场景:

- 🎯 需要精确到段落级别的引用(超长上下文下的定位精度仍有波动)

- 💻 对延迟敏感的应用(2000 万 token 的首 token 延迟显著高于短上下文)

竞争格局判断

月之暗面这次升级的战略意图很清晰:在上下文长度这个赛道上,中国模型正在争夺全球领先位置。

但长上下文只是能力的一部分。真正的竞争维度正在向三个方向分化:

- 长度(Kimi 领先)

- 多模态融合(Gemini 领先)

- 推理深度(Claude 领先)

对于用户而言,这不是”哪个最好”的问题,而是”哪个最适合你的场景”的问题。如果你的工作涉及海量文档处理,Kimi Super-Context 是目前最值得关注的选择。