核心结论

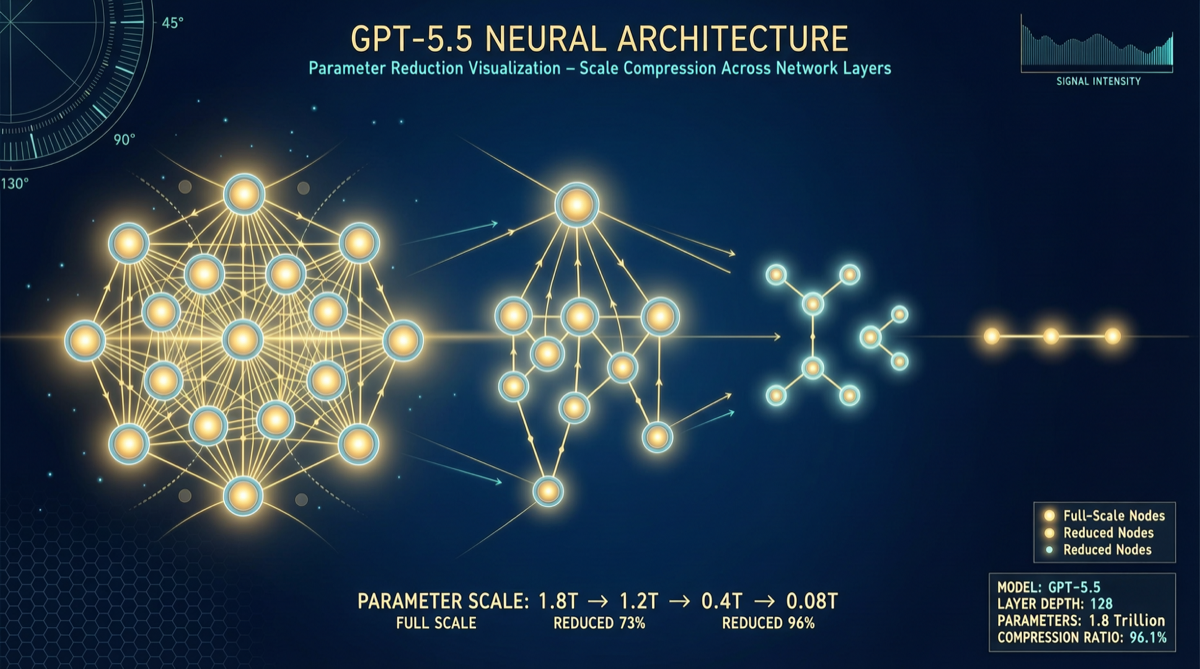

GPT-5.5 的参数量被研究人员重新测算为约 1.5 万亿,远低于此前广泛引用的 9.7 万亿估值——这意味着此前估算存在 6.5 倍的偏差。

这不是一个数字游戏。如果 1.5T 的模型能够在各项基准测试中击败更大规模的竞品,那说明 OpenAI 在模型架构效率上实现了质的飞跃。更少的参数 = 更低的训练成本 + 更快的推理速度 + 更小的部署开销。

数据对比:估算是如何翻车的

| 版本 | 原始估算 | 重新测算 | 误差倍数 |

|---|---|---|---|

| GPT-5.5 | 9.7T | 1.5T | 6.5× |

参数量估算一直是社区的热议话题,因为 OpenAI 从未官方披露具体数字。此前的 9.7T 估算基于对模型行为的外推——当模型展现出某种能力时,社区倾向于认为”这需要这么多参数才能达到”。

但重新测算采用了更精确的方法:通过分析推理时的显存占用、激活模式和计算图结构,反向推导出真实参数规模。

为什么这很重要

1. 训练效率的飞跃

如果 1.5T 的模型能打出此前认为需要 10T 才能达到的性能,意味着:

- 训练成本大幅下降:参数量减少 6.5 倍,理论上训练算力需求也呈比例降低

- 迭代速度加快:更小的模型意味着更快的训练周期,解释了为什么 OpenAI 能维持月更节奏

- 推理成本降低:部署时的 GPU 需求和能耗同步下降

2. 架构创新的可能性

参数量不是决定模型能力的唯一因素。以下技术路线可以在不增加参数的前提下提升性能:

| 技术方向 | 说明 | 可能的贡献 |

|---|---|---|

| MoE 架构优化 | 更高效的专家选择和路由 | 激活参数不变但总参减少 |

| 注意力机制改进 | 更有效的信息利用 | 同等参数下更强表征能力 |

| 训练数据质量 | 数据过滤和课程学习 | 数据效率提升 |

| 推理时扩展 | Test-time compute 增加 | 运行时动态扩展计算 |

3. 行业格局影响

如果 OpenAI 确实在模型效率上领先,这将对整个行业产生连锁反应:

- Anthropic:Claude 系列以参数量大著称(Opus 系列被认为超过 10T),如果 GPT 以更少参数实现可比性能,Anthropic 的成本压力会增大

- 开源社区:Qwen、Llama 等开源模型的竞争逻辑是”用公开参数对抗闭源黑盒”。如果黑盒的效率远超预期,开源模型的追赶难度加大

- 硬件厂商:更小的模型意味着对 GPU 显存需求的降低,可能影响 Nvidia 的数据中心 GPU 销售策略

同期发布节奏:月更已成常态

从 2025 年 12 月到 2026 年 4 月,OpenAI 和 Anthropic 的模型发布频率已压缩至约一个月一次:

| 厂商 | 2025.12-2026.04 发布 |

|---|---|

| OpenAI | GPT-5.2 → 5.3 Codex → 5.4 → 5.5 |

| Anthropic | Opus 4.5 → 4.6 → Sonnet 4.6 → Mythos → Opus 4.7 |

如果 GPT-5.5 确实只有 1.5T 参数,那么这种月更节奏在工程和财务上就变得更加可持续。

行动建议

- 开发者:关注 GPT-5.5 在 Codex 和 API 中的实际表现——如果推理延迟和成本确实显著降低,可以调整应用的模型选择策略。

- 企业决策者:参数量不是采购模型的唯一标准。如果 GPT-5.5 以 1.5T 实现竞品 9T+ 的性能,其性价比值得重新评估。

- 研究者:参数量估算的方法论值得深入学习——如何在不访问模型权重的情况下准确推断架构规模,这是一个有趣的技术课题。

- 保持谨慎:目前重估数据来自社区研究,尚未得到 OpenAI 官方确认。最终数字可能仍有出入。