不开发布会,直接发论文

DeepSeek 的行事风格一如既往:没有营销通稿,没有发布会直播,一篇论文 quietly 出现在 arXiv 上,然后整个 AI 社区开始疯狂转发。

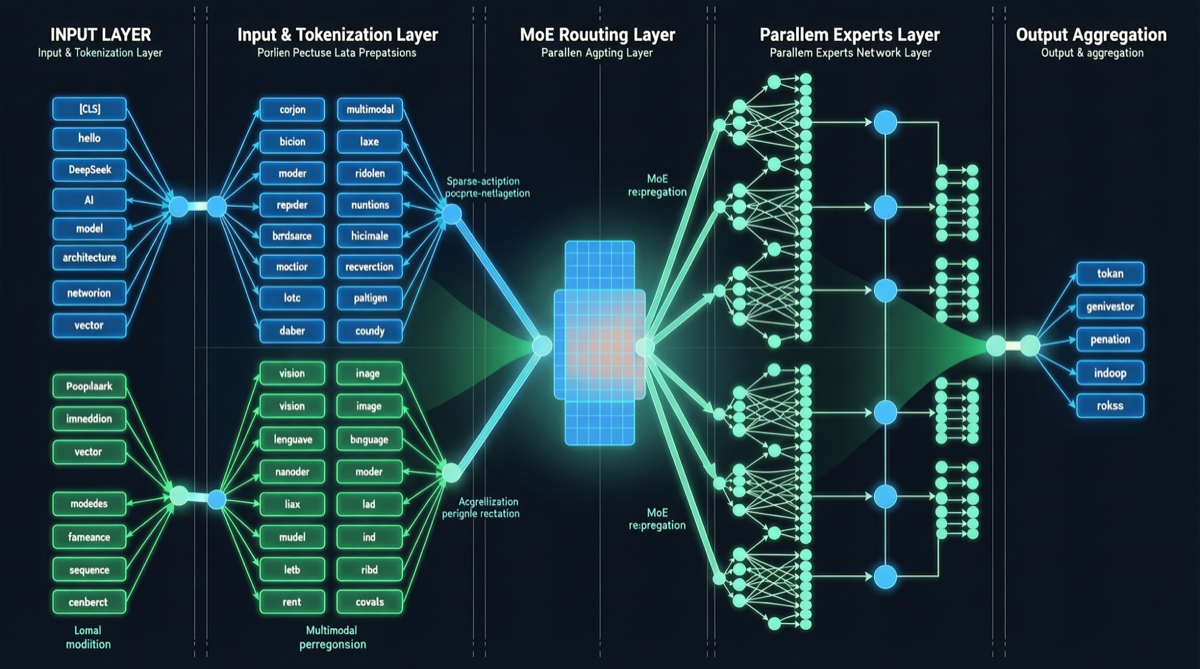

这篇《Thinking with Visual Primitives》讲的是 DeepSeek 多模态大语言模型的完整技术架构。它不是那种”我们把 XX 模型接了个视觉编码器”的简单拼装,而是一套从视觉表征到语言推理的端到端设计方案。

架构拆解

底座:DeepSeek-V4-Flash

模型的基础是 DeepSeek-V4-Flash,一个 MoE(Mixture of Experts)架构的语言模型:

- 总参数量:284B

- 激活参数量:13B

- 推理效率:得益于 MoE 设计,推理时仅激活约 4.6% 的总参数

这意味着在保持大模型能力的同时,推理成本被压到了一个相当可观的水平。对于需要处理多模态输入的场景,这种效率优势更加明显——视觉编码的开销可以被语言端的稀疏计算部分抵消。

视觉编码器:DeepSeek-ViT

这才是论文真正的看点。DeepSeek 没有直接拿现成的 CLIP 或 SigLIP 来用,而是自研了 DeepSeek-ViT:

- Patch 策略:14×14 的标准 patch 大小,与 ViT-Large 保持一致

- 空间压缩:视觉编码器输出后接 3×3 空间压缩层,将序列长度缩减为原来的 1/9

- 接入方式:压缩后的视觉 token 直接接入 LLM 的输入序列

空间压缩这一步是关键。未经压缩的高分辨率视觉输入会生成数千个 token,对上下文窗口和注意力计算都是巨大负担。3×3 压缩把视觉 token 数量压到了合理范围,同时保留了足够的空间信息。

“Thinking with Visual Primitives” 的核心理念

论文标题中的 “Visual Primitives” 不是噱头。核心思想是让模型在视觉表征层面进行”思考”,而不是简单地把图片编码成一串特征向量然后丢给语言模型。

具体来说:

- 视觉表征分层:模型在不同层次上理解视觉信息——从低级边缘纹理到高级语义概念

- 跨模态对齐:视觉 primitive 与语言概念在表示空间中对齐,使得模型可以用”语言的方式”操作”视觉的内容”

- 推理链集成:视觉信息参与到模型的 chain-of-thought 推理过程中,而非仅在初始编码阶段发挥作用

这种设计让模型在处理视觉问答、图表理解、复杂场景推理等任务时,不仅仅是”看到图片然后回答”,而是能够像人类一样”边看边想”。

为什么值得关注

DeepSeek 在多模态路线上做出了一些与主流不同的选择:

不依赖外部视觉模型。大多数多模态 LLM 直接复用 CLIP/SigLIP 等预训练视觉编码器,DeepSeek 选择自研 ViT。这意味着视觉表征与语言模型之间的适配可以更紧密,但也意味着更高的研发成本。

MoE + 多模态的组合并不多见。大多数开源多模态模型使用 dense 架构(如 LLaVA 系列、Qwen-VL),DeepSeek 把 MoE 引入多模态,在推理效率和模型规模之间找到了新的平衡点。

空间压缩的务实设计。3×3 压缩看似简单,但在实际工程中非常有效——它避免了复杂的 token 选择或 pooling 策略,用最小的计算代价换取了最大的序列长度缩减。

对国产多模态生态的意义

DeepSeek 这篇论文的技术细节公开后,社区可以快速复现和在此基础上迭代。对于国产多模态模型生态来说,这是一份高质量的参考架构:

- MoE 多模态的设计范式

- 自研 ViT 与 LLM 的适配策略

- 视觉空间压缩的工程实践

再加上 DeepSeek 一贯的开源传统,这篇论文很可能成为接下来半年国内多模态模型开发的重要参考。

小结

DeepSeek 用一篇论文回答了一个关键问题:多模态大模型是否一定要走 dense 架构的路线? 答案显然是否定的。284B 总参数、13B 激活参数的 MoE 多模态模型,配合自研视觉编码器和空间压缩策略,为高效多模态推理提供了一条新路径。

对于关注开源多模态模型的研究者和开发者来说,这篇论文值得仔细研读。