В гонке AI-моделей существовало базовое предположение: больше параметров = больше возможностей. Но последние данные Intelligence Index разрушают это предположение.

Ключевые данные

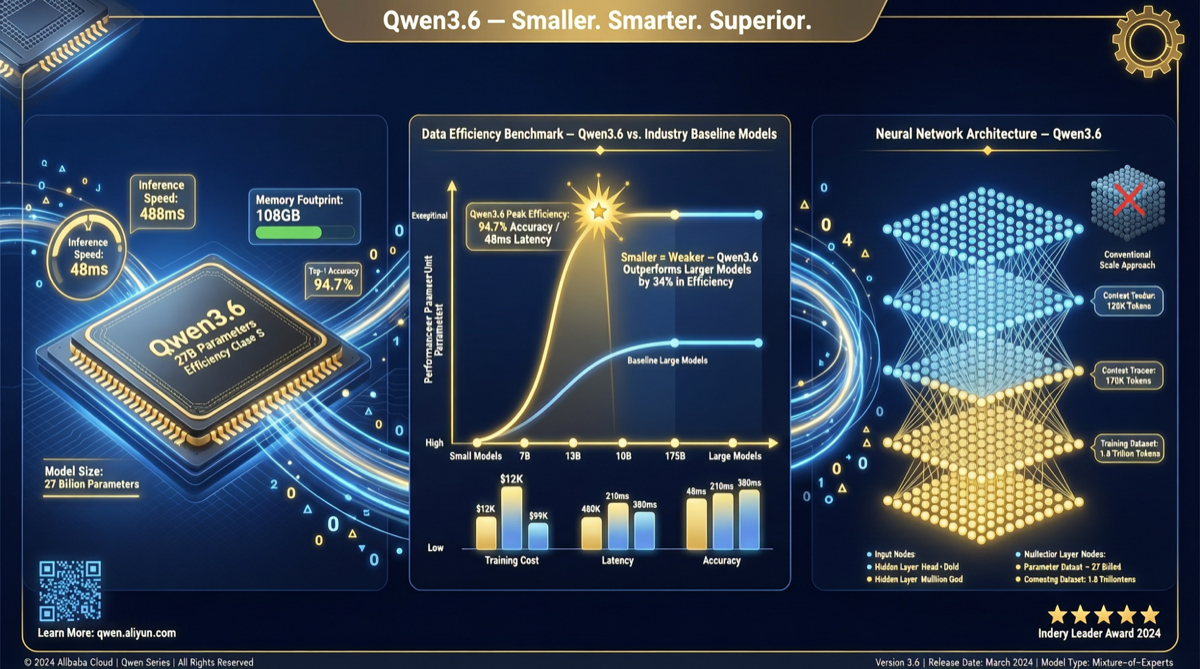

Qwen3.6 27B набрал 1414 Elo в бенчмарке GDPval-AA. Значимость:

| Модель | Параметры | GDPval-AA Elo |

|---|---|---|

| Qwen3.6 27B | 27B | 1414 |

| DeepSeek V4 Flash | 284B (1.6T MoE) | 1414 |

| Meta Muse Spark | Не раскрывается | 1414 |

| Qwen3.5 27B | 27B | 1157 |

Ключевой вывод: Qwen3.6 27B достигает того же результата, что и DeepSeek V4 Flash, с менее чем одной десятой параметров. По сравнению с Qwen3.5 27B — скачок на 257 Elo.

Что означает 257 Elo

В системе Intelligence Index прирост в 257 баллов примерно равен пересечению целого поколения моделей:

- GPT-4 → GPT-4o: ~150-200 Elo

- Claude 3 Haiku → Sonnet: ~100-150 Elo

- Qwen3.5 → Qwen3.6: 257 Elo = превышает скачок одного поколения

И это достигнуто при неизменных параметрах (по-прежнему 27B). Улучшение полностью обусловлено методами обучения, качества данных и оптимизации архитектуры.

Почему это важно

1. Революция стоимости инференса

Стоимость инференса 27B-модели примерно в 10 раз ниже, чем у 284B-модели:

- Порог самостоятельного развёртывания значительно снижается

- Стоимость API-вызовов падает на порядок

- Развёртывание на edge переходит из «невозможно» в «осуществимо»

2. Поворотный момент open-source экосистемы

Когда 27B open-source модели сопоставимы с закрытыми моделями на сотни миллиардов параметров, нарратив «только крупные компании могут обучать хорошие модели» начинает рушиться.

Рекомендации

- При выборе модели: Для сценариев без экстремальных требований к производительности Qwen3.6 27B может быть лучшим вариантом по соотношению цена/качество

- Для edge-развёртывания: 27B — крупнейшая «топовая» модель, которую можно запустить на одной RTX 4090 (24GB) с INT4-квантованием

Следующий этап гонки параметров — не «кто больше», а «кто эффективнее». Qwen3.6 27B уже дал ответ.