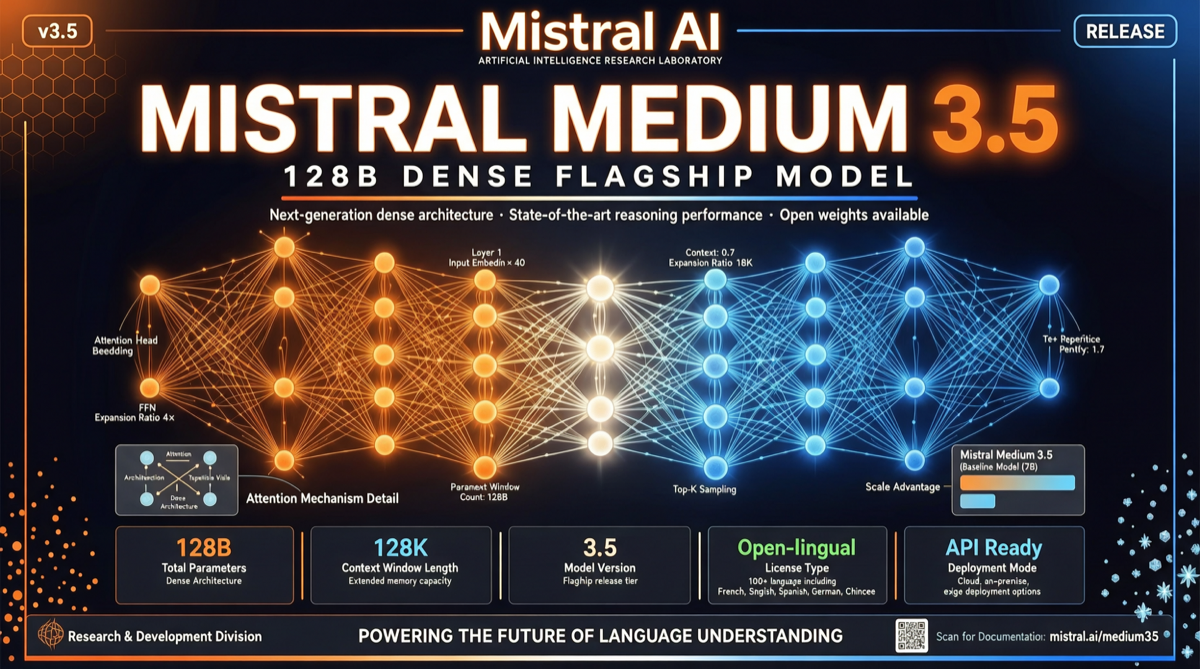

Mistral выпустила Mistral Medium 3.5 29 апреля 2026 года — 128-миллиардную плотную флагманскую модель, интегрирующую понимание текста и изображений. Это последний ход Mistral в сегменте моделей среднего размера и значимый шаг европейской AI-компании в конкуренции моделей 2026 года.

Основные характеристики

Ключевые параметры Medium 3.5:

| Метрика | Значение |

|---|---|

| Параметры | 128B (плотная) |

| Окно контекста | 256K токенов |

| Модальность | Текст + Визуальное |

| Режим рассуждений | Настраиваемая глубина |

| SWE-bench Verified | 77.6% |

| τ³ Telecom | 91.4 |

| Требования для локального запуска | ~64GB RAM |

По сравнению с моделями того же размера, Medium 3.5 набирает 91.4 на бенчмарке τ³ Telecom и 77.6% на SWE-bench Verified. Эти результаты ставят её в один ряд с моделями, имеющими в 6 раз больше параметров.

Настраиваемое рассуждение: баланс эффективности и точности

Самая примечательная особенность Medium 3.5 — настраиваемая глубина рассуждений. Пользователи могут указывать интенсивность рассуждений при вызове: простые задачи получают быстрый ответ, сложные задачи автоматически усиливают рассуждение. Это означает, что одна модель может покрывать как сценарии с низкой задержкой, так и сценарии с высокой точностью, снижая операционные расходы на развёртывание разных моделей для разных задач.

Сравнение с конкурентами

В том же диапазоне параметров конкурентами Medium 3.5 являются Qwen3.6-27B (меньше, но высокоэффективна) и IBM Granite 4.1-30B (выпущена в тот же день). По отзывам сообщества, Medium 3.5 превосходит Granite 4.1 в кодировании и визуальном понимании, но Qwen3.6-27B всё ещё лидирует на некоторых вертикальных бенчмарках.

Примечательное различие — лицензия: Mistral Medium 3.5 использует Mistral Research License, тогда как IBM Granite 4.1 использует Apache 2.0. Для коммерческого развёртывания Apache 2.0 имеет меньше ограничений.

Возможность локального развёртывания

Medium 3.5 может работать локально на машинах с ~64GB RAM (формат GGUF), предоставляя жизнеспособный вариант для команд с требованиями к конфиденциальности данных. В сочетании с сервисом вывода NVIDIA NIM предприятия могут развёртывать модель на собственном оборудовании без зависимости от внешних API.

Оценка ландшафта

Выпуск Medium 3.5 сигнализирует о том, что европейские AI-компании переходят от «догоняющих» к «дифференцированным конкурентам» — фокусируясь на эффективности и развёртываемости моделей среднего размера, а не гонясь за максимальными параметрами.

Для разработчиков, которым нужна модель, работающая локально с возможностями визуального понимания и исправления кода, Medium 3.5 стоит протестировать.

Основные источники

- Официальный выпуск Mistral Medium 3.5

- Mistral AI Studio

- Руководство по развёртыванию NVIDIA NIM